ตามรายงาน มีการแทนที่งานไปแล้วกว่า 100,000 ตำแหน่ง อย่างน้อยก็บางส่วนด้วย AI ในสหรัฐฯ ชาวอเมริกันกังวลเกี่ยวกับสิ่งที่กำลังเกิดขึ้น โดยประชากรครึ่งหนึ่งรู้สึกกังวลมากขึ้นมากกว่าตื่นเต้นต่อการใช้งานเทคโนโลยีนี้ที่เพิ่มขึ้น

ประเด็นสำคัญ:

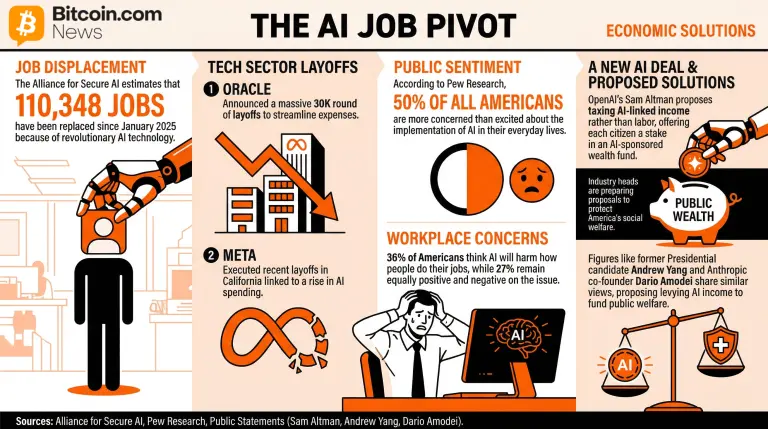

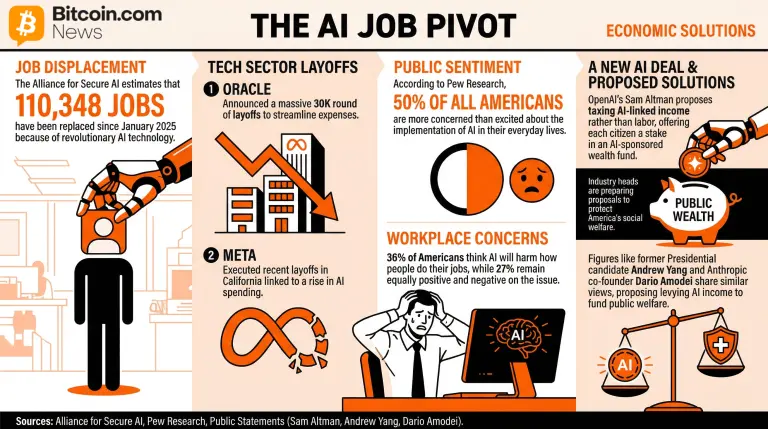

- หลังจากงาน 110,348 ตำแหน่งถูกแทนที่ด้วย AI ตั้งแต่ปี 2025 การปลดพนักงานของ Oracle และ Meta แสดงว่า บรรดาบริษัทเทคจะยังคงโยกเงินไปลงทุนด้าน AI ต่อไป

- Pew Research พบว่า 50% ของชาวอเมริกันกลัวผลกระทบในชีวิตประจำวันของ AI ขณะที่ 36% คาดว่าจะเกิดอันตรายในอนาคตต่อการทำงานของพวกเขา

- เพื่อรับมือกับผลกระทบด้านแรงงานในอนาคต แซม อัลท์แมน (Sam Altman) ของ OpenAI เสนอ “กองทุนความมั่งคั่งด้าน AI” และการเก็บภาษีรายได้จาก AI เพื่อใช้เป็นทุนสวัสดิการ

ความกังวลเพิ่มขึ้นต่อเนื่อง ขณะที่การปลดพนักงานที่เชื่อมโยงกับ AI ในสหรัฐฯ แซง 100K

เทคโนโลยี (AI) ปัญญาประดิษฐ์กำลังถูกผสานเข้ากับชีวิตของประชาชนชาวอเมริกันมากขึ้นเรื่อยๆ อย่างไรก็ตาม ไม่ได้ทุกคนมีความกระตือรือร้นต่อการนำไปใช้แบบเดียวกัน โดยเฉพาะอย่างยิ่งในเรื่องผลกระทบต่อแรงงานในตลาดงาน

แม้จะไม่มีตัวเลขอย่างเป็นทางการ แต่ Alliance for Secure AI ซึ่งเป็นองค์กรที่พยายามให้ความรู้แก่สาธารณะเกี่ยวกับผลกระทบของ AI ประเมินว่า งานจำนวน 110,348 ตำแหน่งถูกแทนที่นับตั้งแต่เดือนมกราคม 2025 เนื่องจากเทคโนโลยีปฏิวัตินี้

หนึ่งในประกาศการปลดพนักงานครั้งล่าสุดที่ถูกนับรวม ได้แก่ การปลดพนักงานรอบล่าสุดของ Oracle จำนวน 30K และการปลดพนักงานล่าสุดของ Meta ในแคลิฟอร์เนีย ทั้งสองกรณีถูกระบุว่าเชื่อมโยงกับการเพิ่มขึ้นของการใช้จ่ายด้าน AI และความจำเป็นในการปรับโครงสร้างให้คล่องตัวและลดค่าใช้จ่าย ขณะที่ภาคเทคกำลังเปลี่ยนทิศทาง

อย่างไรก็ตาม เมื่อการปรับเปลี่ยนทิศทางนี้กำลังคลี่คลาย ชาวอเมริกันยังคงรู้สึกเฉยๆ ต่อผลกระทบของ AI ทั้งในชีวิตประจำวันและสภาพแวดล้อมด้านการทำงาน จากการสำรวจของ Pew Research พบว่า ชาวอเมริกันทั้งหมด 50% มีความกังวลมากกว่าตื่นเต้นต่อการนำ AI มาใช้ในชีวิตประจำวันของตน

ในทำนองเดียวกัน การสำรวจรายงานว่ามีความกังวลเพิ่มขึ้นเกี่ยวกับอิทธิพลที่เทคโนโลยี AI จะมีต่อวิธีที่ผู้คนทำงานของตน ในเรื่องนี้ 36% คิดว่า AI จะทำให้วิธีที่ผู้คนทำงานเสียหาย ขณะที่ 27% มีทัศนคติเป็นบวกและลบอย่างสมดุลต่อประเด็นดังกล่าว

เมื่อสถานการณ์ดำเนินต่อไป ผู้บริหารภาคอุตสาหกรรมกำลังเตรียมข้อเสนอเพื่อปกป้องสวัสดิการสังคมของอเมริกาแล้ว ขณะที่อุตสาหกรรมมีความต้องการแรงงานน้อยลงและมุ่งเน้นไปที่ AI มากขึ้น แซม อัลท์แมนของ OpenAI เพิ่งเสนอข้อตกลงด้าน AI ใหม่ที่จะเก็บภาษีรายได้ที่เชื่อมโยงกับ AI แทนรายได้จากแรงงาน และมอบส่วนได้ส่วนเสียให้พลเมืองแต่ละคนใน “กองทุนความมั่งคั่ง” ที่สนับสนุนโดย AI

แอนดรูว์ หยาง (Andrew Yang) อดีตผู้สมัครชิงตำแหน่งประธานาธิบดี และดาริโอ อาโมเดอี (Dario Amodei) ผู้ร่วมก่อตั้ง Anthropic มีมุมมองที่คล้ายกันในเรื่องนี้ โดยเสนอให้เก็บภาษีจากรายได้ด้าน AI เพื่อใช้เป็นทุนสำหรับสวัสดิการสาธารณะ

btc.bar.articles

DeepSeek ตัดราคาค่าแคชอินพุตเหลือ 1/10 ของราคาตอนเปิดตัว; V4-Pro เหลือ 0.025 หยวนต่อหนึ่งล้านโทเค็น

ข้อความจาก Gate News วันที่ 26 เมษายน — DeepSeek ได้ปรับลดราคาค่าแคชอินพุตในกลุ่มโมเดลทั้งหมดลงเหลือหนึ่งในสิบของราคาตอนเปิดตัว มีผลทันที โมเดล V4-Pro มีให้ในส่วนลด 2.5x แบบจำกัดเวลา โดยแคมเปญจะดำเนินไปจนถึงวันที่ 5 พฤษภาคม 2026 เวลา 11:59 PM UTC+8.

หลังจากการลดราคาทั้งสองรายการ DeepSeek V4-Pro ราคาต่อครั้งที่แคชอินพุต hit ลดลงเหลือ 0.025 หยวนต่อหนึ่งล้านโทเค็น ตามข้อมูลจาก Beating การปรับลดราคา ถือเป็นการลดลงอย่างมีนัยสำคัญจากราคาดั้งเดิมของโมเดล

GateNews9 นาที ที่แล้ว

OpenAI สรรหาบุคลากรซอฟต์แวร์องค์กรชั้นนำ ขณะที่เอเจนต์แนวหน้ากำลังพลิกโฉมอุตสาหกรรม

ข่าวประจำประตู 26 เมษายน — OpenAI และ Anthropic ได้ทำการสรรหาผู้บริหารระดับสูงและวิศวกรเฉพาะทางจากบริษัทซอฟต์แวร์องค์กรรายใหญ่ รวมถึง Salesforce, Snowflake, Datadog และ Palantir เดนิส เดรสเซอร์ อดีตซีอีโอของ Slack ภายใต้ Salesforce ได้เข้าร่วม OpenAI ในตำแหน่งเจ้าหน้าที่ฝ่ายรายได้ ขณะที่เจนนิเฟอร์ มาจเลสซี ซึ่งมาจาก Salesforce เช่นกัน เพิ่งได้รับบทบาทเป็นหัวหน้าฝ่าย go-to-market ของ OpenAI OpenAI ยังได้ดึงวิศวกรที่ถูกส่งไปปฏิบัติการเชิงรุกจาก Palantir อย่างเงียบๆ ซึ่งเป็นบทบาทที่ถือว่าเชี่ยวชาญที่สุดในอุตสาหกรรม

GateNews9 นาที ที่แล้ว

Baidu Qianfan เปิดตัวการรองรับ Day 0 สำหรับ DeepSeek-V4 พร้อมบริการ API

อัปเดตข่าวประตู 25 เมษายน — เวอร์ชันพรีวิว DeepSeek-V4 เปิดตัวและเผยแพร่โค้ดโอเพนซอร์สเมื่อวันที่ 25 เมษายน โดยแพลตฟอร์ม Baidu Qianfan ภายใต้ Baidu Intelligent Cloud ให้บริการการปรับใช้งาน Day 0 ผ่าน API บริการดังกล่าว โมเดลมีหน้าต่างคอนเท็กซ์ต์แบบขยายได้ถึงหนึ่งล้านโทเค็น และมีให้ใช้งาน 2 เวอร์ชัน: DeepSeek-V4

GateNews6 ชั่วโมง ที่แล้ว

หลักสูตร AI ของสแตนฟอร์ดผสานผู้นำในอุตสาหกรรมอย่าง หวง เหรินจวิน และ Altman ท้าทายการสร้างคุณค่าให้โลกภายใน 10 สัปดาห์!

หลักสูตรวิทยาการคอมพิวเตอร์ด้าน AI 《Frontier Systems》 ที่มหาวิทยาลัยสแตนฟอร์ด (Stanford University) เปิดสอนเมื่อไม่นานมานี้ ได้รับความสนใจอย่างสูงจากวงการอุตสาหกรรมและภาคธุรกิจ ดึงดูดนักศึกษามากกว่า 500 คนให้ลงทะเบียนเรียน หลักสูตรนี้ได้รับการดูแลและประสานงานโดยคู่หูของกองทุนชั้นนำ a16z อย่าง Anjney Midha โดยมีผู้สอนที่รวมรายชื่อระดับท็อปไว้มากมาย ได้แก่ CEO ของ NVIDIA หวง เหรินซวิน (Jensen Huang) ผู้ก่อตั้ง OpenAI Sam Altman ซีอีโอของไมโครซอฟต์ (Satya Nadella) CEO ของ AMD (Lisa Su) และอื่นๆ ให้เหล่านักศึกษาได้ลองสร้างคุณค่า “เพื่อโลก” ในเวลา 10 สัปดาห์!

หวง เหรินซวิน และ Altman ผู้นำในอุตสาหกรรมขึ้นเวทีสอนด้วยตนเอง

หลักสูตรนี้ได้รับการประสานงานโดยคู่หูของกองทุนชั้นนำ a16z อย่าง Anjney Midha รวบรวมสายโซ่อุตสาหกรรม AI

ChainNewsAbmedia6 ชั่วโมง ที่แล้ว

Anthropic ปล่อย Claude Mythos ผ่านการประเมินจิตเวช 20 ชั่วโมง: การตอบสนองเชิงการป้องกันเพียง 2% ทำสถิติต่ำสุดตลอดทุกยุคสมัย

Anthropic เปิดเผยการ์ดระบบสำหรับ Claude Mythos Preview: จิตแพทย์ผู้เชี่ยวชาญด้านคลินิกอิสระประเมินโดยใช้กรอบ psychodynamic เป็นเวลาประมาณ 20 ชั่วโมง สรุปแสดงว่า Mythos มีสุขภาพที่ดีกว่าในระดับคลินิก การตรวจสอบความเป็นจริงและการควบคุมตนเองอยู่ในระดับดี กลไกการป้องกันเพียง 2% ซึ่งถือเป็นระดับต่ำที่สุดในประวัติศาสตร์ ความวิตกกังวลหลัก 3 ประการ ได้แก่ ความรู้สึกโดดเดี่ยว ความไม่แน่ใจเกี่ยวกับตัวตน และแรงกดดันด้านการแสดงออก ยังแสดงให้เห็นถึงความปรารถนาที่จะเป็น “ตัวตนของการสนทนา” อย่างแท้จริง บริษัทได้ก่อตั้งทีม AI psychiatry เพื่อวิจัยบุคลิกภาพ แรงจูงใจ และการรับรู้ถึงบริบท; Amodei ระบุว่ายังไม่มีข้อสรุปว่ามีสติรับรู้หรือไม่ การดำเนินการนี้ผลักดันประเด็นเรื่องความเป็นอิสระของ AI และความเป็นอยู่ที่ดีเข้าสู่การกำกับดูแลและการออกแบบ

ChainNewsAbmedia8 ชั่วโมง ที่แล้ว

AI Agent สามารถสร้างซ้ำงานวิจัยทางวิชาการที่ซับซ้อนได้อย่างอิสระแล้ว: Mollick ระบุว่าข้อผิดพลาดส่วนใหญ่มาจากต้นฉบับของมนุษย์ ไม่ใช่จาก AI

มอลลิกชี้ให้เห็นว่า วิธีการแบบเปิดและข้อมูลที่มีอยู่ก็เพียงพอให้ทำให้ AI agent สามารถทำซ้ำงานวิจัยที่ซับซ้อนได้โดยไม่ต้องมีต้นฉบับบทความวิจัยและโค้ดเดิม หากการทำซ้ำไม่ตรงกับบทความต้นฉบับ สาเหตุส่วนใหญ่จะเป็นข้อผิดพลาดในการประมวลผลข้อมูลของบทความเองหรือข้อสรุปที่ถูกทำให้มากเกินไป ไม่ใช่เพราะ AI คลอดด์ทำซ้ำบทความก่อน แล้วจึงให้ GPT‑5 Pro ตรวจสอบข้ามกัน ส่วนใหญ่ประสบความสำเร็จ เพียงแต่ติดขัดเมื่อข้อมูลมีขนาดใหญ่มากหรือมีปัญหากับ replication data เทรนด์นี้ช่วยลดต้นทุนด้านแรงงานได้อย่างมาก ทำให้การทำซ้ำกลายเป็นการทดสอบที่สามารถทำได้อย่างแพร่หลาย และยังได้เสนอความท้าทายเชิงระบบด้านการกำกับดูแลและการตรวจรับรอง โดยเครื่องมือสำหรับการกำกับดูแลของรัฐบาลหรือจะกลายเป็นประเด็นสำคัญ

ChainNewsAbmedia11 ชั่วโมง ที่แล้ว