Новый инструмент ИИ от Google предсказывает внезапные наводнения за 24 часа до события

Вкратце

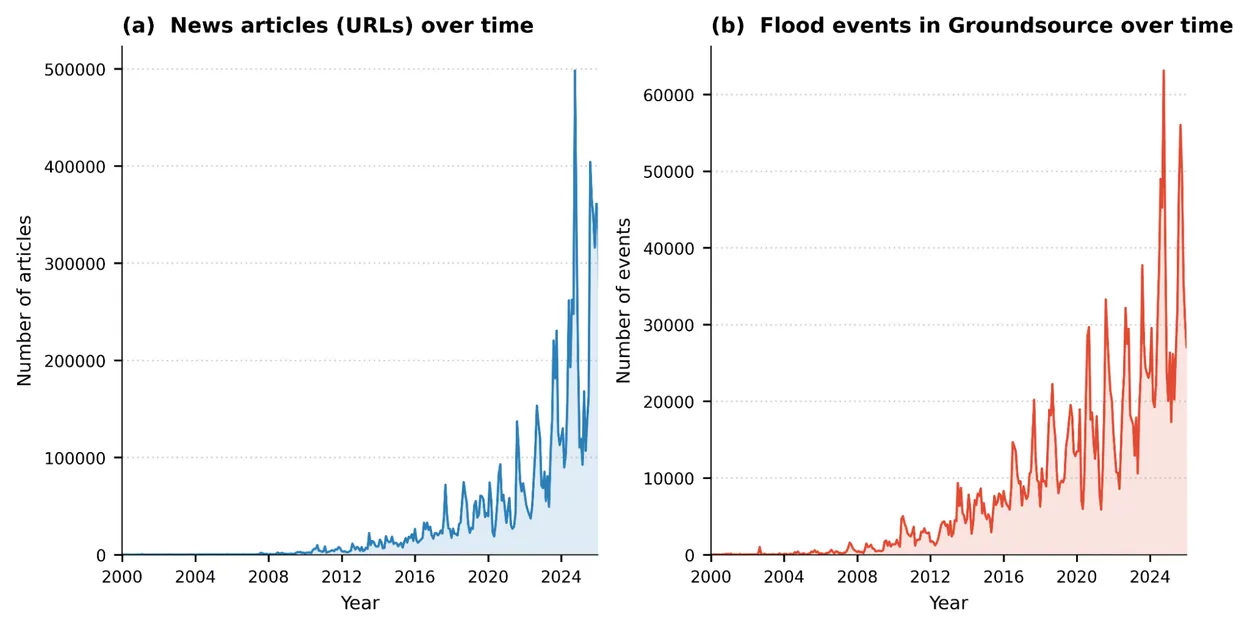

- Google создала крупнейший в истории набор данных о быстрых наводнениях, используя Gemini для анализа двух десятилетий глобальных новостных сообщений.

- Теперь этот набор данных служит основой для ИИ-модели, которая прогнозирует городские быстрые наводнения за до 24 часа до их возникновения.

- Система заполняет важный пробел в данных, который долго мешал прогнозированию быстрых наводнений.

Быстрые наводнения ежегодно уносят тысячи жизней. Они происходят быстро, наносят удар по городам, и на протяжении десятилетий практически не было средств, чтобы предсказать их появление, потому что данных для обучения моделей предсказания просто не существовало. В четверг Google объявила, что нашла решение этой проблемы — через анализ новостей. Компания представила Groundsource — систему, которая использует Gemini AI для обработки миллионов новостных статей, опубликованных с 2000 года, извлекает упоминания о наводнениях и связывает каждое из них с конкретным местом и датой. В результате получился набор данных из 2,6 миллиона исторических быстрых наводнений, охватывающий более 150 стран, и теперь он доступен для скачивания и использования всем желающим.

Этот набор данных был использован для обучения новой ИИ-модели, способной прогнозировать вероятность быстрого наводнения в городских районах за следующие 24 часа. Прогнозы уже доступны на платформе Flood Hub Google — той же платформе, которая уже используется для предупреждения около 2 миллиардов человек о речных наводнениях по всему миру. Проблема, которую решает Groundsource, удивительно проста. У рек есть физические датчики — сенсоры, установленные в воде, которые регистрируют уровни воды десятилетиями. Именно благодаря им прогнозисты научились предсказывать, когда река выйдет из берегов. У городских улиц таких датчиков нет. Когда сильный дождь заливает тротуары и перегружает дренажные системы, наводнение происходит слишком быстро и локально, чтобы его можно было отслеживать с помощью традиционных инструментов. Без исторических данных невозможно обучить ИИ распознавать такие паттерны. Решением Google стало рассматривать новостные статьи как отсутствующие датчики.

«Преобразуя публичную информацию в действенные данные, мы не просто анализируем прошлое — мы строим более устойчивое будущее для всех, чтобы никто не был удивлен природной катастрофой», — заявила Google.

Источник: Google

После фильтрации рекламы, навигационных меню и дублирующихся материалов, а также перевода статей с других языков на английский, команда превратила миллионы неструктурированных текстовых описаний в чистые, геолокационные временные ряды данных. Обученная на этих данных модель использует нейронную сеть LSTM — тип ИИ, предназначенный для обработки последовательностей во времени — которая принимает погодные прогнозы по часам, а также локальные факторы, такие как плотность урбанизации, скорость поглощения почвой и рельеф. Затем она выдает простой сигнал: средний или высокий риск наводнения в течение следующих 24 часов для любого городского района с плотностью населения более 100 человек на квадратный километр. У системы есть ограничения. Она охватывает только области около 20 квадратных километров за раз, не может точно определить степень опасности наводнения и плохо работает в регионах с редким освещением новостями. Тем не менее, ранние результаты впечатляют. Региональное управление по чрезвычайным ситуациям в Южной Африке получило предупреждение от Flood Hub во время бета-тестирования, подтвердило наличие наводнения на месте и отправило гуманитарного работника для реагирования. По словам директора по кризисной устойчивости Google Джульет Ротенберг, «эта цепочка событий — от предсказания в Flood Hub до реальных действий — именно то, для чего создан Flood Hub».