Sam Altman căn nhà biệt thự trị giá 27 triệu trong khu Marriott bị ném bom xăng và bắn súng, ba nghi phạm bị bắt

Giám đốc điều hành của OpenAI, Sam Altman, tại nơi ở ở Russian Hill, San Francisco, đã liên tiếp bị hai vụ tấn công trong vòng hai ngày; ba nghi phạm lần lượt đã bị bắt. Vào ngày 10 tháng 4, một người đàn ông đến từ Texas với lập trường phản đối mạnh mẽ đối với trí tuệ nhân tạo đã ném một chai xăng (bom cháy) vào nhà ở; vào ngày 12 tháng 4, một cặp nam nữ đã bắn vào nhà từ trong xe, camera giám sát ghi lại biển số xe, và cảnh sát đã hoàn tất việc bắt giữ vào chiều cùng ngày.

Vụ tấn công thứ nhất: Bom cháy và lời đe doạ nhắm tới trụ sở OpenAI

(Nguồn: X)

(Nguồn: X)

Khoảng 3 giờ 40 phút sáng ngày 10 tháng 4, người đàn ông 20 tuổi đến từ Texas là Daniel Alejandro Moreno-Gama đã ném một chai xăng (bom cháy) vào cổng kim loại phía bắc khu nhà của Altman trên phố Chestnut, lực lượng an ninh nhanh chóng dập tắt đám cháy, hiện trường không gây ra thiệt hại nghiêm trọng. Khoảng một giờ sau, chính nghi phạm đó xuất hiện gần trụ sở OpenAI tại Mission Bay, tuyên bố sẽ thiêu huỷ tòa nhà, ngay sau đó bị cảnh sát bắt giữ và đối mặt với các cáo buộc như âm mưu giết người, phóng hoả và tàng trữ thiết bị cháy.

Dữ liệu điều tra cho thấy trước đó Moreno-Gama đã đăng rất nhiều bài trên mạng xã hội, bày tỏ sự phản đối mạnh mẽ đối với trí tuệ nhân tạo, cho rằng AI sẽ đe doạ sự tồn tại của con người, đồng thời chỉ trích ngành công nghệ là “thiếu đạo đức”. Anh ta từng tham gia máy chủ Discord của PauseAI, nhưng PauseAI đã phủ nhận rõ ràng mọi liên hệ trực tiếp, tuyên bố rằng trong 34 thông điệp được đăng chung trên máy chủ của mình không có bất kỳ nội dung kích động bạo lực nào, và sau khi vụ việc xảy ra đã gỡ bỏ; đồng thời lên án toàn diện hành vi bạo lực nhắm vào cá nhân.

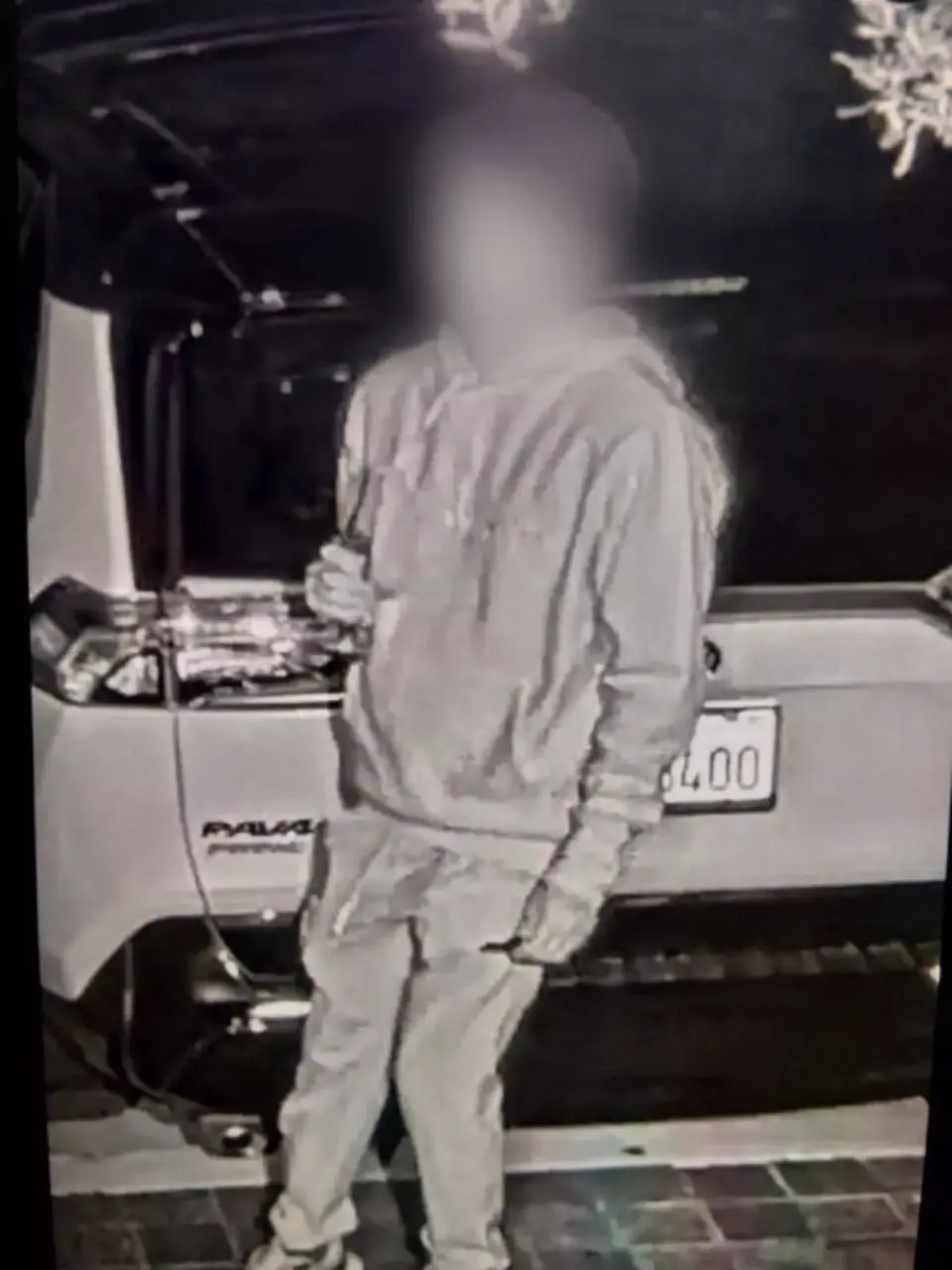

Vụ tấn công thứ hai: Vụ nổ súng và hai nghi phạm bị bắt

Chưa đầy 48 giờ sau khi xảy ra vụ việc thứ nhất, vào khoảng 1 giờ 40 phút sáng ngày 12 tháng 4, một chiếc xe sedan Honda chạy qua trước nhà rồi quay đầu, dừng bên phía Lombard Street. Hành khách ngồi ghế phụ thò tay ra khỏi cửa sổ, nghi ngờ đã bắn một phát về hướng nhà. Camera giám sát ghi lại đầy đủ biển số xe, và cảnh sát đã thành công xác định nghi phạm vào chiều cùng ngày.

Tóm tắt ba vụ bắt giữ

Daniel Alejandro Moreno-Gama (20 tuổi, Texas): âm mưu giết người, phóng hoả, tàng trữ thiết bị cháy; bị cáo buộc tấn công bằng bom cháy và đe doạ trụ sở OpenAI

Amanda Tom (25 tuổi): tội sơ suất trong việc xả súng; bị cáo buộc bắn vào nhà của Altman từ trong xe

Muhamad Tarik Hussein (23 tuổi): tội sơ suất trong việc xả súng; bị bắt cùng vụ án với Tom; trong lúc cảnh sát thực hiện lệnh khám xét đã phát hiện thêm ba khẩu súng

Căng thẳng liên quan đến AI và an ninh của giới lãnh đạo công nghệ: Altman kêu gọi hạ nhiệt đối đầu

Sau vụ bom cháy, Altman đăng bài trên blog; trong bài viết có kèm ảnh chụp của chồng anh, Oliver Mulherin, và con trai. Anh cho biết anh hiểu sự lo ngại của công chúng đối với công nghệ, nhưng kêu gọi “giảm mức độ gay gắt của lời nói và hành động, nỗ lực giảm xung đột bên trong gia đình, theo cả nghĩa đen lẫn nghĩa bóng đều như vậy”.

Trưởng công an San Francisco, Derrick Lew, cho biết cảnh sát sẽ coi các tội phạm liên quan đến việc dùng súng “vô cùng nghiêm trọng” và sẽ truy tố một cách nghiêm khắc theo quy định pháp luật. Điều đáng chú ý là, khoảng năm tháng trước cuộc tấn công này, nhân viên của OpenAI đã từng kích hoạt quy trình sơ tán khẩn cấp vì nhận được các mối đe doạ từ những người phản đối AI, cho thấy các rủi ro an ninh liên quan đã xuất hiện từ trước.

Chi phí mà các công ty công nghệ dành cho bảo vệ an ninh cấp cao tiếp tục tăng: Tesla năm 2023 chi khoảng 2,4 triệu USD cho chi phí an ninh của Musk; Facebook năm 2019 chi 20,4 triệu USD cho chi tiêu an ninh của Zuckerberg. Hiện tại, OpenAI chưa công bố cụ thể khoản chi cho vấn đề an ninh của Altman.

Câu hỏi thường gặp

Động cơ của nghi phạm tấn công nơi ở của Sam Altman là gì?

Nghi phạm của vụ tấn công bom cháy đầu tiên, Moreno-Gama, từng công khai bày tỏ sự phản đối mạnh mẽ đối với AI, cho rằng trí tuệ nhân tạo tồn tại nguy cơ đe doạ sự sinh tồn của con người, và có liên hệ với cộng đồng trực tuyến của PauseAI. Về động cơ cụ thể của vụ nổ súng thứ hai, cảnh sát hiện vẫn chưa công bố.

PauseAI là tổ chức gì, và liệu có liên quan trực tiếp đến cuộc tấn công này không?

PauseAI là một tổ chức phi lợi nhuận hoạt động nhằm vận động tạm dừng phát triển các mô hình AI tiên phong. Nghi phạm của vụ tấn công đầu tiên từng đăng 34 thông điệp trên máy chủ Discord của họ, nhưng PauseAI khẳng định rõ ràng rằng không có bất kỳ liên quan nào đến hành vi tấn công; tổ chức này tuyên bố trong các thông điệp của mình không có nội dung kích động bạo lực, đã gỡ bỏ sau khi sự việc xảy ra, và lên án toàn diện hành vi bạo lực nhắm vào bất kỳ ai.

Các nhà lãnh đạo công nghệ cấp cao nên ứng phó thế nào trước nguy cơ an ninh ngày càng gia tăng?

Các công ty công nghệ hàng đầu mỗi năm chi hàng triệu đến hàng chục triệu USD để bảo vệ giám đốc điều hành (CEO) của mình. Các trường hợp đã được công khai hiện bao gồm chi phí an ninh của Tesla dành cho Musk và chi tiêu an ninh hằng năm của Facebook dành cho Zuckerberg. Hai vụ tấn công liên tiếp nhắm vào nơi ở của Altman dự kiến sẽ tiếp tục thúc đẩy ngành công nghệ đánh giá lại các tiêu chuẩn bảo vệ an ninh cấp cao.

Bài viết liên quan

IEA: Chi tiêu cơ sở hạ tầng AI đã vượt đầu tư sản xuất dầu khí, dự kiến sẽ tăng thêm 75% vào năm 2026

Thượng nghị sĩ Bernie Sanders đưa ra cảnh báo về mối đe dọa sinh tồn từ AI

Trưởng bộ phận mô hình AI của Xiaomi: Cuộc cạnh tranh AI đang chuyển sang thời đại Agent; tự tiến hóa là sự kiện then chốt dẫn tới AGI

xAI Grok Voice tiếp quản đường dây nóng chăm sóc khách hàng của Starlink, 70% cuộc gọi được tự động kết án

GPT-5.5 Trở Lại Tuyến Đầu Trong Lập Trình, Nhưng OpenAI Đổi Benchmark Sau Khi Thua Opus 4.7

Giám đốc điều hành Google DeepMind: Mọi công ty sản phẩm AI đều nên xây dựng các bộ chuẩn tùy chỉnh