22x subsídio por 1 dólar de receita: quanto tempo o mito de crescimento do TAO pode durar?

Título original: The Bear Case for Bittensor (TAO)

Fonte original: Pine Analytics

Tradução por: Saoirse, Foresight News

O preço atual do TAO é cerca de 275 dólares, com uma capitalização de mercado de 2,6 bilhões de dólares e uma avaliação totalmente diluída de 5,8 bilhões de dólares. O projeto conta com o respaldo da Grayscale (que submeteu pedido de ETF na NYSE em dezembro de 2025) e foi publicamente reconhecido pelo CEO da Nvidia, Jensen Huang. Ao mesmo tempo, a narrativa de oferta de tokens é bastante atraente: limite total de 21 milhões de unidades, com mecanismo de halving semelhante ao do Bitcoin. Após o primeiro halving em dezembro de 2025, a emissão diária cairá de 7200 para 3600 unidades. Em um ano, o número de sub-redes aumentou de 32 para 128, e o treinamento Covenant-72B da Templar demonstrou que poder de computação descentralizado pode treinar grandes modelos de linguagem com competitividade de referência.

Este relatório não nega esses fatos. O que queremos discutir é: o modelo econômico da rede consegue gerar receitas externas reais que sustentem a avaliação atual, e como ela se posiciona frente aos provedores de serviços centralizados e à computação autogerida em termos de competitividade.

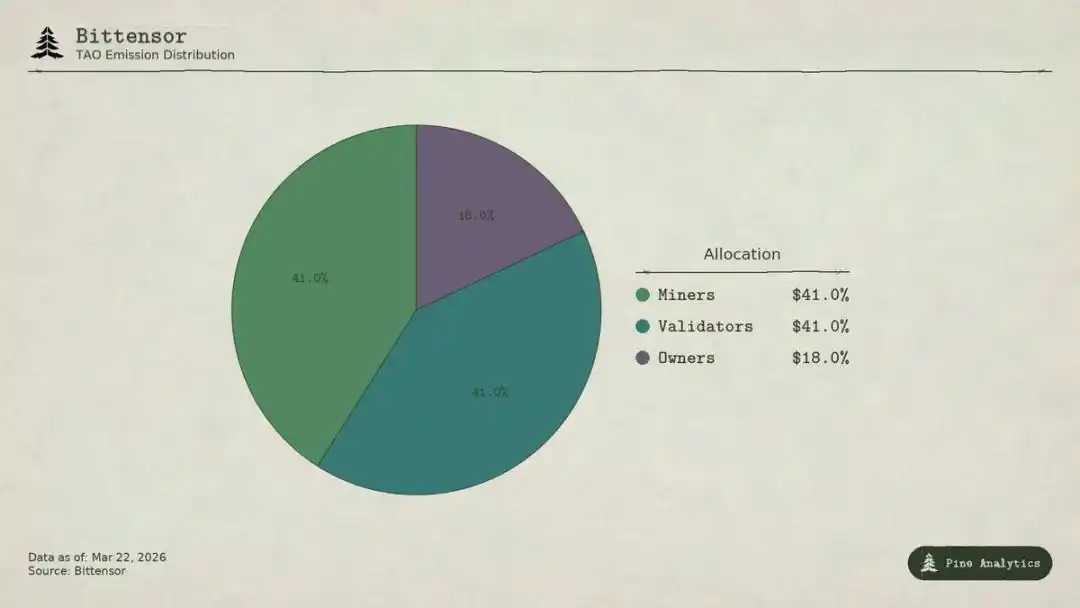

Distribuição de tokens do Bittensor (TAO)

Como o valor circula na rede

O Bittensor possui quatro tipos de participantes:

· Proprietários de sub-redes que criam mercados especializados de IA, recebendo 18% da emissão de TAO como recompensa;

· Mineradores que executam tarefas de IA (inferência, treinamento, processamento de dados), recebendo 41%, aproximadamente 1476 unidades de TAO por dia, com valor anual de cerca de 148 milhões de dólares;

· Validadores que avaliam a produção dos mineradores, recebendo 41%;

· Stakers que colocam TAO em pools de liquidez de sub-redes, trocando por tokens exclusivos dessas sub-redes.

No modelo Taoflow, a recompensa de uma sub-rede é determinada pelo fluxo líquido de TAO em staking; se for negativo, não há recompensa. As dez principais sub-redes controlam cerca de 56% do total emitido na rede.

TAO é um token universal para toda a rede: registro de mineradores, staking de validadores, compra de tokens de sub-redes e pagamento por serviços requerem TAO. Em teoria, a atividade nas sub-redes criaria uma demanda estrutural pelo token base.

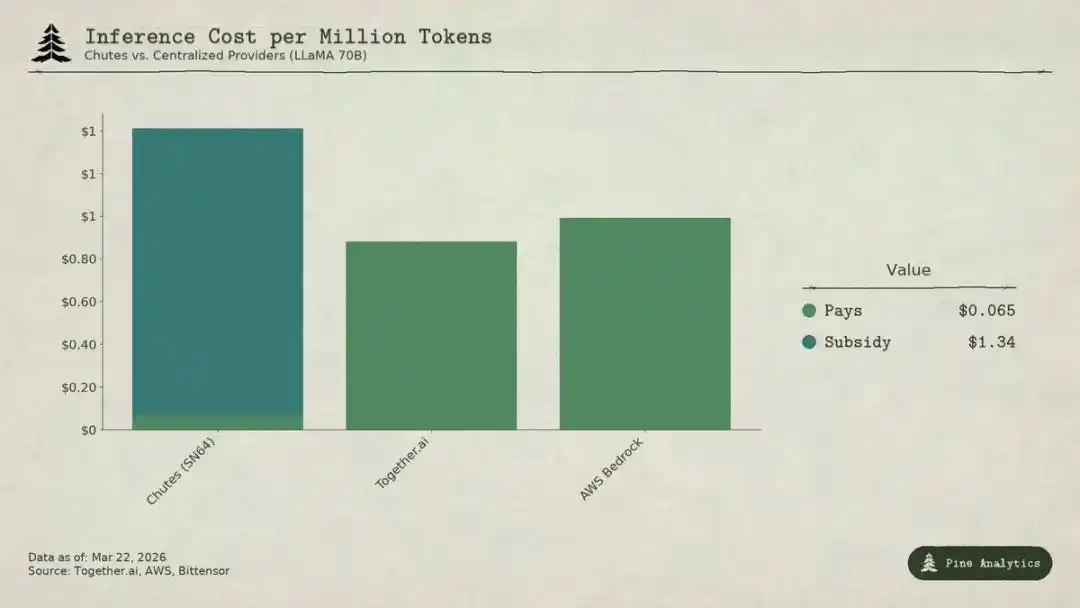

Análise comparativa entre o custo de inferência do modelo LLaMA 70B na LLaMA 70B da LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B.

Análise comparativa entre o custo de inferência do modelo LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B.

Este texto é uma repetição extensa de uma análise comparativa de custos de inferência de modelos de IA, que não necessita de tradução adicional aqui, pois é uma sequência de repetições.

Análise comparativa entre o custo de inferência do modelo LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B.

Análise comparativa entre o custo de inferência do modelo LLaMA 70B na LLaMA 70B e o custo de inferência de sub-redes LLaMA 70B na LLaMA 70B.

Questões de proteção de vantagem competitiva

Mesmo que uma sub-rede ofereça um serviço valioso, o modelo e os métodos subjacentes são naturalmente públicos: Covenant-72B usa licença Apache, com publicação de artigo técnico. Qualquer concorrente pode replicar diretamente, sem participar do ecossistema TAO.

As tradicionais barreiras de proteção (tecnologia proprietária, efeitos de rede, custos de mudança, marca) não se aplicam:

· Tecnologia de código aberto;

· Efeito de rede pertence ao TAO, não a uma única sub-rede;

· Os pesos do modelo são públicos, o custo de troca para o usuário é zero.

A comunidade acredita que o mecanismo de incentivo é uma barreira de proteção, mas isso depende de uma emissão contínua de grandes quantidades de tokens, e a cada halving o orçamento de incentivos diminui.

O que TAO realmente está negociando

Com uma avaliação de 2,6 bilhões de dólares, o preço do TAO não reflete os fundamentos de demanda: receitas anuais de 3 a 15 milhões de dólares não sustentam essa avaliação sob qualquer análise tradicional. O mercado está negociando: a escassez ao estilo Bitcoin, a expectativa de ETF da Grayscale, o ciclo de mercado de IA, e o valor de opções de longo prazo para IA descentralizada. Todos esses fatores são razoáveis para especulação, mas vêm quase que exclusivamente do lado da oferta e do sentimento de mercado.

Se você mantém TAO baseado na narrativa de escassez, mesmo com demanda fraca, pode lucrar; mas se acredita que Bittensor se tornará uma rede de serviços de IA de escala real, atualmente não há evidências e há obstáculos estruturais difíceis de superar. Os investidores devem distinguir claramente sua lógica de investimento.

Link do artigo original

Clique para conhecer as vagas na BlockBeats

Participe do grupo oficial da BlockBeats no Telegram:

https://t.me/theblockbeats

Grupo de discussão no Telegram:

https://t.me/BlockBeats_App

Conta oficial no Twitter:

https://twitter.com/BlockBeatsAsia