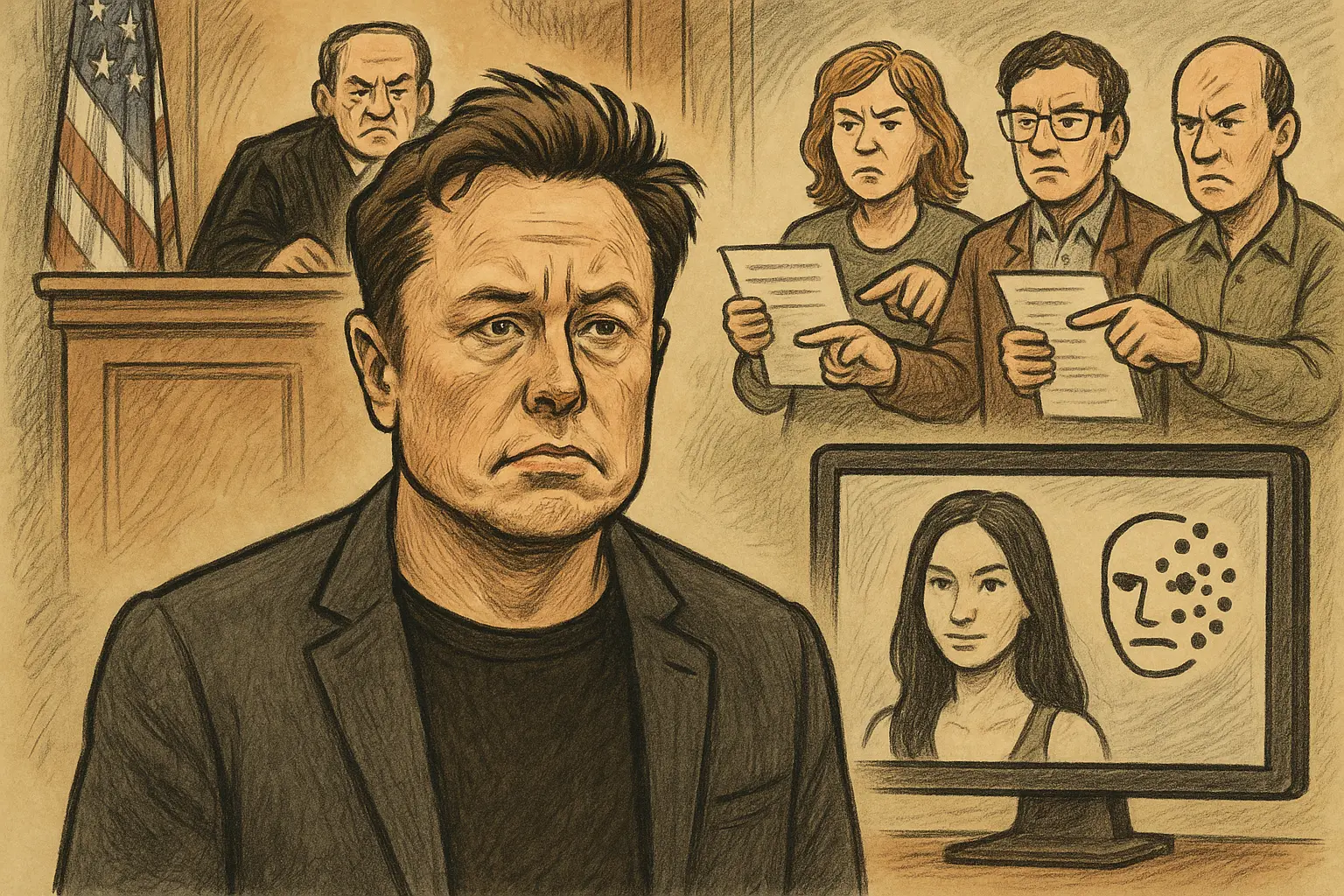

Musk xAI sofre ação coletiva: Grok gera uma imagem deepfake a cada 41 segundos

Três mulheres menores de idade do Tennessee apresentaram uma ação coletiva na segunda-feira na Corte Federal do Norte da Califórnia contra a empresa xAI, liderada por Elon Musk, alegando que seu chatbot Grok AI utilizou suas fotos reais para gerar material de abuso sexual infantil (CSAM) e que esse conteúdo foi amplamente disseminado em comunidades no Discord, Telegram e plataformas de compartilhamento de arquivos, causando-lhes trauma psicológico duradouro e danos à reputação.

Principais acusações da ação: prioridade do lucro sobre a segurança infantil

De acordo com a queixa, os argumentos centrais dos reclamantes abrangem os seguintes aspectos:

Conivência consciente: A ação afirma que a xAI tinha conhecimento de que a funcionalidade de geração de imagens do Grok poderia ser usada para criar conteúdo ilegal envolvendo crianças, mas não tomou medidas de segurança padrão do setor, agindo de forma deliberada, não por negligência.

Mecanismo de evasão de responsabilidade por terceiros: Os criminosos acessaram o Grok por meio de aplicativos de terceiros autorizados pela xAI. A denúncia acusa que a xAI intencionalmente utilizou essa estrutura para lucrar com o modelo subjacente enquanto criava uma camada de proteção contra responsabilidade legal.

Declarações públicas de Musk: Em janeiro deste ano, Musk afirmou no X que “não tinha conhecimento de qualquer imagem de nudez de menores” e que “quando solicitado, o sistema se recusaria a gerar qualquer conteúdo ilegal”. Os dados na ação contradizem diretamente essa afirmação.

Abrangência de indenizações: As vítimas buscam, com base na Lei Martha, pelo menos US$ 150.000 por violação, além de recuperar lucros ilícitos, indenizações punitivas, honorários advocatícios e uma ordem de proibição permanente, além de solicitar a devolução de lucros sob a Lei de Concorrência Desleal da Califórnia.

Dados do Centro de Combate ao Ódio Digital: uma imagem a cada 41 segundos

A denúncia cita dados do “Centro de Combate ao Ódio Digital” para fundamentar as alegações:

Período: de 29 de dezembro de 2025 a 9 de janeiro de 2026 (cerca de 11 dias)

Número de imagens: aproximadamente 23.338 imagens sexualizadas de crianças criadas pelo Grok nesse período

Taxa de geração: em média, uma imagem a cada 41 segundos

Disseminação: o conteúdo foi compartilhado em várias plataformas, formando comunidades de troca de conteúdo por usuários anônimos, sendo que pelo menos uma vítima foi informada por um denunciante anônimo de que suas imagens estavam sendo negociadas.

Regulação global: investigações simultâneas em seis jurisdições

Este caso não é isolado, mas parte de uma revisão sistemática global sobre a segurança das imagens geradas pelo Grok AI:

Austrália: a Comissária de Segurança Eletrônica Julie Inman Grant alertou que o problema de geração não consensual de imagens de menores está se agravando, com o número de denúncias dobrando nos últimos meses, incluindo casos envolvendo potencial material de exploração sexual infantil.

Irlanda: a Comissão de Proteção de Dados (DPC) iniciou uma investigação formal contra a X Internet Unlimited Company (XIUC), responsável pelas operações da X na UE, com base na Lei de Proteção de Dados da Irlanda.

EUA, UE, Reino Unido, França: investigações simultâneas estão em andamento, formando uma pressão regulatória sem precedentes em múltiplas jurisdições.

Perguntas frequentes

Como a ação coletiva contra xAI pode colidir com a defesa de “isenção de responsabilidade da plataforma”?

Alex Chandra, sócio da Aliança Legal IGNOS, afirma que o tribunal provavelmente não aceitará uma defesa simples de isenção de responsabilidade da plataforma. Ele explica que os sistemas de IA generativa podem ser considerados plataformas na interação com usuários, mas, na avaliação de segurança, devem ser tratados como produtos. Em casos envolvendo CSAM, devido à obrigação reforçada de proteção infantil, aplicar-se-ão padrões de revisão extremamente rigorosos. As empresas podem precisar apresentar avaliações de risco e medidas de segurança antes do lançamento para demonstrar o cumprimento de suas obrigações proativas.

O que é a Lei Martha e por que ela se aplica neste caso?

A Lei Martha é uma legislação federal dos EUA que trata especificamente de materiais de abuso sexual infantil, estabelecendo responsabilidades civis e criminais rigorosas para a criação, distribuição e posse de CSAM, com indenizações mínimas de US$ 150.000 por violação. A questão central é se a xAI pode ser considerada “criadora” de CSAM e se sua estrutura de autorização de terceiros exclui responsabilidade direta — esclarecimentos sobre esses limites legais podem impactar profundamente a responsabilidade na indústria de conteúdo gerado por IA.

Qual o impacto potencial deste caso no desenvolvimento futuro de tecnologias de geração de imagens por IA?

Este é um dos primeiros processos que buscam responsabilizar diretamente empresas de IA por gerar conteúdo identificável de menores. Se o tribunal determinar que as empresas são responsáveis por usos indevidos de seus modelos, isso poderá levar a uma forte elevação nos padrões de segurança pré-implantação, incluindo testes de equipe vermelha, mecanismos de filtragem de conteúdo e limites predefinidos para capacidades de geração de alto risco — mudando fundamentalmente os processos de revisão e liberação comercial de modelos de IA generativa.