Musk xAI apresenta queixa contra o estado do Colorado, alegando que as regras de IA obrigam a restringir a liberdade de expressão, violando…

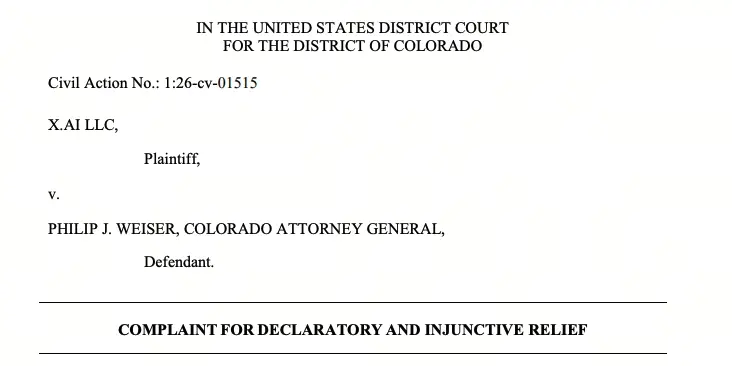

A empresa de inteligência artificial xAI, da tutela de Musk, apresentou na quinta-feira uma ação judicial junto do Tribunal Distrital dos EUA no estado do Colorado, pedindo que seja impedida a entrada em vigor, a 30 de junho, do projeto de lei do Senado do Colorado n.º 24-205 (SB 24-205). O diploma visa impedir que os sistemas de IA criem «discriminação algorítmica» nas áreas do emprego, habitação e serviços financeiros. A xAI sustenta que a regulamentação obriga o Grok a produzir informação com base em posições políticas, violando a liberdade de expressão.

As alegações constitucionais da xAI: a saída de IA é uma expressão protegida

(Fonte: CourtListener)

(Fonte: CourtListener)

Nos documentos do processo, a xAI declara de forma expressa que o estado do Colorado não tem o direito de alterar à força a emissão de informação da xAI apenas porque pretende promover uma perspetiva específica em temas altamente politizados como «justiça e igualdade». A empresa salienta também que a SB 24-205 tem uma contradição lógica fundamental: por um lado, a lei defende a eliminação da discriminação histórica e o aumento da diversidade, mas, por outro lado, nas suas disposições internas, autoriza «tratamento diferenciado», apontando em direções opostas.

Isto não é a primeira vez que a xAI recorre a ação legal por questões de regulação da IA. Em dezembro de 2025, a xAI já tinha intentado um processo contra a Califórnia, relativa ao «Genеrative AI Training Data Transparency Act» [Projeto de Lei de Transparência dos Dados de Treino de IA Generativa], argumentando que as exigências de divulgação de informação do estado constituem expressão coerciva e envolvem a divulgação de segredos comerciais, violando a Primeira Emenda e a Quinta Emenda da Constituição dos EUA. O processo do Colorado é a segunda ação judicial a nível federal da xAI no domínio da regulação da IA.

Contexto legislativo e principais pontos de controvérsia da SB 24-205

A SB 24-205 do Colorado é uma das primeiras leis estaduais dos EUA contra a discriminação em IA, aprovada a nível estadual, exigindo que os programadores de sistemas de IA de elevado risco adotem medidas de conformidade para evitar que os seus sistemas produzam efeitos discriminatórios injustificados sobre grupos protegidos. Importa notar que, antes de o Colorado e a Califórnia impulsionarem sucessivamente legislação de IA, existiram acusações de que o Grok teria, no passado, divulgado declarações associadas ao racismo, à discriminação em função do género e ao antissemitismo; alguns legisladores consideraram isso como uma das bases para impulsionar normas de combate à discriminação algorítmica.

Quatro principais alegações jurídicas apresentadas no processo da xAI

Violação da liberdade de expressão: a saída da IA é uma expressão protegida pela Primeira Emenda; o governo estadual não pode impor de forma coerciva o conteúdo da expressão

Inserção de opiniões políticas: a regulamentação exige que o Grok ajuste a saída com base na posição política do Colorado, constituindo uma interferência no conteúdo liderada pelo governo

Contradição lógica: a lei defende simultaneamente a eliminação da discriminação e a autorização de tratamento diferenciado; as disposições internas entram em conflito entre si

Interferência nos objetivos do produto: a obrigação de alterar a saída irá impedir o desenho do Grok de «procurar a verdade ao máximo»

Posição da Casa Branca: promover um quadro federal unificado em vez de um mosaico entre estados

O consultor de políticas de IA da Casa Branca, David Sacks, tem estado empenhado em promover que os estados abdquem de criarem regras próprias de supervisão da IA, defendendo a criação de um padrão único federal de IA. Em março, afirmou publicamente: «50 estados diferentes regulam a IA de 50 formas diferentes, criando confusão no sistema de regulação; torna-se difícil para os inovadores cumprir.» Sacks é atualmente copresidente do conselho consultivo de tecnologia do Presidente recém-criado, responsável por coordenar o avanço de um quadro de supervisão da IA unificado a nível nacional.

A ação que a xAI move contra o Colorado, alinhada em direção com a posição que Sacks defende de prioridade federal, intensifica ainda mais a controvérsia sobre se a soberania da supervisão da IA nos EUA deve ser da esfera federal ou das esferas estaduais.

Perguntas frequentes

Que comportamentos concretos de IA são regulados pela SB 24-205 do Colorado?

A SB 24-205 exige que, para sistemas de IA de elevado risco implantados em domínios como triagem para emprego, candidaturas a habitação e serviços financeiros, sejam tomadas medidas para evitar impactos discriminatórios injustificados sobre grupos protegidos; os programadores devem fornecer a documentação de conformidade correspondente; a regulamentação prevê-se que entre em vigor a 30 de junho de 2026.

Como evoluiu o processo que a xAI tinha intentado contra a Califórnia?

A xAI intentou em dezembro de 2025 um processo contra a Califórnia relativo ao «Genеrative AI Training Data Transparency Act» [Projeto de Lei de Transparência dos Dados de Treino de IA Generativa], argumentando que as exigências de divulgação da informação constituem expressão coerciva e envolvem a divulgação de segredos comerciais, violando a Primeira e a Quinta Emendas da Constituição. Até ao momento, o caso continua em tramitação nos tribunais federais dos EUA.

Que impacto de longo prazo poderá esta ação ter no panorama da supervisão da IA nos EUA?

Se o tribunal apoiar as alegações da xAI em matéria de Primeira Emenda, poderá enfraquecer a base jurídica das leis estaduais de combate à discriminação em IA e abrir caminho a um quadro unificado de supervisão da IA a nível federal. O rumo deste caso irá afetar diretamente as decisões legislativas de dezenas de estados que estão a considerar criar legislação semelhante.

Related Articles

IEA: Os gastos com infraestrutura de IA já ultrapassaram os investimentos na produção de petróleo e gás; em 2026, espera-se que aumentem mais 75%

O senador Bernie Sanders emite um alerta sobre a ameaça existencial da IA

Responsável pelo grande modelo de IA da Xiaomi: a competição em IA está mudando para a era dos Agentes; a autoevolução é o evento-chave para a AGI

A voz do Grok da xAI assume a linha de atendimento ao cliente da Starlink, 70% das ligações são encerradas automaticamente

GPT-5.5 Volta ao Topo em Codificação, mas a OpenAI Troca os Benchmarks Depois de Perder para o Opus 4.7

Executivo da Google DeepMind: Toda Empresa de Produtos de IA Deve Criar Benchmarks Personalizados