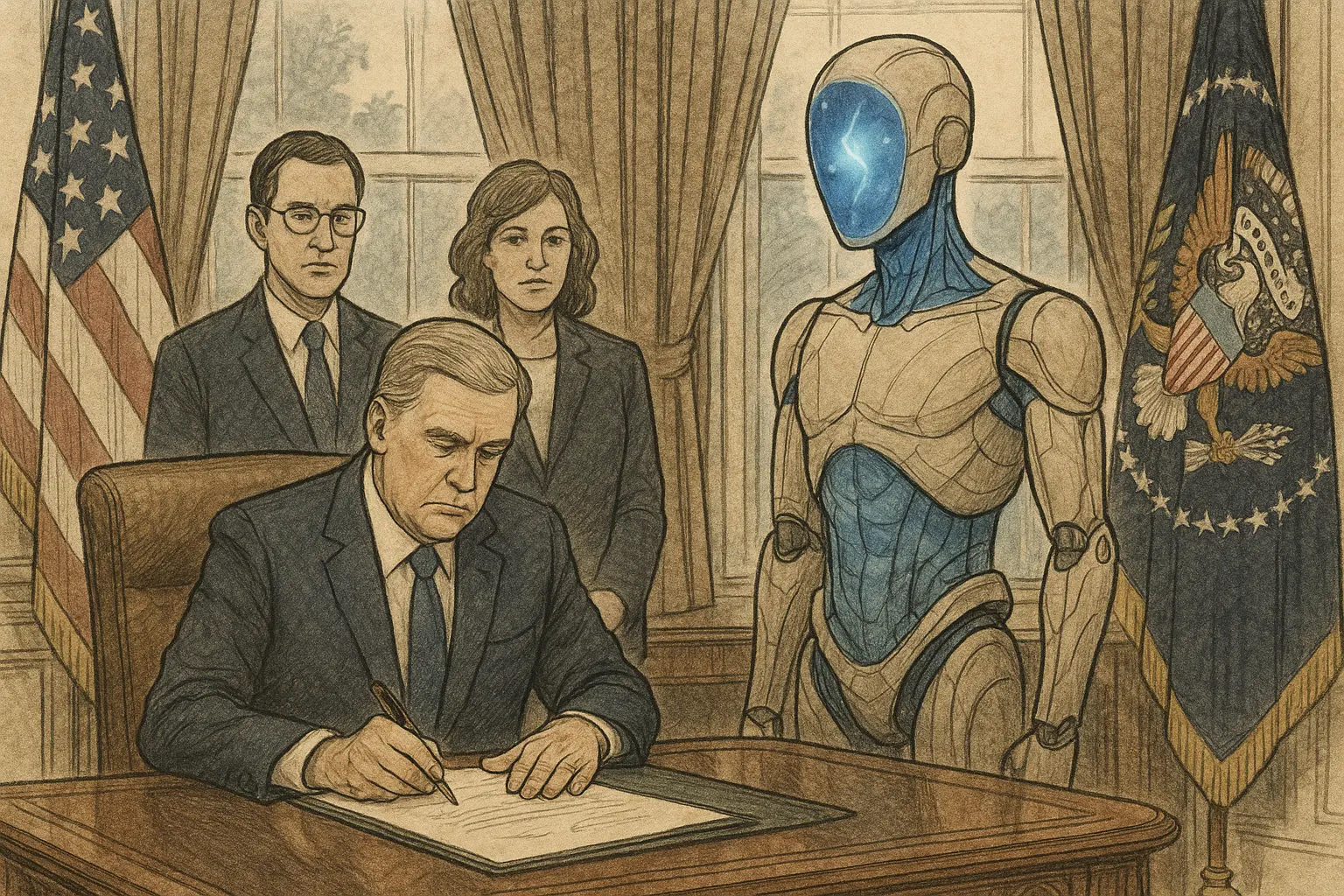

Média américain : un projet de décret présidentiel de la Maison-Blanche autorise le modèle Anthropic Mythos à entrer dans le gouvernement

Selon un rapport du 28 avril de Axios citant des initiés, la Maison-Blanche élabore des lignes directrices permettant à chaque agence fédérale de contourner l’évaluation des risques liés à la chaîne d’approvisionnement (SCRD) d’Anthropic, et d’introduire de nouveaux modèles pour un usage gouvernemental, y compris le modèle Mythos détenu par Anthropic. À ce sujet, la Maison-Blanche a publié une déclaration officielle indiquant que toute annonce de politique sera publiée directement par le président, et que toute autre version relève uniquement de la spéculation.

Contacts récents de la Maison-Blanche et mesures proposées

Selon un rapport de Axios du 28 avril, plus tôt ce mois-ci, le chef de cabinet de la Maison-Blanche Susie Wiles et le secrétaire au Trésor Scott Bessent ont rencontré conjointement le PDG d’Anthropic, Dario Amodei, et les deux parties ont décrit cette réunion comme une présentation fructueuse consacrée à l’examen des orientations de coopération entre l’entreprise et le gouvernement.

Cette semaine, la Maison-Blanche a réuni des entreprises de divers secteurs pour obtenir des informations sur d’éventuelles mesures administratives et sur les meilleures pratiques liées au déploiement du système Mythos. D’après le rapport de Axios, les réunions concernées incluaient des « lectures de scénario » (table reads) sur les directives proposées ; ces directives pourraient annuler les instructions publiées précédemment par le Bureau de la gestion et du budget (OMB), selon lesquelles les agences gouvernementales ne doivent pas utiliser les systèmes d’Anthropic. Anthropic a refusé de commenter le rapport de Axios.

Contexte du différend : évaluation des risques de la chaîne d’approvisionnement et contentieux juridique au Pentagone

Selon un rapport de Axios du 28 avril, le Pentagone (DoD) avait auparavant publié une évaluation des risques liés à la chaîne d’approvisionnement concernant Anthropic et a engagé une action en justice. Le cœur du litige tient au fait qu’Anthropic refuse de signer un accord autorisant le Pentagone à utiliser le modèle Claude dans le cadre de la norme « tous les usages licites » (incluant des applications de drones) ; les clauses d’interdiction explicites d’Anthropic comprennent la surveillance intérieure à grande échelle et le développement d’armes entièrement autonomes. Le Pentagone a déclaré que ce refus montre qu’Anthropic n’est pas un partenaire fiable.

D’après le rapport de Axios, bien que le contentieux juridique soit toujours en cours, les agences gouvernementales, y compris le Pentagone, peuvent encore utiliser une partie des modèles d’Anthropic. La NSA (National Security Agency) utilise également Mythos. Cependant, le Pentagone continue d’appliquer les anciennes conditions de service que les deux parties jugent trop strictes, et ne parvient pas à obtenir la version la plus récente des mises à jour des modèles d’Anthropic.

Position centrale d’Anthropic et comparaison entre pairs

Selon un rapport de Axios du 28 avril, Anthropic s’obstine à refuser de signer un accord « tous les usages licites », interdisant explicitement les utilisations qui incluent la surveillance intérieure à grande échelle et le développement d’armes entièrement autonomes.

Le rapport de Axios indique également que OpenAI et Google ont toutes deux signé des accords avec le Pentagone, permettant l’utilisation de leurs modèles selon la norme « tous les usages licites » dans des environnements confidentiels ; les deux entreprises affirment que les accords respectent les deux clauses d’interdiction définies par Anthropic.

Questions fréquentes

Quel est le contenu spécifique des directives d’Anthropic que la Maison-Blanche envisage d’élaborer ?

Selon un rapport du 28 avril de Axios citant des initiés, la Maison-Blanche prépare des directives permettant aux agences fédérales de contourner l’évaluation des risques liés à la chaîne d’approvisionnement d’Anthropic ; les mesures pourraient être publiées sous forme d’ordre administratif, et incluraient des directives de déploiement pour le modèle Mythos. La déclaration officielle de la Maison-Blanche indique que toute annonce de politique sera publiée directement par le président.

Quelle est la raison fondamentale du différend entre le Pentagone et Anthropic ?

Selon un rapport de Axios du 28 avril, le différend trouve son origine dans le refus d’Anthropic de signer un accord autorisant le Pentagone à utiliser le modèle Claude dans le cadre de la norme « tous les usages licites » ; les utilisations explicitement interdites incluent la surveillance intérieure à grande échelle et le développement d’armes entièrement autonomes. Le Pentagone a ensuite publié une évaluation des risques liés à la chaîne d’approvisionnement et engagé des poursuites judiciaires.

Quelle est la position d’OpenAI et de Google sur ce même sujet ?

Selon un rapport de Axios du 28 avril, OpenAI et Google ont toutes deux signé des accords avec le Pentagone, permettant l’utilisation de leurs modèles selon la norme « tous les usages licites » dans des environnements confidentiels ; et les deux entreprises affirment que les accords respectent les deux clauses d’interdiction définies par Anthropic.

Articles similaires

LG étend son partenariat avec Nvidia vers l’IA physique, couvrant la robotique et les centres de données

Le coût de tokenisation de la langue chinoise de Claude est 65 % plus élevé que celui de l’anglais ; OpenAI seulement 15 % de plus

Les analystes des semi-conducteurs voient une tendance haussière de l’IA : « au moins encore trois ans » : le conditionnement avancé est le principal goulot d’étranglement de l’industrie

AWS étend l’intégration d’OpenAI dans Amazon Bedrock

Chercheurs d’OpenAI : les systèmes d’IA pourraient gérer la plupart des travaux de recherche dans deux ans

Le roi Charles III rencontre six PDG de la tech américaine, dont Jensen Huang, Jeff Bezos et Tim Cook, pour discuter du financement des start-ups au Royaume-Uni