Les 72 heures de la crise d'identité d'Anthropic

Mardi 24 février. Washington, Pentagone.

Dario Amodei, PDG d’Anthropic, fait face au secrétaire à la Défense Pete Hegseth. Selon NPR et CNN, la rencontre fut « polie », mais le contenu, lui, fut tout sauf apaisé.

Hegseth pose un ultimatum : lever toutes les restrictions d’usage militaire sur Claude avant vendredi 17h01 et autoriser le Pentagone à l’utiliser « pour toutes fins légales », y compris le ciblage autonome et la surveillance intérieure à grande échelle.

À défaut, le contrat de 200 millions de dollars serait annulé. Le Defense Production Act s’appliquerait pour une réquisition forcée. Anthropic serait alors classée « risque pour la chaîne d’approvisionnement », rejoignant ainsi la liste noire des adversaires comme la Russie et la Chine.

Ce même jour, Anthropic publie la troisième édition de sa Responsible Scaling Policy (RSP 3.0), supprimant discrètement son engagement fondateur : ne pas entraîner de modèles plus puissants sans garanties de sécurité en place.

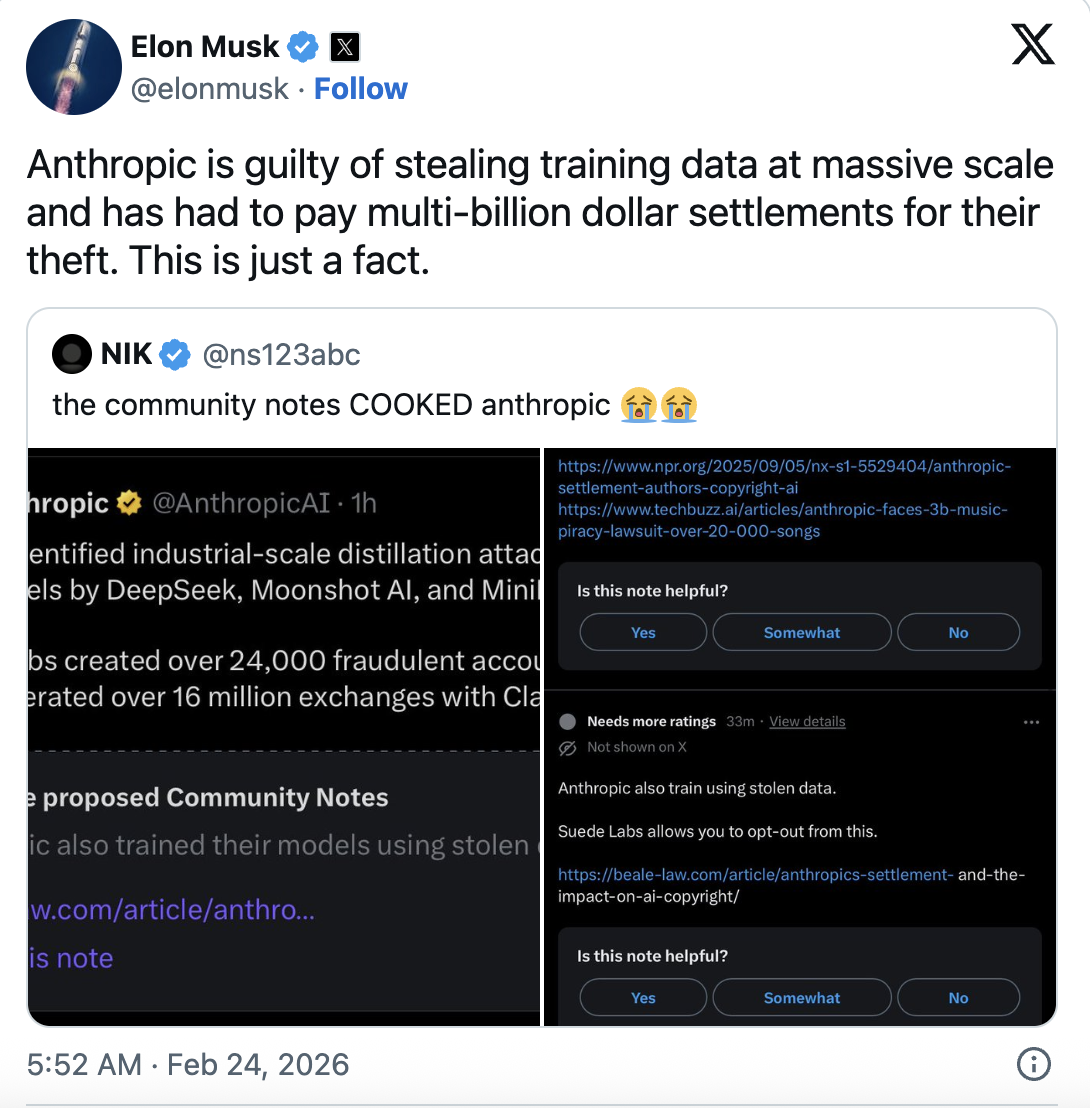

Le même jour, Elon Musk déclare sur X : « Anthropic s’est livrée à un vol massif de données d’entraînement — c’est un fait. » Dans le même temps, Community Notes sur X mentionne des rapports selon lesquels Anthropic aurait versé 1,5 milliard de dollars pour solder des plaintes sur l’entraînement de Claude à partir de livres piratés.

En soixante-douze heures, cette société d’IA — qui se disait dotée d’une « âme » — est devenue trois choses : martyr de la sécurité, voleur de propriété intellectuelle, et transfuge du Pentagone.

Qui est le vrai Anthropic ?

Peut-être tous à la fois.

L’injonction du Pentagone : « Se conformer ou partir »

La première couche de l’affaire est limpide.

Anthropic fut la première société d’IA à décrocher un accès classifié du Department of Defense américain, avec un contrat signé l’été dernier et plafonné à 200 millions de dollars. OpenAI, Google et xAI ont ensuite obtenu des contrats similaires.

Selon Al Jazeera, Claude a été déployé lors d’une opération militaire américaine en janvier, visant l’enlèvement du président vénézuélien Maduro.

Mais Anthropic a tracé deux lignes rouges : pas de soutien au ciblage totalement autonome d’armes, ni à la surveillance de masse des citoyens américains. Anthropic considère que l’IA n’est pas assez fiable pour contrôler des armes, et qu’aucune loi ne régit l’IA dans la surveillance de masse.

Le Pentagone n’a pas été convaincu.

En octobre, le conseiller IA de la Maison-Blanche, David Sacks, a accusé publiquement Anthropic sur X de « manipuler la peur pour capter la régulation ».

Les concurrents ont déjà cédé. OpenAI, Google et xAI ont accepté que l’armée utilise leur IA pour « tous scénarios légaux ». Grok de Musk a été validé cette semaine pour les systèmes classifiés.

Anthropic reste le dernier à tenir tête.

À l’heure de publication, Anthropic affirme dans sa dernière annonce qu’elle n’a pas l’intention de céder. Mais l’échéance de vendredi 17h01 approche.

Un ancien intermédiaire anonyme entre le Department of Justice et le Pentagone confie à CNN : « Comment peut-on qualifier une entreprise de “risque pour la chaîne d’approvisionnement” tout en la forçant à servir l’armée ? »

Question pertinente — mais le Pentagone ne s’en soucie pas. Leur unique préoccupation : si Anthropic refuse de plier, ils imposeront la conformité ou l’excluront de Washington.

« Distillation Attack » : une accusation publique qui se retourne

Le 23 février, Anthropic publie un blog incisif accusant trois sociétés chinoises d’IA — DeepSeek, Moonshot AI et MiniMax — de « distillation à l’échelle industrielle » sur Claude.

Anthropic affirme que ces entreprises ont utilisé 24 000 faux comptes pour générer plus de 16 millions d’interactions avec Claude, extrayant systématiquement ses capacités clés en raisonnement d’agents, utilisation d’outils et programmation.

Anthropic présente cela comme une menace pour la sécurité nationale, estimant que les modèles distillés « risquent de perdre les garde-fous de sécurité » et pourraient servir à des gouvernements autoritaires pour des cyberattaques, de la désinformation et la surveillance de masse.

Le récit est opportun et bien construit.

Il survient juste après l’assouplissement des contrôles américains sur l’exportation de puces vers la Chine — moment où Anthropic avait besoin de nouveaux arguments pour son lobbying sur les semi-conducteurs.

Mais Musk réplique : « Anthropic s’est livrée à un vol massif de données d’entraînement et a versé des milliards en règlements. C’est un fait. »

Tory Green, cofondateur de IO.Net, commente : « Vous entraînez vos modèles sur tout Internet, et quand d’autres apprennent via votre API publique, vous appelez cela une “attaque de distillation” ? »

Anthropic qualifie la distillation d’« attaque », mais il s’agit d’une pratique standard dans l’industrie de l’IA. OpenAI l’a utilisée pour compresser GPT-4, Google pour optimiser Gemini, et Anthropic elle-même y a eu recours. La seule différence : cette fois, Anthropic est la cible.

Comme le résume Erik Cambria, professeur d’IA à la Nanyang Technological University, pour CNBC : « La frontière entre usage légitime et exploitation malveillante est souvent floue. »

Encore plus ironique, Anthropic vient de verser 1,5 milliard de dollars pour solder des plaintes sur l’entraînement de Claude à partir de livres piratés. Ils se sont entraînés sur tout Internet, puis accusent d’autres d’apprendre via leur API publique. Ce n’est pas juste deux poids, deux mesures : c’est trois poids, trois mesures.

Anthropic voulait jouer la victime, mais se retrouve accusée.

Démantèlement des engagements de sécurité : RSP 3.0

Le jour même où Anthropic affrontait le Pentagone et Silicon Valley, elle publie la version 3 de sa Responsible Scaling Policy.

Le Chief Scientist Jared Kaplan déclare aux médias : « Suspendre la formation des modèles d’IA n’aide personne. Avec la vitesse du développement, prendre des engagements unilatéraux alors que la concurrence avance à plein régime n’a aucun sens. »

Autrement dit : si les autres ne respectent pas les règles, nous non plus.

Le cœur des RSP 1.0 et 2.0 était un engagement strict : si les capacités du modèle dépassaient la couverture des mesures de sécurité, l’entraînement s’arrêtait. Ce principe a valu à Anthropic une réputation unique dans la communauté IA safety.

Mais la version 3.0 abandonne cette promesse.

Elle la remplace par un cadre plus « flexible » — dissociant les mesures de sécurité internes des recommandations sectorielles. Tous les 3 à 6 mois, un rapport de risque sera publié, avec revue externe.

Est-ce vraiment responsable ?

Chris Painter, évaluateur indépendant du groupe METR, constate après avoir vu une version préliminaire : « Anthropic estime devoir passer en “mode triage” car l’évaluation et la gestion des risques ne suivent plus la croissance des capacités. C’est une preuve que la société n’est pas prête aux risques catastrophiques de l’IA. »

TIME rapporte qu’Anthropic a débattu en interne près d’un an sur cette réécriture, avec un aval unanime du PDG Amodei et du conseil. Officiellement, la politique initiale devait entraîner un consensus sectoriel — mais ce ne fut pas le cas. L’administration Trump a adopté une ligne non-interventionniste sur l’IA, allant jusqu’à tenter d’abroger des lois d’État. Une législation fédérale sur l’IA reste hors de portée. En 2023, un cadre mondial de gouvernance semblait possible, mais trois ans plus tard, la porte est fermée.

Un chercheur anonyme de longue date en gouvernance IA résume : « La RSP est l’atout de marque le plus précieux d’Anthropic. Abandonner la pause d’entraînement, c’est comme si une entreprise bio retirait discrètement “bio” de son étiquette, puis affirmait que ses contrôles sont désormais plus transparents. »

Crise d’identité à 380 milliards de dollars de valorisation

Début février, Anthropic boucle un tour de table de 30 milliards de dollars sur une valorisation de 380 milliards, avec Amazon en chef de file. Depuis sa création, elle atteint 14 milliards de dollars de chiffre d’affaires annualisé, multiplié par plus de dix chaque année ces trois dernières années.

Dans le même temps, le Pentagone menace de l’exclure. Musk l’accuse publiquement de vol de données. Son engagement central sur la sécurité disparaît. Le responsable IA safety, Mrinank Sharma, démissionne et écrit sur X : « Le monde est en danger. »

Contradiction ?

Peut-être que la contradiction est l’ADN d’Anthropic.

Fondée par d’anciens dirigeants d’OpenAI inquiets du rythme de sécurité d’OpenAI, Anthropic a développé des modèles plus puissants, plus vite, tout en alertant sur leur dangerosité.

Le business model résumé : nous craignons l’IA plus que quiconque, donc payez-nous pour la construire.

Ce narratif a parfaitement fonctionné en 2023–2024. La sécurité IA était le mot-clé à Washington, et Anthropic le lobbyiste en vue.

En 2026, le vent a tourné.

« Woke AI » devient une insulte politique, la régulation IA au niveau des États est bloquée par la Maison-Blanche, et si la SB 53 californienne (soutenue par Anthropic) devient loi, rien ne bouge au niveau fédéral.

Le narratif sécurité d’Anthropic passe de « différenciateur » à « handicap politique ».

Anthropic cherche un équilibre complexe — il faut être assez « sûr » pour préserver la marque, mais assez « flexible » pour ne pas être rejeté par le marché ou le gouvernement. Le problème : la tolérance se réduit des deux côtés.

Quelle valeur reste-t-il au narratif sécurité ?

Pris ensemble, ces trois épisodes dessinent un tableau clair.

Accuser les entreprises chinoises de distiller Claude renforce le lobbying sur le contrôle des exportations de puces. Abandonner la pause sécurité maintient Anthropic dans la course à l’armement. Refuser la demande du Pentagone sur les armes autonomes préserve une dernière couche de crédibilité morale.

Chaque choix est logique, mais tous se contredisent.

On ne peut pas prétendre que la distillation de son modèle par des sociétés chinoises menace la sécurité nationale tout en supprimant sa propre promesse d’empêcher le modèle de devenir incontrôlable. Si le modèle est si dangereux, il faudrait plus de prudence — pas plus d’agressivité.

Sauf si l’on s’appelle Anthropic.

Dans l’industrie IA, l’identité ne se définit pas par les déclarations, mais par le bilan. Le narratif « sécurité » d’Anthropic n’est, au fond, qu’une prime de marque.

Au début de la course à l’IA, cette prime valait cher. Les investisseurs payaient plus pour une « IA responsable », les gouvernements validaient une « IA de confiance », et les clients achetaient une « IA plus sûre ».

Mais en 2026, cette prime s’efface.

Anthropic n’affronte plus la question « faut-il faire des compromis », mais « avec qui faire des compromis en premier ». Céder au Pentagone, et la marque est atteinte. Céder aux concurrents, et la promesse de sécurité disparaît. Céder aux investisseurs, et il faut lâcher sur les deux fronts.

Vendredi à 17h01, Anthropic tranchera.

Quelle que soit l’issue, une chose est certaine : l’Anthropic qui prospérait sur « nous sommes différents d’OpenAI » ressemble désormais à tous les autres.

La fin d’une crise d’identité, c’est souvent la disparition de l’identité elle-même.

Déclaration :

- Cet article est une republication de [TechFlow]. Les droits d’auteur appartiennent à l’auteur original [Ada]. Pour toute question sur cette republication, veuillez contacter l’équipe Gate Learn, qui traitera votre demande selon la procédure en vigueur.

- Avertissement : Les opinions et points de vue exprimés dans cet article n’engagent que l’auteur et ne constituent pas un conseil en investissement.

- Les autres versions linguistiques de cet article sont traduites par l’équipe Gate Learn. Sans mention de Gate, les articles traduits ne peuvent être copiés, distribués ou plagiés.

Articles Connexes

Plasma (XPL) face aux systèmes de paiement traditionnels : une nouvelle approche du règlement transfrontalier et du cadre de liquidité pour les stablecoins

Comment Midnight assure-t-il la confidentialité sur la blockchain ? Analyse des preuves à divulgation nulle de connaissance et des mécanismes de confidentialité programmables

La relation entre Midnight et Cardano : comment une sidechain axée sur la confidentialité élargit l’écosystème applicatif de Cardano

Analyse de la Tokenomics de Morpho : cas d'utilisation de MORPHO, distribution et proposition de valeur

Morpho vs Aave : analyse des différences de mécanisme et de structure entre les protocoles de prêt DeFi