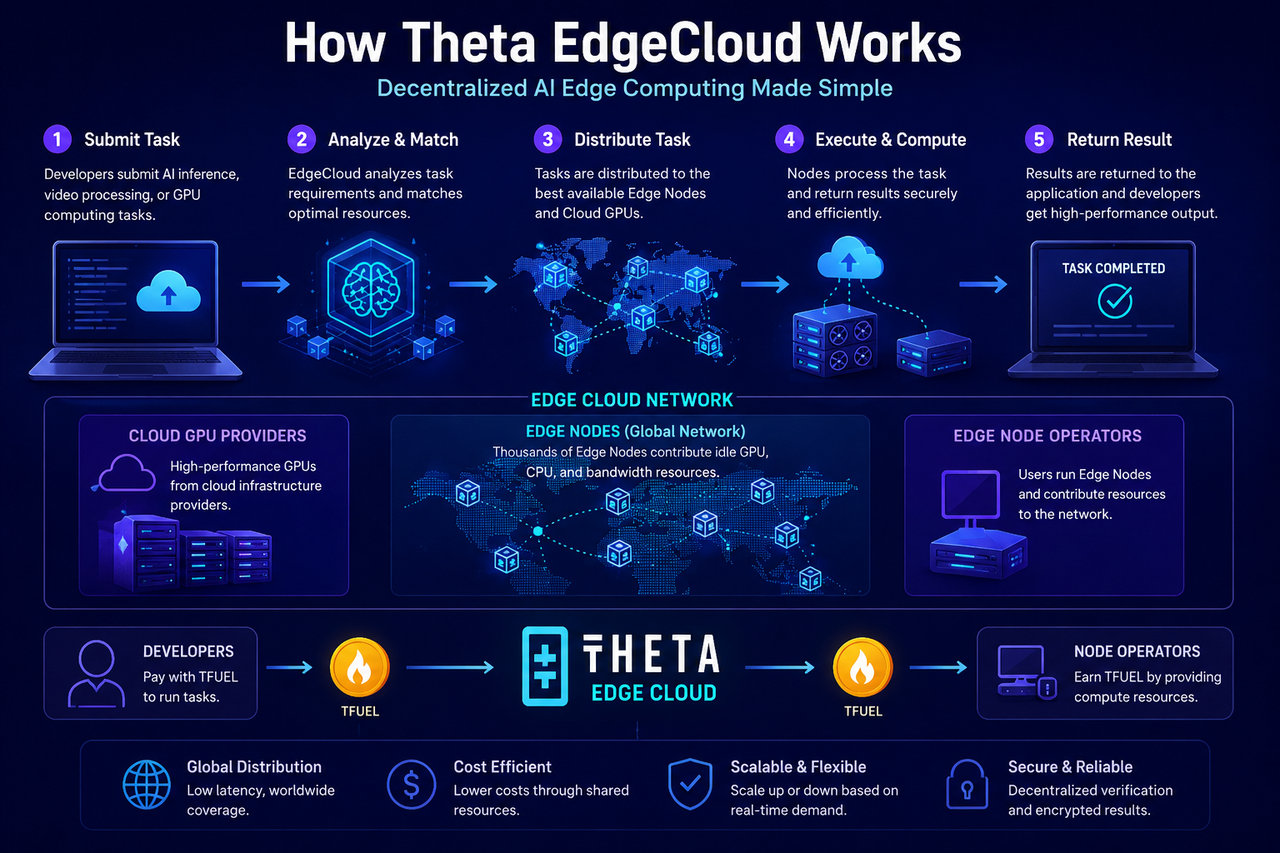

Comment fonctionne Theta EdgeCloud ? Analyse détaillée du flux de travail complet de l'edge computing (informatique en périphérie) dédiée à l'intelligence artificielle (IA)

Les services cloud d’IA traditionnels reposent sur de grands centres de données centralisés. Cette architecture offre une puissance de calcul importante, mais entraîne aussi des coûts GPU élevés, une gestion centralisée des ressources et des difficultés de montée en charge. Theta EdgeCloud vise à répondre à ces enjeux en intégrant les nœuds Edge à l’informatique cloud, agrégeant les GPU inactifs du monde entier dans un réseau unifié pour optimiser l’utilisation des ressources et renforcer la collaboration distribuée.

Dans un contexte de concurrence croissante sur l’infrastructure IA, Theta EdgeCloud s’impose comme un modèle de référence en matière de DePIN (Decentralized Physical Infrastructure Network) et de solutions de réseau GPU distribué. Plutôt que de remplacer totalement les plateformes cloud classiques, son objectif principal est d’offrir une collaboration de ressources plus flexible pour l’inférence IA et les scénarios d’edge computing.

Qu’est-ce que Theta EdgeCloud

Theta EdgeCloud est une plateforme cloud hybride d’IA construite sur l’écosystème Theta Network. Sa stratégie principale consiste à associer des nœuds Edge distribués à des services GPU cloud traditionnels pour former un réseau unifié de ressources de calcul.

Contrairement aux services cloud IA centralisés, Theta EdgeCloud s’appuie non seulement sur les serveurs cloud, mais aussi sur des nœuds Edge exploités par des utilisateurs à l’échelle mondiale. Ces nœuds partagent leurs ressources GPU, CPU et bande passante inactives pour alimenter l’inférence IA, le transcodage vidéo et le rendu.

Pour les développeurs, Theta EdgeCloud agit comme une couche de calcul IA qui orchestre dynamiquement les ressources distribuées. Ils soumettent simplement leurs tâches via la plateforme, le système gérant automatiquement l’allocation et l’exécution des ressources — sans gestion directe des nœuds.

En quoi Theta EdgeCloud diffère-t-il des services cloud d’IA traditionnels

Les plateformes cloud IA traditionnelles s’appuient sur de grands centres de données pour fournir des services GPU centralisés, la gestion et la planification des ressources étant assurées par le fournisseur cloud. Ce modèle, stable et mature, reste exposé aux pénuries de GPU et à la hausse des coûts.

À l’inverse, Theta EdgeCloud privilégie le partage des ressources en périphérie. Les nœuds Edge du monde entier peuvent mettre à disposition leurs GPU inactifs pour une réutilisation. Lorsqu’une tâche IA est soumise, la plateforme alloue les ressources selon les besoins de la tâche, le statut des nœuds et la puissance de calcul disponible.

Les différences majeures entre Theta EdgeCloud et les plateformes cloud IA classiques sont :

| Dimension de comparaison | Plateforme cloud IA traditionnelle | Theta EdgeCloud |

|---|---|---|

| Source des ressources | Centre de données centralisé | GPU cloud + nœud Edge |

| Structure réseau | Centralisée | Distribuée |

| Planification GPU | Gestion centralisée de la plateforme | Collaboration dynamique des nœuds |

| Participation des nœuds | Fournisseur de services cloud | Ressources partagées par les utilisateurs |

| Mécanisme d’incitation | Frais de service | Mécanisme de récompense TFUEL |

Cette approche fait de Theta EdgeCloud un véritable réseau GPU distribué, et non une simple plateforme cloud conventionnelle.

Que se passe-t-il lorsque les utilisateurs soumettent des tâches IA

Quand des développeurs ou applications soumettent des tâches d’inférence IA, de traitement vidéo ou de rendu, Theta EdgeCloud analyse d’abord les besoins en ressources (type de GPU, mémoire, temps de calcul, bande passante).

Le système identifie ensuite les ressources de nœuds adaptées sur le réseau. Certaines tâches sont traitées par des GPU cloud, d’autres distribuées aux nœuds Edge à travers le monde pour un traitement collaboratif. Ce processus est entièrement automatisé, sans sélection manuelle de nœud pour les développeurs.

Pendant l’exécution, le système surveille en continu le statut des nœuds et l’évolution des tâches. Si des nœuds se déconnectent ou manquent de ressources, la plateforme réattribue les tâches pour garantir la stabilité du calcul.

À la fin, les résultats sont transmis à la couche applicative et les nœuds participants reçoivent des récompenses TFUEL en fonction de leur contribution.

Il s’agit d’un « système de planification de ressources distribuées » unifiant l’utilisation de la puissance de calcul inoccupée sur le réseau.

Comment les nœuds Edge contribuent-ils au calcul GPU

Les nœuds Edge sont au cœur de Theta EdgeCloud. En exécutant un nœud Edge, les utilisateurs connectent leurs ressources GPU et de calcul locales au réseau Theta.

Lorsque le réseau détecte une demande d’inférence IA, de rendu vidéo ou d’edge computing, les tâches sont attribuées à ces nœuds. Après exécution, les nœuds reçoivent des récompenses TFUEL proportionnelles aux ressources de calcul fournies.

Contrairement aux machines de minage classiques, les nœuds Edge de Theta ne se consacrent pas au minage PoW, mais à la fourniture de véritables ressources de calcul. C’est pourquoi Theta est souvent considéré comme un projet DePIN.

Pour la majorité des utilisateurs, les nœuds Edge constituent à la fois la porte d’entrée au réseau Theta et un élément clé de son mécanisme de partage des ressources.

Comment TFUEL circule-t-il dans EdgeCloud

TFUEL est le utility token principal de Theta EdgeCloud, utilisé comme moyen de paiement et d’incitation sur le réseau.

Lorsque des développeurs soumettent des tâches IA ou vidéo, ils paient en TFUEL sous forme de frais de ressources. Le système redistribue ensuite une partie des TFUEL aux nœuds Edge ayant exécuté les calculs, selon la tâche réalisée.

Dans l’écosystème EdgeCloud, TFUEL relie :

-

les développeurs d’applications IA

-

les fournisseurs de ressources GPU

-

le réseau de nœuds Edge

-

l’infrastructure Theta

Ce mécanisme crée une boucle « paiement des tâches — exécution des ressources — récompenses aux nœuds ».

Principaux cas d’usage de Theta EdgeCloud

Theta EdgeCloud cible principalement les usages IA et le calcul média.

En IA, les applications incluent :

-

l’inférence de modèles IA

-

l’inférence de grands modèles de langage

-

la génération d’images

-

le calcul GPU distribué

Pour la vidéo et les médias, Theta EdgeCloud prend en charge :

-

le transcodage vidéo

-

le rendu vidéo

-

le traitement du streaming en direct

-

la diffusion de contenu en périphérie

La distribution mondiale des nœuds Edge permet aux tâches à forte exigence de temps réel de s’appuyer sur l’edge computing pour réduire la latence.

À mesure que l’IA et l’infrastructure Web3 convergent, Theta EdgeCloud devient un pilier de l’expansion de Theta du secteur vidéo vers l’IA.

Défis de Theta EdgeCloud

Bien que les réseaux GPU distribués offrent partage des ressources et évolutivité, Theta EdgeCloud doit encore relever des défis concrets.

Tout d’abord, les nœuds Edge ne disposent pas tous des mêmes capacités matérielles : les écarts de performance GPU peuvent impacter l’efficacité des tâches. Ensuite, la nature distribuée du réseau complique la planification des ressources et la gestion des tâches.

En parallèle, la concurrence sur le marché de l’infrastructure IA s’intensifie, opposant plateformes cloud classiques et autres projets de réseaux GPU distribués pour capter la demande en calcul IA.

Enfin, la demande croissante en GPU haute performance, portée par l’IA générative, fait de l’accès et de la planification stables des ressources GPU un défi structurel pour EdgeCloud.

Résumé

Theta EdgeCloud, lancé par Theta Network comme plateforme décentralisée d’IA et d’edge computing, vise à bâtir un réseau distribué de calcul IA en orchestrant nœuds Edge mondiaux et GPU cloud.

Par rapport aux services cloud IA centralisés, Theta EdgeCloud privilégie le partage des ressources en périphérie, la collaboration GPU et la planification distribuée. Les développeurs soumettent leurs tâches d’inférence IA et de traitement vidéo sur la plateforme, les nœuds mondiaux les exécutent et perçoivent des récompenses TFUEL.

Alors que la demande en inférence IA et en ressources GPU progresse, Theta EdgeCloud accompagne l’évolution de Theta, d’une plateforme de streaming vidéo vers une solution complète d’infrastructure IA.

FAQ

Comment fonctionne Theta EdgeCloud ?

Lorsque des développeurs soumettent des tâches IA ou vidéo, le système les affecte automatiquement aux GPU cloud et aux nœuds Edge pour un traitement collaboratif, TFUEL assurant le paiement des ressources et les récompenses.

Quel rôle jouent les nœuds Edge dans EdgeCloud ?

Les nœuds Edge fournissent GPU et puissance de calcul pour exécuter l’inférence IA, le rendu vidéo et les tâches d’edge computing.

En quoi Theta EdgeCloud diffère-t-il des services cloud IA traditionnels ?

Les services cloud IA traditionnels reposent sur des centres de données centralisés, alors que Theta EdgeCloud combine nœuds Edge et GPU cloud pour bâtir un réseau de ressources distribué.

À quoi sert TFUEL dans EdgeCloud ?

TFUEL sert à régler les frais des tâches IA et vidéo, et constitue aussi le token de récompense pour les nœuds à l’issue des tâches.

Theta EdgeCloud est-il un projet DePIN ?

Puisque son modèle repose sur le partage des ressources GPU et d’edge computing, Theta EdgeCloud est souvent classé comme projet DePIN et réseau GPU distribué.

Articles Connexes

Comment Midnight assure-t-il la confidentialité sur la blockchain ? Analyse des preuves à divulgation nulle de connaissance et des mécanismes de confidentialité programmables

La relation entre Midnight et Cardano : comment une sidechain axée sur la confidentialité élargit l’écosystème applicatif de Cardano

Morpho vs Aave : analyse des différences de mécanisme et de structure entre les protocoles de prêt DeFi

Qu'est-ce qui constitue l'écosystème Solana (SOL) ? Analyse de ses cas d'utilisation et de sa structure d'infrastructure

Analyse de la Tokenomics de Morpho : cas d'utilisation de MORPHO, distribution et proposition de valeur