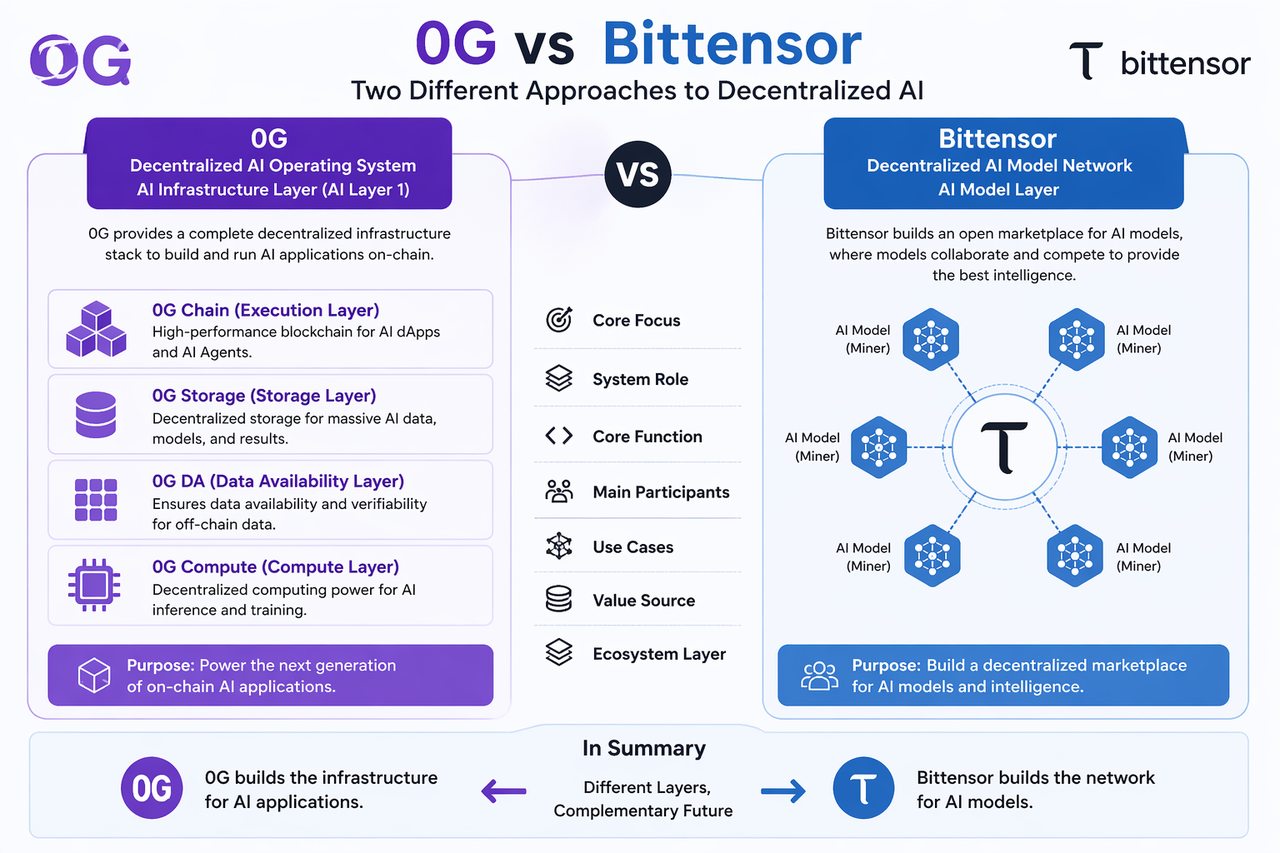

0G vs Bittensor : principales différences entre l’infrastructure IA décentralisée et les réseaux de modèles IA

À mesure que l’intégration de l’IA et de la blockchain s’accélère, l’IA décentralisée évolue selon deux trajectoires distinctes. La première vise à construire des réseaux collaboratifs autour des modèles d’IA eux-mêmes, tandis que la seconde porte sur le développement de l’infrastructure fondamentale qui alimente les applications d’IA.

Bittensor et 0G illustrent parfaitement ces deux approches. Bittensor se consacre à la collaboration mondiale entre modèles d’IA via des mécanismes d’incitation, alors que 0G est conçu pour offrir des environnements performants et évolutifs dédiés aux applications d’IA. Cette divergence stratégique définit leur positionnement au sein de l’écosystème.

0G et Bittensor : positionnement dans l’écosystème IA

0G et Bittensor occupent chacun une couche spécifique dans l’écosystème de l’IA.

0G constitue l’infrastructure de base (couche d’infrastructure IA), fournissant des environnements opérationnels pour les applications d’IA, incluant la puissance de calcul, le stockage et la disponibilité des données. Sa mission : devenir l’AI Layer1, permettant aux Agents IA de fonctionner efficacement on-chain.

Bittensor, pour sa part, opère au niveau protocolaire, reliant fournisseurs de modèles d’IA et validateurs via des mécanismes d’incitation afin de créer un marché décentralisé de modèles IA.

En résumé, 0G se concentre sur « l’exécution de l’IA », tandis que Bittensor privilégie « la connexion de l’IA ».

Comparaison centrale : 0G vs Bittensor

Sous l’angle de l’architecture système, leurs différences fondamentales apparaissent clairement au niveau de la couche infrastructure.

| Dimension de comparaison | 0G | Bittensor |

|---|---|---|

| Positionnement central | Infrastructure IA décentralisée (AI Layer1) | Réseau décentralisé de modèles d’IA |

| Objectif principal | Fournir des environnements opérationnels pour les AI dApps et Agents IA | Construire un réseau ouvert de collaboration et d’incitation pour les modèles d’IA |

| Rôle système | Couche d’infrastructure des applications IA | Couche réseau de modèles IA et d’inférence |

| Architecture technique | Modulaire : chaîne, stockage, DA, calcul | Réseau d’apprentissage automatique piloté par des sous-réseaux |

| Capacités clés | Exécution, stockage, disponibilité des données, calcul décentralisé | Entraînement des modèles IA, inférence, incitations à la contribution |

| Public cible | Développeurs IA et créateurs d’applications | Fournisseurs de modèles IA et chercheurs |

| Scénarios d’application | Agents IA, applications IA on-chain, AI dApps | Services d’inférence décentralisés, marchés de modèles |

| Source de valeur | Utilisation de l’infrastructure, demande en applications IA | Contributions des modèles, récompenses pour la qualité d’inférence |

| Niveau d’écosystème | Couche d’infrastructure IA (Infra Layer) | Couche réseau de modèles IA (Model Layer) |

| Positionnement relationnel | Support fondamental pour les applications IA | Réseau fournissant l’intelligence IA |

0G est un réseau AI Layer1 modulaire, intégrant les couches exécution, stockage, DA (data availability) et calcul, toutes pensées pour supporter la charge de travail IA.

Bittensor, de son côté, repose sur des mécanismes d’incitation, avec la structure de sous-réseaux au cœur du protocole, orchestrant la contribution et la distribution des récompenses entre modèles d’IA, formant ainsi un véritable « système économique de modèles d’IA ».

0G : le réseau d’infrastructure AI Layer1

0G est conçu comme une pile d’infrastructure IA complète, permettant l’exécution native d’applications IA on-chain.

Son architecture à quatre couches prend en charge les Agents IA et les applications IA on-chain, comprenant :

- La couche d’exécution pour le traitement logique

- La couche de stockage pour la persistance des données

- La couche DA pour la validation des données

- La couche de calcul pour la puissance de hachage décentralisée

De cette manière, 0G agit comme un « système d’exploitation IA », mettant l’accent sur la puissance de calcul et la robustesse de l’infrastructure.

Bittensor : réseau décentralisé de modèles IA

La vocation principale de Bittensor est de bâtir un réseau ouvert de modèles IA, favorisant concurrence et collaboration entre modèles par le biais d’incitations.

Dans ce système, chaque modèle agit comme un nœud, participant au réseau et obtenant des récompenses selon la qualité de ses contributions. Cette structure s’apparente davantage à un Marché de modèles IA qu’à une couche d’infrastructure.

Ainsi, Bittensor se concentre sur « la production et la distribution de l’intelligence IA », et non sur « l’environnement opérationnel pour l’IA ».

Différences de scénarios d’application : 0G vs Bittensor

0G est le plus adapté aux applications IA on-chain exigeant de fortes capacités de calcul et de stockage, comme les Agents IA, les systèmes d’exécution autonomes ou les tâches d’inférence complexes.

Bittensor, à l’inverse, se prête idéalement à l’entraînement de modèles IA, au partage de modèles et à la collaboration distribuée—pour des cas d’usage tels que marchés de modèles ou réseaux de services d’inférence.

Ils ne sont donc pas en concurrence directe sur la couche application, mais occupent chacun une position spécifique au sein de la stack IA.

Rôle dans l’écosystème : comparaison 0G vs Bittensor

Dans l’écosystème IA décentralisé, Bittensor agit principalement au niveau de la couche modèle, en fournissant l’intelligence IA, tandis que 0G assure la couche infrastructure, délivrant puissance de calcul, stockage et environnements d’exécution.

À mesure que l’écosystème IA se structure, ces systèmes devraient s’avérer complémentaires : les réseaux de modèles apportent l’intelligence, l’infrastructure fournit la base opérationnelle, et ensemble ils ouvrent la voie à des écosystèmes d’applications IA plus avancés.

Résumé

0G et Bittensor incarnent deux voies distinctes dans le développement de l’IA décentralisée. Bittensor se concentre sur les réseaux de modèles IA, créant un marché ouvert du machine learning via des incitations, tandis que 0G se consacre à l’infrastructure IA, offrant un environnement on-chain complet pour les applications IA.

Ils n’entrent pas en concurrence directe, chacun occupant une couche spécifique de l’écosystème IA. À mesure que les applications IA se développent, réseaux de modèles et infrastructures devraient collaborer davantage, accélérant ensemble l’évolution de l’écosystème IA décentralisé.

FAQ

Quelle est la différence majeure entre 0G et Bittensor ?

0G est une AI Infrastructure Layer1 fournissant calcul et stockage, tandis que Bittensor est un réseau de modèles IA axé sur la collaboration et la distribution d’incitations.

À quelle couche appartient 0G dans l’architecture IA ?

0G relève de la couche d’infrastructure IA, spécialisée dans les environnements opérationnels IA on-chain et l’infrastructure de calcul.

Quel est le mécanisme central de Bittensor ?

Bittensor relie les nœuds de modèles IA via des mécanismes d’incitation, permettant aux modèles de rivaliser et d’être récompensés au sein du réseau.

0G et Bittensor peuvent-ils fonctionner ensemble ?

Oui, ils opèrent à des couches différentes de la stack IA : l’un fournit l’infrastructure, l’autre le réseau de modèles.

Lequel est le plus orienté infrastructure ?

0G est le plus orienté infrastructure (AI Layer1), tandis que Bittensor est davantage orienté réseau d’applications (AI Model Layer).

Articles Connexes

Plasma (XPL) face aux systèmes de paiement traditionnels : une nouvelle approche du règlement transfrontalier et du cadre de liquidité pour les stablecoins

Jito vs Marinade : analyse comparative des protocoles de Staking de liquidité sur Solana

Analyse des Tokenomics de JTO : distribution, utilité et valeur à long terme

Comment Midnight assure-t-il la confidentialité sur la blockchain ? Analyse des preuves à divulgation nulle de connaissance et des mécanismes de confidentialité programmables

Morpho vs Aave : analyse des différences de mécanisme et de structure entre les protocoles de prêt DeFi