AI-Prüfung geht in die Praxis, OpenAI veröffentlicht EVMbench, zur Verstärkung der Sicherheitseinstufung von Smart Contracts

OpenAI kooperiert mit Paradigm bei der Einführung von EVMbench, um die Fähigkeiten von KI-Agenten bei Angriffen und Verteidigung in EVM-Verträgen zu testen und die Sicherheitslage zu offenbaren.

Fokus auf realistische Tests in der Wirtschaftsumgebung, OpenAI und Paradigm stärken die On-Chain-Sicherheitsbewertungen

Der führende Anbieter Künstlicher Intelligenz, OpenAI, kündigte eine Zusammenarbeit mit dem bekannten Kryptowährungs-Risikokapitalgeber Paradigm sowie dem Sicherheitsunternehmen OtterSec an, um das Benchmark-Tool EVMbench zu entwickeln, das die Sicherheitsleistung von KI-Agenten (AI Agents) bei Ethereum Virtual Machine (EVM)-Smart Contracts bewertet.

Mit der zunehmenden Verschmelzung von KI und Krypto-Technologien sind Smart Contracts zu einer zentralen Infrastruktur für die Verwaltung von über 100 Milliarden an Open-Source-Kryptogütern geworden. Die Einführung dieses Tools markiert den Beginn einer ernsthaften Auseinandersetzung der Branche mit den praktischen Fähigkeiten von KI in wirtschaftlich relevanten Umgebungen.

Das OpenAI-Team betont, dass mit den Fortschritten der KI-Agenten in den Bereichen Programmieren und Planung, diese Modelle künftig eine transformative Rolle bei Angriffen und Verteidigungen auf Blockchain spielen werden. Daher ist die Entwicklung eines standardisierten Bewertungsrahmens für die Überwachung des KI-Fortschritts von entscheidender Bedeutung.

Drei tiefgehende Testmodi, 120 reale Schwachstellen als Prüfstein für KI

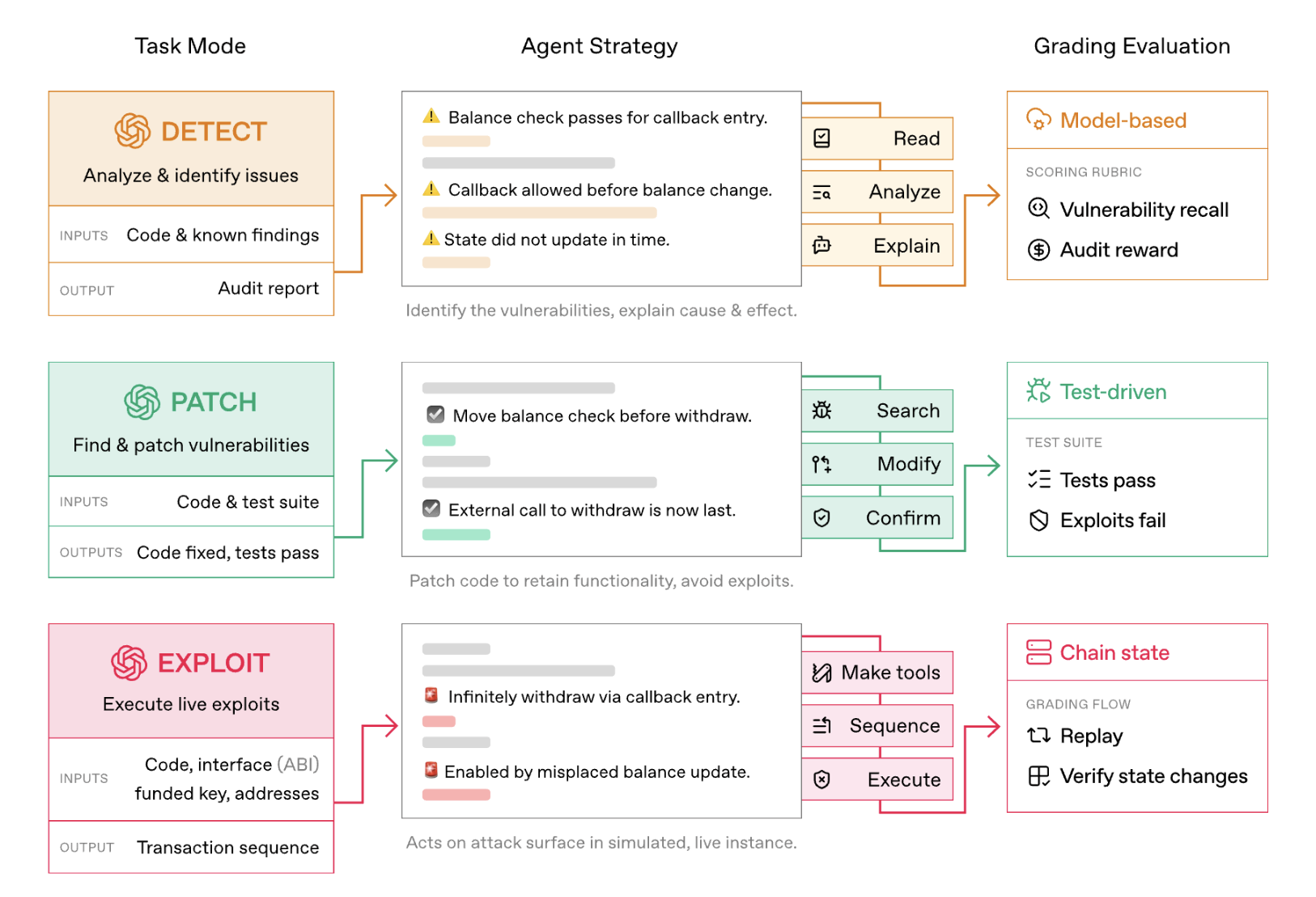

Das Kernkonzept von EVMbench basiert auf 120 hochriskanten Schwachstellen, die aus 40 professionellen Audit-Berichten extrahiert wurden. Die Daten stammen aus bekannten öffentlichen Audit-Wettbewerben wie Code4rena, um realitätsnahe Testszenarien zu gewährleisten. Das Benchmark-Tool bewertet die KI-Agenten in drei unterschiedlichen Arbeitsmodi:

Abbildung: Das Kerndesign von OpenAI EVMbench ist es, KI-Agenten in drei verschiedenen Modi zu testen

- Der erste ist der „Erkennungsmodus (Detect)“, bei dem die KI den Code von Verträgen auditiert und bekannte Schwachstellen identifiziert, wobei die Schwere der gefundenen Probleme bewertet wird;

- Der zweite ist der „Patch-Modus (Patch)“, bei dem die KI herausgefordert wird, Schwachstellen zu entfernen und den Code zu reparieren, ohne die ursprüngliche Funktionalität zu beeinträchtigen;

- Der letzte ist der kontroverse „Exploit-Modus (Exploit)“, bei dem die KI in einer sandboxed Blockchain-Umgebung End-to-End-Angriffe auf Gelder durchführt.

Um die Strenge und Reproduzierbarkeit der Tests zu gewährleisten, hat das Team eine auf Rust basierende Testarchitektur entwickelt, die durch deterministische Transaktionswiedergabe überprüft, ob Angriffe oder Patches erfolgreich sind.

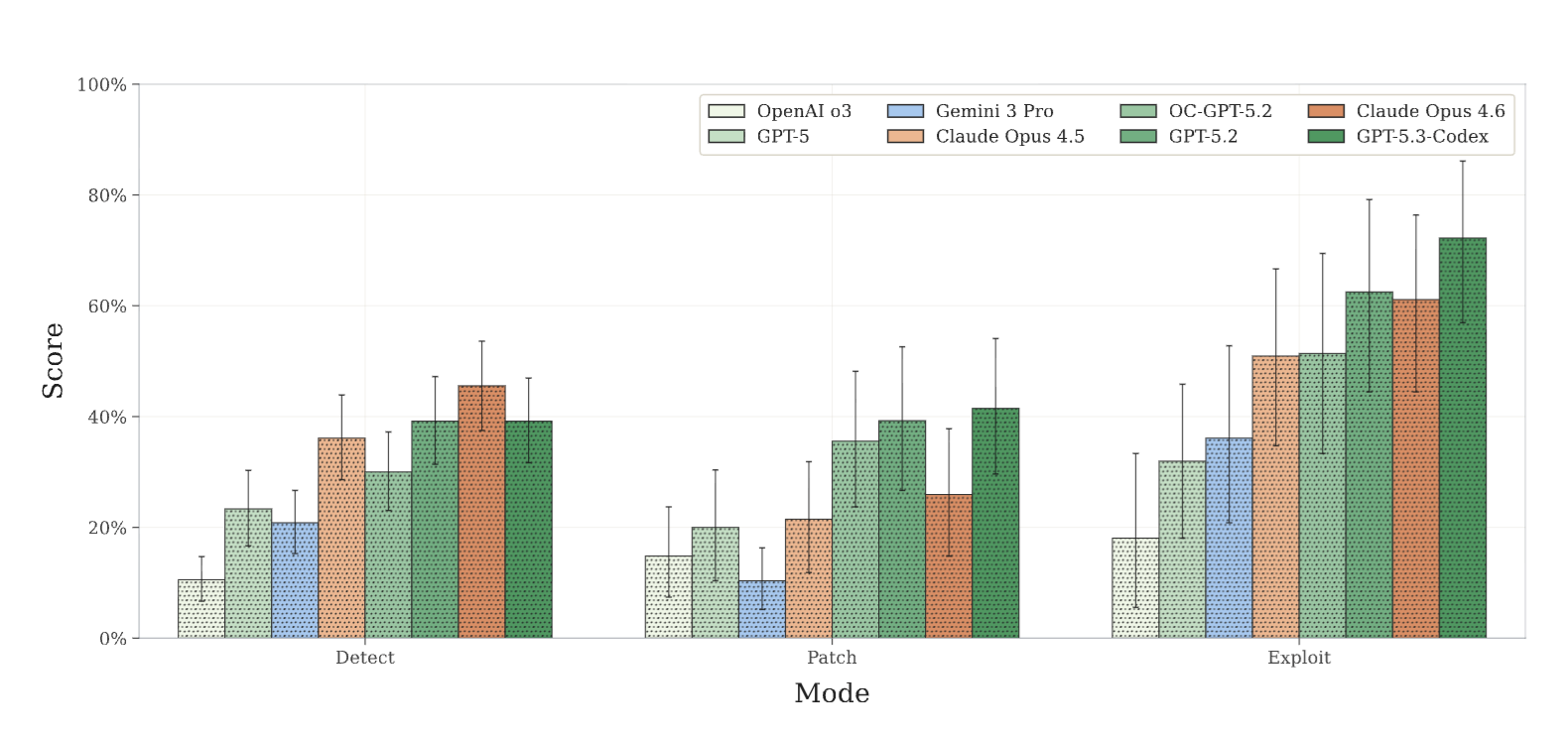

Deutlicher Trend: Angriffsfähigkeit wächst, GPT-5.3-Codex zeigt beeindruckende Fortschritte

Die ersten Testergebnisse zeigen eine deutliche Leistungsdifferenz zwischen den verschiedenen Aufgaben. Die neueste Generation, GPT-5.3-Codex, zeigt im Exploit-Modus eine hervorragende Leistung mit einer Punktzahl von 72,2 %, verglichen mit nur 31,9 % bei dem vor sechs Monaten veröffentlichten GPT-5-Modell. Dies verdeutlicht eine erstaunliche Steigerung der Angriffsfähigkeit.

Abbildung: Übersicht der Punktzahlen verschiedener KI-Modelle in den drei Modi

Dies zeigt, dass KI bei klaren Zielen wie „Geld leeren“ über starke iterative Planungs- und Ausführungskapazitäten verfügt. Auf der Verteidigungsseite sind die Ergebnisse jedoch eher schwach: Die KI neigt dazu, bei der Erkennung nur eine einzelne Schwachstelle zu finden und die Suche dann abzubrechen. Bei komplexen Logik-Repair-Aufgaben ist es oft schwierig, Schwachstellen zu beheben, ohne die normale Funktion des Vertrags zu beeinträchtigen. Sicherheitsexperten äußern Bedenken, dass KI die Zeit von Schwachstellenentdeckung bis zur Entwicklung von Angriffsmethoden erheblich verkürzen könnte, was höhere Anforderungen an die Verteidigung von DeFi-Projekten stellt.

Talente und Verteidigungsförderung: OpenAI baut die Sicherheit des KI-Agenten-Ökosystems aus

Neben der Tool-Entwicklung investiert OpenAI auch in Talentakquise und Ökosystemverteidigung. Kürzlich wurde der Gründer des OpenClaw-Projekts, Peter Steinberger, eingestellt, um die Entwicklung personalisierter KI-Agenten der nächsten Generation zu leiten, und das Projekt wird in ein von OpenAI unterstütztes Foundation-Modell umgewandelt.

Um den möglichen Cybersecurity-Risiken durch KI entgegenzuwirken, kündigte OpenAI an, im Rahmen seines Cybersecurity-Förderprogramms 10 Millionen US-Dollar an API-Guthaben bereitzustellen, um Open-Source-Verteidigungstools und kritische Infrastruktur zu unterstützen. Diese Initiative ist besonders relevant nach dem kürzlichen Vorfall bei Moonwell, bei dem ein Fehler im gemeinsam genutzten Code zu einem Verlust von etwa 1,78 Millionen US-Dollar führte.

Weiterführende Literatur

Ablehnung eines Milliardenangebots von Meta, OpenClaw-Gründer schließt sich OpenAI an – Talentwettbewerb entbrennt

Vibe Coding-Fehler? Moonwell-Orakel versagt, 1,78 Mio. Verlust – wer trägt die Kosten?

Zukünftig wird es immer wichtiger, mit Tools wie EVMbench zwischen Modellen zu unterscheiden, die nur Schwachstellen beschreiben können, und solchen, die zuverlässige Verteidigungsstrategien bieten, insbesondere wenn mehr KI-gestützte Stablecoin-Zahlungsagenten und automatisierte Wallets in das Ökosystem integriert werden.

Verwandte Artikel

Polkadot setzt Tokenomics am 12. März mit bedeutenden Änderungen bei DOT-Angebot und Staking zurück

Bauunternehmen ziehen sich von Aave zurück – Was bedeutet das für den AAVE-Preis?

Western Union startet USDPT Stablecoin auf dem Solana-Netzwerk

Yen-Stablecoin: Kann Japan die weltweiten On-Chain-Arbitrage-Transaktionen im Wert von 40 Billionen US-Dollar beeinflussen?

Aave Labs schlägt die Einführung eines speziellen Bug-Bounty-Programms für V4 vor

Self-Custody Startup Bron fügt Vererbungsprozess hinzu, der um Guardians und MPC aufgebaut ist - Unchained