圍繞《2028全球智力危機》(The 2028 Global Intelligence Crisis)這份報告,市場討論的核心焦點常聚焦於一個問題:AI 是否會在 2028 年引發全球經濟的系統性崩潰?

這類問題本身充滿戲劇性,但若僅止於「是否崩潰」的二元判斷,反而可能忽略更重要的結構性變數。真正值得深入分析的,並非某一年份的宏觀結果,而是當 AI 成為主導生產力工具時,人類在經濟體系中的角色將如何轉變?

一、AI 衝擊的本質:生產函數的再分配

從經濟學角度來看,技術革命的關鍵影響在於改變生產函數中各要素的權重分配。

- 工業時代,資本強化體力勞動;

- 資訊時代,技術提升資訊處理效率;

- 而在 AI 時代,資本(算力、數據、模型)開始強化甚至取代認知勞動。

這一變化的核心,不在於效率的提升本身,而在於「誰在價值創造中占比更高」。

若認知型任務——分析、建模、內容生成、程式碼撰寫、流程決策——愈來愈多由 AI 完成,則勞動收入在總產出中的占比可能下降,而資本報酬則上升。這將直接影響收入結構、社會流動路徑與消費能力。因此,AI 帶來的衝擊,更接近於分配結構的調整,而非單純的技術升級。

二、為何「系統性崩潰」的機率有限?

系統性金融危機通常需信用鏈條斷裂、資產負債表嚴重錯配與槓桿疊加。歷史上的重大危機多源自金融體系內部結構失衡,而非生產力工具本身。

AI 屬於提升生產效率的技術衝擊。它或許會改變利潤結構與就業結構,但並不會本質上破壞銀行資產品質或信用體系運作。

此外,技術擴散過程中存在現實摩擦:

- 企業 IT 架構重建需時

- 資料治理與合規體系設有門檻

- 組織流程與職位分工調整有其慣性

即使模型能力快速提升,全面取代仍需透過組織改造來實現。這種「制度與組織摩擦」本身形成緩衝。

因此,短期內更可能看到的是產業分化與利潤重估,而非全球信用體系瞬間崩潰。

三、真正的風險:結構性錯配

比「崩潰」更實際的風險,是結構性錯配。

第一種錯配來自技能結構。現有大量勞動力是在「人類認知稀缺」的環境下培養。若標準化分析與生成任務被自動化,這部分技能將面臨重新定價。

第二種錯配來自收入結構。若 AI 的生產力紅利主要集中於算力持有者與技術平台,而勞動議價能力下滑,消費端壓力將加劇。

第三種錯配來自預期管理。資本市場往往提前反映未來十年的成長預期。當利潤實現速度低於預期,估值回調將放大波動。

這些風險疊加,可能引發階段性震盪。但震盪與崩潰本質不同。

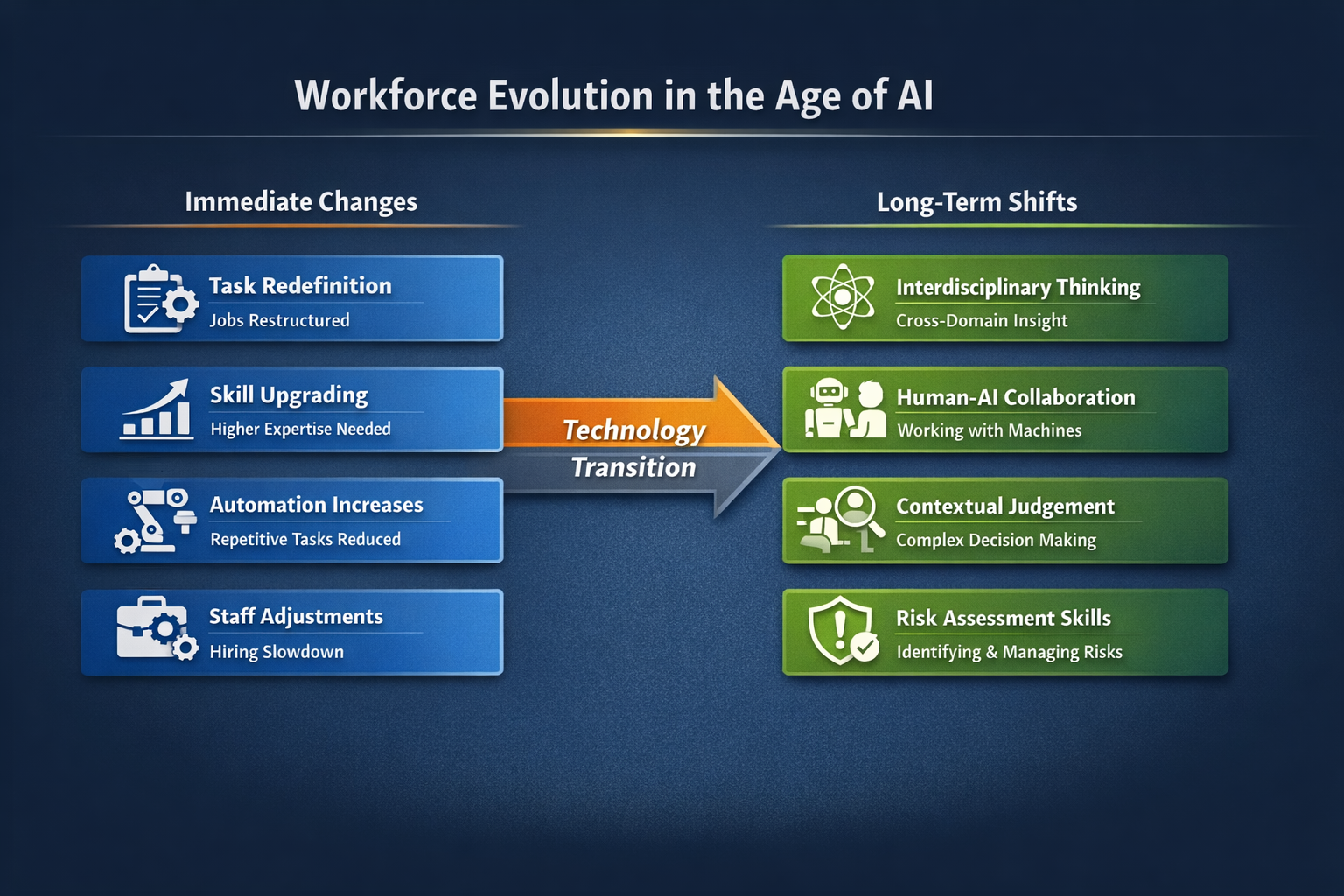

四、就業結構將如何轉變?

技術取代通常遵循「任務取代」而非「職業消失」的軌跡。

一個職位往往包含多種任務,部分可自動化,部分仍需人類判斷與協調。因此,更可能出現的情形為:

- 職位內容調整

- 技能要求升級

- 重複性任務減少

- 綜合決策任務增加

短期內,企業可能透過減少招募、職位合併、自然流失等方式調整人力結構,而非一次性大規模取代。但長期趨勢明確:標準化認知工作的價值下降,複雜判斷與系統整合能力的價值提升。

這意味著教育與培訓體系需轉向:

- 跨領域理解能力

- 人機協作能力

- 情境判斷能力

- 風險辨識能力

而非僅僅是資訊記憶與公式運算。

五、AI 是否會改變社會權力結構?

若算力與數據成為核心生產資料,則擁有基礎設施與演算法資源者將取得更高的議價能力。

這可能帶來兩種結果:

- 規模效應進一步強化

- 監管與制度創新加速

歷史經驗顯示,當技術集中度提高,制度往往隨之調整。反壟斷、稅制改革、產業規範等,都可能成為未來的重點議題。

換言之,技術擴張與制度重塑常常同步演化。

六、AI 時代的人類價值重心

當機器在速度與精確度上遠超人類,人類的價值不會消失,而是轉向更高層次的領域。

可能包括:

- 價值取向判斷

- 制度設計與監督

- 風險承擔

- 創造性整合

- 社會信任建構

AI 能夠提供運算結果,但「採取哪種路徑」仍屬於制度與權力層面的選擇。這代表人類的角色將從執行型勞動者,逐步轉向決策與授權型參與者。

七、更可能出現的現實路徑

綜合技術擴散規律與宏觀機制,更可能出現的情境包括:

- AI 在多個產業深度滲透,但進展節奏不均

- 科技企業利潤率階段性提升

- 中階技能職位被壓縮,高階職位需求增加

- 收入差距擴大成為政策討論焦點

- 市場估值波動加劇

- 資本集中於算力、能源與基礎設施

這種變化更像是一場結構重組,而非經濟體系的崩潰。若真有危機,更可能源自資產泡沫與槓桿過高,而非 AI 本身。

八、過渡期的核心挑戰

AI 時代真正的考驗,在於如何管理過渡期。

此階段可能會:

- 部分技能迅速貶值

- 再培訓速度有限

- 收入差距擴大

- 市場預期反覆修正

政策與制度必須在效率與穩定之間尋求平衡。

但無論採取何種方式,長期可持續的路徑仍仰賴真實生產力提升與需求匹配,而非永久性扭曲的激勵機制。

結論:問題不在「毀滅」,而在「重構」

《2028全球智力危機》提供了一個高衝擊情境,有助於思考極端風險。但從宏觀及歷史視角觀察,AI 更可能帶來的是長期結構重塑,而非短期系統毀滅。

真正的問題不是:AI 是否會摧毀經濟?

而是:當認知能力不再稀缺,人類該如何重新定義價值、分配與權力結構?

技術本身是中性的。決定未來形貌的,是制度選擇、教育方向與資本配置方式。AI 時代不是終點,而是一場秩序再設計的開端。

相關文章

Arweave:用AO電腦捕捉市場機會

即將到來的AO代幣:可能是鏈上AI代理的終極解決方案

深度分析:AI和Web3能創造什麼樣的火花?

思維網路:全面同態加密和重質押,讓AI專案安全觸手可及

USD.AI 代幣經濟學:深入解析 CHIP 代幣的應用場景與激勵機制