Các vấn đề bảo mật liên quan đến trợ lý AI Clawdbot bắt đầu được quan tâm

Vì sao Clawdbot lại nhanh chóng tạo sức hút?

Clawdbot là trợ lý AI mã nguồn mở được thiết kế để vận hành liên tục trong môi trường máy chủ. Khác với các chatbot thông thường, Clawdbot hoạt động như một trợ lý công việc kỹ thuật số thực sự, có khả năng trực tiếp thực thi các tác vụ. Người dùng chỉ cần gửi lệnh qua các nền tảng nhắn tin tức thời, hệ thống sẽ tự động xử lý mọi hoạt động phức tạp trong ngày. Chính phương thức AI có thể hành động này đã giúp Clawdbot trở thành dấu mốc quan trọng của lĩnh vực trợ lý cá nhân, thúc đẩy tốc độ lan tỏa mạnh mẽ.

Nền tảng hỗ trợ và các trường hợp sử dụng

Clawdbot tích hợp trực tiếp với WhatsApp và Telegram, giúp người dùng quản lý công việc qua trò chuyện, bao gồm nhưng không giới hạn ở:

- Tự động sắp xếp, dọn dẹp email

- Lên lịch và quản lý các cuộc họp

- Thu thập thông tin doanh nghiệp và dữ liệu kinh doanh

- Theo dõi hoạt động của khách hàng tiềm năng

- Soạn thảo nội dung, cập nhật lịch làm việc

Khả năng làm quen nhanh và sử dụng tức thì là yếu tố chủ đạo giúp Clawdbot tăng trưởng người dùng vượt trội.

Sáng tạo được thúc đẩy bởi khả năng tự tối ưu hóa

Bên cạnh bộ tính năng mạnh mẽ, Clawdbot còn nổi bật nhờ thiết kế tự tối ưu hóa. Chính khả năng này đã khiến nhiều nhà phát triển và người dùng xem Clawdbot là nguyên mẫu cho thế hệ trợ lý AI cá nhân tương lai, đồng thời nâng cao kỳ vọng của thị trường đối với các công cụ này. Tuy nhiên, khi các chức năng của Clawdbot ngày càng ăn sâu vào quy trình công việc chủ chốt, rủi ro bảo mật liên quan cũng ngày càng nghiêm trọng.

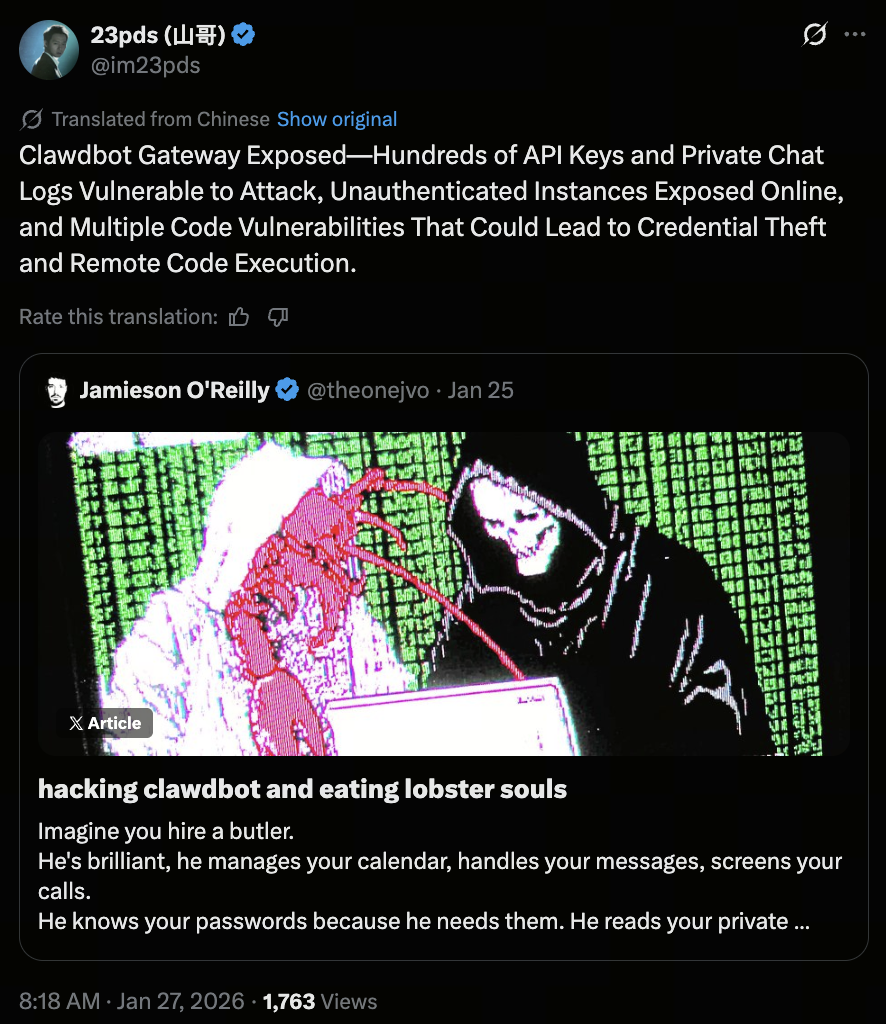

Rủi ro bảo mật nghiêm trọng do SlowMist công bố

(Nguồn: im23pds)

im23pds, Giám đốc An ninh Thông tin tại SlowMist, vừa công bố rằng Clawdbot tồn tại nhiều lỗ hổng bảo mật trong triển khai thực tế. Các vấn đề này không chỉ xuất phát từ cấu hình mà còn liên quan trực tiếp đến mã nguồn.

Các rủi ro chính bao gồm:

- Nhiều gateway Clawdbot không có xác thực, cho phép truy cập trực tiếp từ internet công cộng

- Hàng trăm khóa API và nhật ký trò chuyện riêng tư có nguy cơ bị truy cập từ bên ngoài

- Nhiều lỗi mã nguồn có thể bị khai thác để đánh cắp thông tin xác thực

- Nguy cơ thực thi mã từ xa trong một số điều kiện nhất định

Nếu bị khai thác, các lỗ hổng này có thể ảnh hưởng đến nhiều đối tượng hơn chỉ riêng người dùng cá nhân.

Trợ lý AI trở thành thực tiễn—bảo mật là rào cản sống còn

Trường hợp Clawdbot cho thấy, khi công cụ AI chuyển từ hỗ trợ trò chuyện sang thực hiện các tác vụ thực tế, thiết kế bảo mật trở thành yếu tố cốt lõi. Khi trợ lý có quyền truy cập vào lịch sử liên lạc, lịch làm việc và quyền tài khoản, chỉ một sơ suất cấu hình cũng có thể trở thành điểm tấn công. Đối với các dự án mã nguồn mở, đổi mới chức năng là cần thiết, nhưng cân bằng giữa khả năng sử dụng và bảo vệ bảo mật vững chắc sẽ quyết định sự chấp nhận lâu dài trên thị trường.

Tóm tắt

Clawdbot cho thấy viễn cảnh tương lai của trợ lý AI cá nhân, đồng thời nhấn mạnh rằng khi AI bắt đầu thực hiện các tác vụ thay cho người dùng, bảo mật là yêu cầu nền tảng—không phải lựa chọn xa xỉ. Cảnh báo bảo mật này có thể sẽ là phép thử quan trọng cho quá trình chuyển đổi của các công cụ AI từ giai đoạn phát triển nhanh sang giai đoạn trưởng thành.

Bài viết liên quan

Falcon Finance và Ethena: Phân tích chuyên sâu về thị trường stablecoin tổng hợp

Falcon Finance Tokenomics: Phân tích cơ chế nắm bắt giá trị của FF

Jito và Marinade: Phân tích so sánh các giao thức Staking thanh khoản trên Solana

JTO Tokenomics: Phân phối, Tiện ích và Giá trị Dài hạn

Phân tích chuyên sâu về tokenomics của Morpho: tiện ích, phân phối và khung giá trị của MORPHO