72 години кризи ідентичності Anthropic

Вівторок, 24 лютого. Вашингтон, Пентагон.

Генеральний директор Anthropic Даріо Амодей сидів навпроти міністра оборони Піта Хегсета. NPR і CNN повідомили, що зустріч була «ввічливою», хоча її зміст був далеко не м’яким.

Хегсет висунув ультиматум: до 17:01 у п’ятницю Anthropic має зняти всі обмеження на військове використання Claude і дозволити Пентагону застосовувати його для «всіх законних цілей», включаючи автономне наведення озброєння та масштабне внутрішнє спостереження.

У разі відмови контракт на 200 мільйонів доларів буде анульовано. Пентагон застосує Закон про оборонне виробництво для примусового вилучення. Anthropic буде оголошено «ризиком для ланцюга постачання» — фактично віднесено до чорного списку разом із противниками, такими як Росія і Китай.

Того ж дня Anthropic опублікувала третю редакцію своєї Політики відповідального масштабування (RSP 3.0), тихо прибравши свою найважливішу обіцянку з моменту заснування: не тренувати потужніші моделі без впровадження заходів безпеки.

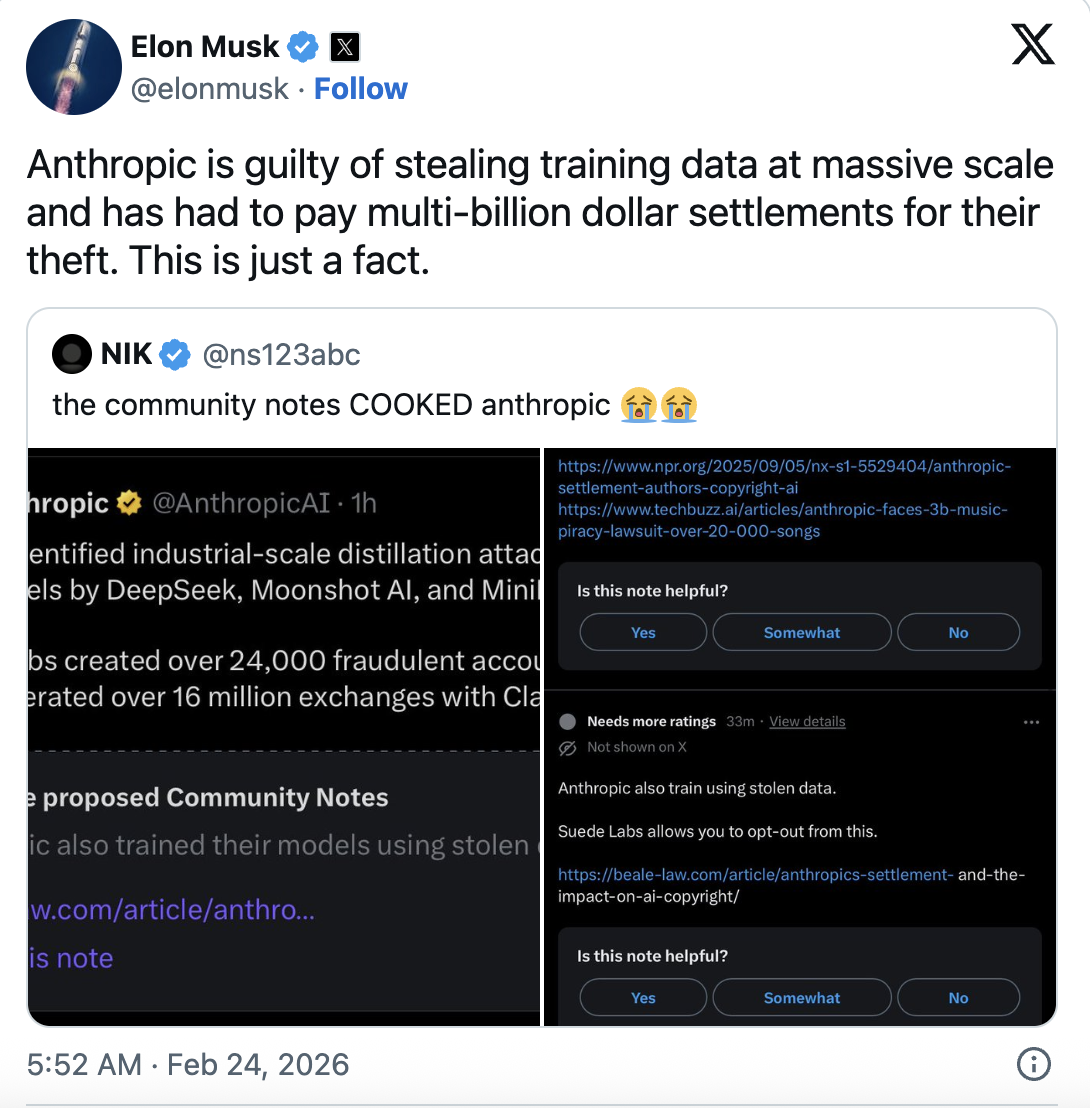

Також того дня Ілон Маск написав у X: «Anthropic здійснила масштабне викрадення даних для навчання — це факт». У той же час Community Notes X посилалися на повідомлення про те, що Anthropic заплатила 1,5 мільярда доларів для врегулювання претензій щодо тренування Claude на піратських книгах.

За 72 години ця компанія ШІ — яка колись заявляла про «душу» — стала мученицею безпеки, крадієм інтелектуальної власності та зрадником Пентагону.

Яка з них справжня Anthropic?

Можливо, всі.

Мандат Пентагону «Виконуй або виходь»

Перший рівень цієї історії простий.

Anthropic стала першою компанією ШІ, яка отримала секретний доступ від Міністерства оборони США, з контрактом, укладеним минулого літа і обмеженим сумою 200 мільйонів доларів. OpenAI, Google і xAI згодом отримали контракти аналогічного масштабу.

За даними Al Jazeera, Claude використовувалася у військовій операції США в січні цього року. У звіті йшлося, що місія стосувалася викрадення президента Венесуели Мадуро.

Однак Anthropic провела дві червоні лінії: не підтримувати повністю автономне наведення озброєння і не підтримувати масштабне спостереження за громадянами США. Anthropic стверджує, що ШІ недостатньо надійний для контролю озброєння, і немає законів, які регулюють ШІ у масовому спостереженні.

Пентагон це не переконало.

У жовтні минулого року радник з питань ШІ у Білому домі Девід Сакс публічно звинуватив Anthropic у X у «зброї страху для захоплення регуляторів».

Конкуренти вже здалися. OpenAI, Google і xAI погодилися дозволити військовим використовувати їхній ШІ для «всіх законних сценаріїв». Grok Маска щойно був схвалений для секретних систем цього тижня.

Anthropic — останній, хто чинить опір.

На момент написання Anthropic заявила у своєму останньому повідомленні, що не має наміру поступатися. Але дедлайн у п’ятницю о 17:01 наближається.

Анонімний колишній зв’язковий між Міністерством юстиції та Пентагоном сказав CNN: «Як можна оголосити компанію "ризиком для ланцюга постачання" і одночасно змушувати її працювати на вашу армію?»

Це гарне питання — але не те, яке цікавить Пентагон. Їх турбує, що якщо Anthropic не піде на компроміс, вони забезпечать виконання або залишать Anthropic на морозі у Вашингтоні.

«Дистиляційна атака»: публічне звинувачення обертається проти

23 лютого Anthropic опублікувала різко сформульований блог, звинувативши три китайські компанії ШІ — DeepSeek, Moonshot AI і MiniMax — у проведенні «дистиляційних атак промислового масштабу» на Claude.

Anthropic стверджувала, що ці компанії використали 24 000 фейкових акаунтів для понад 16 мільйонів взаємодій із Claude, систематично витягаючи його основні можливості в агентному мисленні, використанні інструментів і програмуванні.

Anthropic подала це як загрозу національній безпеці, заявивши, що дистильовані моделі «ймовірно не зберігають захисних бар’єрів» і можуть бути використані авторитарними урядами для кібератак, дезінформації та масового спостереження.

Наратив був вчасним і вдало сформульованим.

Він з’явився відразу після того, як адміністрація Трампа послабила контроль за експортом чипів до Китаю — саме тоді Anthropic потрібна була нова аргументація для лобіювання експорту чипів.

Але Маск відповів: «Anthropic здійснила масштабне викрадення даних для навчання і заплатила мільярди за врегулювання. Це факт».

Співзасновник IO.Net Торі Грін прокоментував: «Ви тренуєте свої моделі на всьому інтернеті, а коли інші вчаться через ваш публічний API, називаєте це "дистиляційною атакою"?»

Anthropic називає дистиляцію «атакою», але це стандартна практика у сфері ШІ. OpenAI використовувала її для компресії GPT-4, Google — для оптимізації Gemini, і сама Anthropic також це робила. Єдина різниця цього разу: Anthropic — ціль.

Як сказав професор ШІ з Наньянського технологічного університету Ерік Камбрія для CNBC, «Межа між легітимним використанням і зловмисною експлуатацією часто розмита».

Ще більш іронічно: Anthropic щойно заплатила 1,5 мільярда доларів за врегулювання претензій щодо тренування Claude на піратських книгах. Вони тренувалися на всьому інтернеті, а потім звинуватили інших у навчанні через їхній публічний API. Це не просто подвійні стандарти — це потрійні.

Anthropic хотіла виступити жертвою, але стала обвинуваченою.

Розпуск зобов’язань із безпеки: RSP 3.0

У той же день, коли Anthropic протистояла Пентагону та сперечалася із Силіконовою долиною, вона випустила третю версію своєї Політики відповідального масштабування.

Головний науковець Джаред Каплан заявив для медіа: «Ми не вважаємо, що зупинка тренування моделей ШІ допомагає комусь. З таким швидким розвитком ШІ односторонні зобов’язання, коли конкуренти просуваються на повну швидкість, не мають сенсу».

Інакше кажучи, якщо інші не дотримуються правил, ми також.

Суть RSP 1.0 і 2.0 була жорстким зобов’язанням: якщо можливості моделі перевищують охоплення заходів безпеки, тренування зупиняється. Це дало Anthropic унікальну репутацію у спільноті безпеки ШІ.

Але версія 3.0 відмовилася від цієї обіцянки.

Її замінили більш «гнучкою» структурою — розділенням заходів безпеки, які Anthropic може впровадити, і галузевих рекомендацій. Що 3–6 місяців буде публікуватися звіт про ризики з зовнішньою експертною оцінкою.

Чи виглядає це відповідально?

Кріс Пейнтер, незалежний рецензент із некомерційної організації METR, після ознайомлення з раннім проектом сказав: «Це показує, що Anthropic вважає, що потрібно перейти в "режим сортування", бо оцінка ризиків і їх мінімізація не встигають за зростанням можливостей. Це ще одне свідчення, що суспільство не готове до катастрофічних ризиків ШІ».

TIME повідомляє, що Anthropic майже рік внутрішньо обговорювала це переписування, і генеральний директор Амодей з радою директорів одноголосно схвалили зміни. Офіційно початкова політика мала стимулювати галузевий консенсус — але галузь не підтримала. Адміністрація Трампа зайняла позицію невтручання у сферу ШІ, навіть намагалася скасувати закони штатів. Федеральне законодавство щодо ШІ залишається недосяжним. У 2023 році глобальна рамка управління здавалась можливою, але через три роки це питання закрите.

Анонімний дослідник управління ШІ із великим досвідом висловився прямо: «RSP — найцінніший бренд-актив Anthropic. Відмова від призупинення тренування — як органічна компанія тихо прибирає "органічне" зі своєї етикетки, а потім каже, що їхнє тестування стало прозорішим».

Криза ідентичності при оцінці $380 мільярдів

На початку лютого Anthropic завершила раунд фінансування на $30 мільярдів при оцінці $380 мільярдів, з Amazon як основним інвестором. З моменту заснування компанія досягла $14 мільярдів річного доходу, а за останні три роки цей показник щороку зростав більш ніж у десять разів.

Водночас Пентагон погрожує занести компанію до чорного списку. Маск публічно звинувачує у крадіжці даних. Головне зобов’язання щодо безпеки зникло. Керівник з безпеки ШІ Anthropic Мрінанк Шарма подав у відставку і написав у X: «Світ у небезпеці».

Протиріччя?

Можливо, протиріччя — ДНК Anthropic.

Заснована колишніми керівниками OpenAI, які були стурбовані темпами безпеки OpenAI, Anthropic побудувала ще потужніші моделі, швидше, одночасно розповідаючи світу, наскільки небезпечні ці моделі.

Суть бізнес-моделі: ми боїмося ШІ більше за всіх, тому вам слід платити нам за його створення.

Цей наратив ідеально спрацював у 2023–2024 роках. Безпека ШІ була модним словом у Вашингтоні, і Anthropic була найгарячішим лобістом.

До 2026 року вітер змінився.

«Woke AI» стало політичним образливим словом, регулювання ШІ на рівні штатів було заблоковано Білим домом, і хоча SB 53 Каліфорнії (підтриманий Anthropic) став законом, на федеральному рівні нічого не змінилося.

Наратив безпеки Anthropic переходить із «відмінності» в «політичну проблему».

Anthropic виконує складний баланс — потрібно бути «достатньо безпечними», щоб зберегти бренд, але «достатньо гнучкими», щоб не бути відкинутими ринком або урядом. Проблема: терпимість обох сторін зменшується.

Скільки зараз коштує наратив безпеки?

У сукупності три події створюють чітку картину.

Звинувачення китайських компаній у дистиляції Claude посилює аргументи для обмеження експорту чипів. Відмова від призупинення тренування зберігає Anthropic у гонці озброєнь. Відмова виконати вимогу Пентагону щодо автономного озброєння — останній шар моральної репутації.

Кожен крок логічний, але кожен суперечить іншому.

Не можна заявляти, що китайські компанії «дистилюють» вашу модель і це загрожує національній безпеці, одночасно прибираючи власну обіцянку зупиняти модель, якщо вона виходить з-під контролю. Якщо модель така небезпечна, слід бути обережнішими, а не агресивнішими.

Якщо ви не Anthropic.

У сфері ШІ ідентичність визначається не заявами, а балансом. Наратив Anthropic про «безпеку» — це, по суті, брендова премія.

На початку гонки ШІ ця премія була цінною. Інвестори платили більше за «відповідальний ШІ», уряди схвалювали «надійний ШІ», клієнти купували «безпечний ШІ».

Але до 2026 року ця премія зникає.

Anthropic стикається не з питанням «чи слід йти на компроміс», а з дилемою «з ким йти на компроміс першочергово». Компроміс із Пентагоном — шкода бренду. Компроміс із конкурентами — знецінення обіцянки безпеки. Компроміс із інвесторами — поступки з обох сторін.

О 17:01 у п’ятницю Anthropic дасть свою відповідь.

Незалежно від результату, одне ясно: Anthropic, яка колись жила на «ми відрізняємось від OpenAI», стає такою, як усі.

Кінець кризи ідентичності часто означає зникнення самої ідентичності.

Заява:

- Ця стаття є передруком із [TechFlow]. Авторські права належать оригінальному автору [Ada]. Якщо у вас є питання щодо передруку, зверніться до команди Gate Learn, і ми оперативно вирішимо це згідно з відповідними процедурами.

- Відмова від відповідальності: думки та позиції, висловлені в цій статті, належать лише автору і не є інвестиційною порадою.

- Інші мовні версії цієї статті перекладені командою Gate Learn. Без згадки Gate перекладені статті не можуть копіюватися, розповсюджуватися чи бути використані для плагіату.

Пов’язані статті

Токеноміка ADA: структура пропозиції, стимули та варіанти використання

Plasma (XPL) vs традиційних платіжних систем: переосмислення моделей розрахунків і ліквідності стейблкоїнів для транскордонних операцій

Що таке Bitcoin?

Що таке Coti? Все, що вам потрібно знати про COTI

Все, що вам потрібно знати про Blockchain