A IA provocará um colapso económico global em 2028? Análise detalhada do relatório “Crise Global de Inteligência 2028” e das realidades das previsões apocalípticas sobre IA

Afinal, sobre o que trata o relatório "2028 Global Intelligence Crisis"?

O mercado tem-se debruçado recentemente sobre o relatório coassinado pelo fundador da Citrini Research, James van Geelen, e por Alap Shah—"The 2028 Global Intelligence Crisis". Elaborado a partir de uma perspetiva futura, em junho de 2028, o relatório faz uma retrospetiva dos anos anteriores e descreve um cenário em que a IA substitui rapidamente um número significativo de empregos de colarinho branco. Isto conduz ao colapso da procura dos consumidores, à redução dos lucros empresariais, à queda dos preços dos ativos e, por fim, a uma crise económica sistémica global.

Os autores salientam que se trata de uma “análise de cenários”, não de uma previsão. Contudo, a narrativa dramática do relatório, aliada aos avanços acelerados da IA, alimentou a difusão desta tese do “apocalipse da IA”—gerando inquietação entre investidores quanto às tecnológicas e às perspetivas de emprego.

Alguns economistas encaram-no como um “teste de esforço” conceptual, argumentando que pressupõe uma velocidade de substituição e um atraso nas políticas demasiado extremos, e que sobrestima a probabilidade de colapso sistémico. Há investidores que veem nele um alerta para o poder disruptivo da produtividade da IA. O relatório gerou, de facto, volatilidade nas tecnológicas, mas muitos operadores atribuem-na ao sentimento e não aos fundamentos. Em suma, embora o cenário do “apocalipse da IA” seja rejeitado pela maioria, reconhece-se que, se a IA superar a capacidade de adaptação da sociedade, poderão ocorrer choques estruturais.

Surge assim a questão central: poderá este cenário concretizar-se em 2028?

Porque é que a narrativa do “apocalipse da IA” provoca pânico nos mercados?

A tese do “apocalipse da IA” tem impacto porque explora três ansiedades muito atuais:

- A IA está a substituir trabalho intelectual de elevado rendimento

- As empresas estão a adotar ferramentas de automação em larga escala

- Os ganhos de produtividade podem comprimir a procura de trabalho

Ao contrário das anteriores vagas de automação industrial, esta fase da IA afeta sobretudo funções cognitivas—como análise, redação, programação, atendimento ao cliente e investigação financeira. Representa uma ameaça direta à segurança laboral da classe média, não apenas aos empregos operários.

Quando as expectativas de emprego e rendimento são abaladas, os mercados de capitais antecipam-se naturalmente.

No entanto, existe frequentemente um desfasamento—e uma diferença de magnitude—entre o sentimento e a realidade.

Maturidade da IA: poderá 2028 trazer realmente uma disrupção económica global?

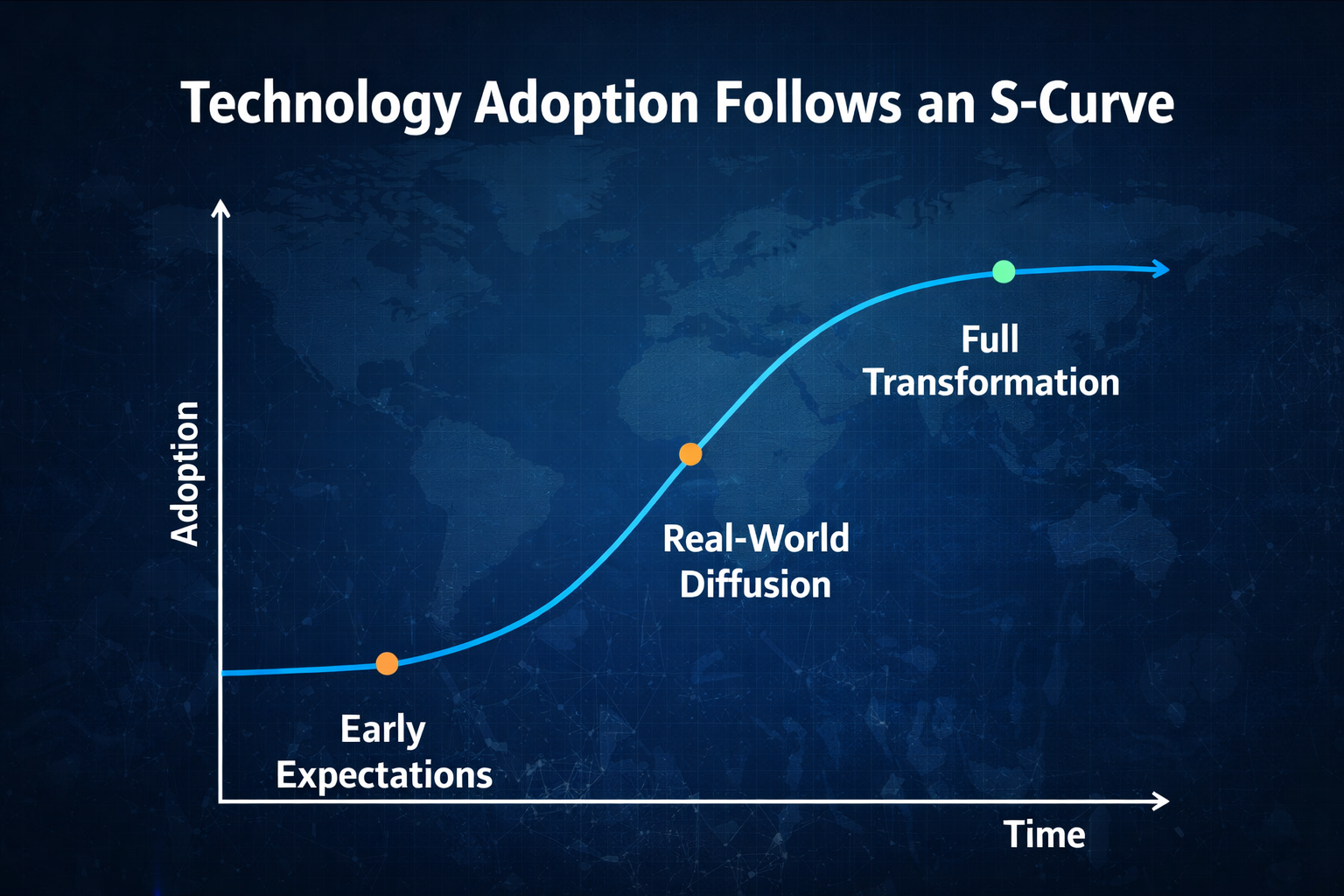

A avaliação do risco de colapso sistémico começa pelo ritmo de difusão tecnológica.

Historicamente, a adoção tecnológica segue uma curva em S:

- Expectativas elevadas na fase inicial

- Implementação e ajustamento na fase intermédia

- Generalização na fase final

Mesmo com avanços contínuos da IA, as empresas terão ainda de:

- Reestruturar sistemas de TI

- Governar dados

- Realizar revisões de conformidade

- Redesenhar processos organizacionais

Tudo isto requer tempo. 2028 está próximo. Numa perspetiva macro, a probabilidade de as grandes empresas globais conseguirem substituir integralmente a sua força de trabalho até lá é baixa. O mais plausível é uma “eficiência localizada e substituição gradual”.

A tecnologia pode avançar rapidamente, mas a mudança estrutural económica é sempre lenta.

Formar-se-á uma vaga de desemprego de colarinho branco?

A cadeia central do relatório é:

Substituição por IA → desemprego em massa de colarinho branco → colapso do consumo → crise de crédito → turbulência no sistema financeiro

Na prática, os ajustamentos empresariais são geralmente graduais:

- Congelamento de contratações

- Saídas naturais

- Fusão de departamentos

- Despedimentos seletivos

Raramente há substituição total e imediata de todos os postos de trabalho.

Além disso, as novas tecnologias tendem a criar novas funções:

- Gestão e otimização de IA

- Governação de dados

- Segurança de algoritmos

- Design de colaboração homem-máquina

O verdadeiro risco é a “compressão das competências intermédias”, não o desemprego em massa.

Assim, até 2028, é mais provável assistirmos à polarização da estrutura do emprego—não a um colapso total.

Poderá a IA desencadear uma crise financeira sistémica?

As crises financeiras sistémicas requerem geralmente dois fatores:

- Elevada alavancagem

- Reação em cadeia de falhas nos balanços

A crise de 2008 resultou de um colapso interno do sistema de crédito; a pandemia de 2020 foi um choque externo. O choque da IA será mais um “evento de reconfiguração da estrutura de lucros” do que uma deterioração direta dos ativos bancários.

Além disso, o sistema macroeconómico atual inclui:

- Estabilizadores automáticos (subsídio de desemprego)

- Ferramentas rápidas de corte de taxas por parte dos bancos centrais

- Capacidade de estímulo orçamental

Assim, mesmo que as pressões sobre o emprego aumentem, os decisores políticos podem intervir rapidamente. A probabilidade de a IA provocar um colapso imediato do sistema de crédito global é baixa.

Qual o cenário mais provável para 2028?

Considerando os padrões de adoção tecnológica e transmissão macroeconómica, o cenário mais plausível para 2028 não é um “colapso económico sistémico global”, mas sim uma transformação estrutural gradual e profunda.

1.As margens de lucro do setor tecnológico poderão aumentar temporariamente. A adoção generalizada da IA reduzirá drasticamente os custos marginais—sobretudo no desenvolvimento de software, atendimento ao cliente, análise de dados e criação de conteúdos. As empresas líderes, com vantagens em dados, computação e modelos, reforçarão ainda mais os efeitos de escala e de rede, concentrando os lucros no topo. Este “dividendo de eficiência” poderá impulsionar temporariamente a rentabilidade global do setor tecnológico.

2.Algumas funções de colarinho branco vão diminuir, mas não desaparecer. É mais provável uma reestruturação funcional do que uma substituição total. As funções repetitivas, orientadas por processos e estandardizadas serão as primeiras afetadas, enquanto as funções de decisão complexa, interpessoais e criativas manterão valor. O mercado de trabalho irá evidenciar uma clara estratificação de competências—aqueles que dominarem a colaboração com IA verão os seus rendimentos aumentar, enquanto os restantes enfrentarão pressão.

3.A desigualdade de rendimentos poderá agravar-se significativamente. O dividendo de produtividade da IA beneficiará primeiro o capital, as plataformas tecnológicas e o talento altamente qualificado, enquanto os trabalhadores do conhecimento intermédio perdem poder negocial. Esta distribuição desigual pode desencadear alterações no consumo, psicologia social ou mesmo pressão para redistribuição política.

4.A volatilidade dos mercados irá aumentar acentuadamente. Quando as expectativas de produtividade são rapidamente reavaliadas, os mercados de capitais tendem a registar ciclos de valorização dramáticos. As ações ligadas ao conceito de IA podem disparar com expectativas elevadas, mas, se os lucros não acompanharem, a volatilidade aumentará.

5.O capital tenderá a concentrar-se ainda mais na infraestrutura de IA. Computação, chips, centros de dados, energia e plataformas cloud serão os principais beneficiários a longo prazo. Em comparação com a camada de aplicações, os recursos fundamentais são mais insubstituíveis e detêm maior poder de fixação de preços—canalizando o investimento para “computação e energia”.

O desfecho mais provável da IA é um “choque estrutural”, não uma “destruição sistémica”. O sistema económico não colapsará, mas a alocação de recursos mudará de forma fundamental.

Os riscos centrar-se-ão em:

- Bolhas de ativos

- Sobrevalorização

- Alavancagem

Se houver uma crise, será provavelmente o rebentar da bolha narrativa da IA—não a destruição da economia pela própria IA.

Como devem os investidores abordar o risco e a oportunidade da IA?

Do ponto de vista do investimento, há três categorias de risco a considerar.

Ao investir em IA, a questão não é acreditar ou não na IA—mas sim onde residem os riscos. Estes dividem-se em três tipos:

1. Risco tecnológico: As melhorias nos modelos podem abrandar, os custos de computação podem subir ou uma regulação mais apertada pode limitar a adoção. Se o progresso ficar aquém das expectativas do mercado, as valorizações elevadas ficam vulneráveis a correções.

2. Risco narrativo: Os mercados tendem a antecipar uma década de ganhos de produtividade. Se os lucros não surgirem tão rapidamente como esperado, as valorizações podem comprimir-se rapidamente. A maioria das revoluções tecnológicas passou por ciclos de “narrativa sobreaquecida—validação de lucros—reversão para a média”.

3. Risco estrutural: Se a IA comprimir funções intermédias no curto prazo e o rendimento migrar para o capital, a procura dos consumidores pode enfraquecer—afetando o crescimento em alguns setores.

A longo prazo, a IA deverá impulsionar a produtividade, mas a volatilidade de curto prazo é inevitável. Estratégias racionais incluem:

Diversificar para evitar risco de concentração num único setor

Focar na qualidade dos fluxos de caixa e escolher empresas com rentabilidade comprovada

Evitar alavancagem elevada para limitar perdas em períodos voláteis

Acompanhar alterações políticas, pois a regulação e as mudanças fiscais podem condicionar as tendências do setor

O verdadeiro risco não está na tecnologia—mas sim na forma como o mercado a valoriza.

Conclusão: a IA vai provocar um colapso económico global em 2028?

Ponderando o ritmo de adoção tecnológica, os ciclos de transformação empresarial, a capacidade de resposta macroeconómica e a estabilidade do sistema financeiro, a probabilidade de um colapso sistémico global é baixa. Contudo, o risco de choques estruturais no emprego e de maior volatilidade nos mercados é significativo. “The 2028 Global Intelligence Crisis” deve ser encarado como um teste de esforço macroeconómico—um alerta para o desfasamento entre a velocidade de substituição da IA e a capacidade de adaptação da sociedade.

A IA não é uma máquina do fim do mundo—é um amplificador. Amplifica a eficiência, mas também amplia os desequilíbrios. O que determinará realmente 2028 não é apenas a capacidade tecnológica, mas a resposta das políticas públicas, a adaptabilidade social e a racionalidade dos mercados de capitais.

A racionalidade é mais importante do que o pânico.

Artigos relacionados

Análise de tokenomics do JTO: distribuição, casos de utilização e valor de longo prazo

Jito vs Marinade: Análise comparativa dos protocolos de Staking de liquidez na Solana

Tokenomics da Morpho: Utilidade, distribuição e proposta de valor do MORPHO

Morpho vs. Aave: Análise aprofundada das diferenças de mecanismo e estrutura nos protocolos de empréstimos DeFi

Como utilizar o Raydium? Guia para principiantes sobre negociação e participação em liquidez