Para onde está a caminhar a humanidade na era da IA? Reflexões estruturais para lá de “A Crise Global da Inteligência de 2028”

O debate sobre o relatório “The 2028 Global Intelligence Crisis” gira frequentemente em torno de uma única questão: irá a IA provocar um colapso sistémico da economia global em 2028?

Esta é uma questão inerentemente dramática. Contudo, centrar a análise apenas no binómio “colapso ou não” pode levar a ignorar variáveis estruturais mais relevantes. O verdadeiro desafio não está no resultado macroeconómico de um ano específico, mas sim em como o papel da humanidade no sistema económico evoluirá à medida que a IA se afirma como principal ferramenta de produtividade.

I. A essência da disrupção da IA: redistribuição da função de produção

Do ponto de vista económico, as revoluções tecnológicas alteram profundamente o peso dos fatores na função de produção.

- Na era industrial, o capital amplificou o trabalho físico.

- Na era da informação, a tecnologia potenciou a eficiência do tratamento de informação.

- Na era da IA, o capital—potência computacional, dados e modelos—começa a amplificar e até a substituir o trabalho cognitivo.

A mudança fundamental não é apenas a eficiência melhorada, mas sim “quem detém uma fatia maior da criação de valor”.

Se tarefas cognitivas—análise, modelação, geração de conteúdos, programação, decisão de processos—forem desempenhadas cada vez mais pela IA, o rendimento do trabalho poderá perder peso relativamente ao produto total, enquanto os retornos do capital aumentam. Isto terá impacto direto na estrutura de rendimentos, mobilidade social e capacidade de consumo. Por isso, a disrupção da IA é, acima de tudo, um ajustamento redistributivo e não meramente uma atualização tecnológica.

II. Porque é limitada a probabilidade de “colapso sistémico”?

As crises financeiras sistémicas exigem, normalmente, uma cadeia de crédito quebrada, desequilíbrios severos entre ativos e passivos e alavancagem excessiva. Historicamente, as grandes crises resultaram de desequilíbrios estruturais internos do sistema financeiro—não das próprias ferramentas de produtividade.

A IA é um choque tecnológico que aumenta a produtividade. Pode alterar estruturas de lucros e padrões de emprego, mas não compromete, por si só, a qualidade dos ativos bancários nem o funcionamento do sistema de crédito.

Além disso, a difusão tecnológica enfrenta fricções reais:

- A reconstrução da arquitetura de TI nas empresas leva tempo

- Os sistemas de governança e conformidade de dados criam barreiras

- Os ajustamentos dos processos organizacionais e de divisão de funções são lentos

Mesmo que os modelos de IA evoluam rapidamente, a substituição total depende de uma transformação organizacional. Esta “fricção institucional e organizacional” serve de amortecedor.

No curto prazo, é mais provável assistir-se a diferenciação setorial e reavaliação de lucros do que ao colapso abrupto do sistema de crédito global.

III. O risco real: desequilíbrios estruturais

Os desequilíbrios estruturais constituem um risco mais plausível do que um colapso total.

O primeiro desequilíbrio resulta da estrutura de competências. A maioria da força de trabalho atual foi formada num contexto em que “a cognição humana era escassa”. Com a automatização de tarefas de análise padronizada e geração, estas competências terão de ser reavaliadas.

O segundo desequilíbrio advém da estrutura de rendimentos. Se os ganhos de produtividade da IA se concentrarem nos detentores de potência computacional e plataformas tecnológicas, enquanto o poder negocial do trabalho diminui, a procura dos consumidores poderá ser pressionada.

O terceiro desequilíbrio surge da gestão das expectativas. Os mercados de capitais valorizam frequentemente o crescimento antecipado para a próxima década. Quando os lucros reais ficam aquém das expectativas, as correções de avaliação amplificam a volatilidade.

Estes riscos podem combinar-se e gerar turbulência periódica. No entanto, turbulência e colapso são conceitos essencialmente distintos.

IV. Como irão mudar as estruturas de emprego?

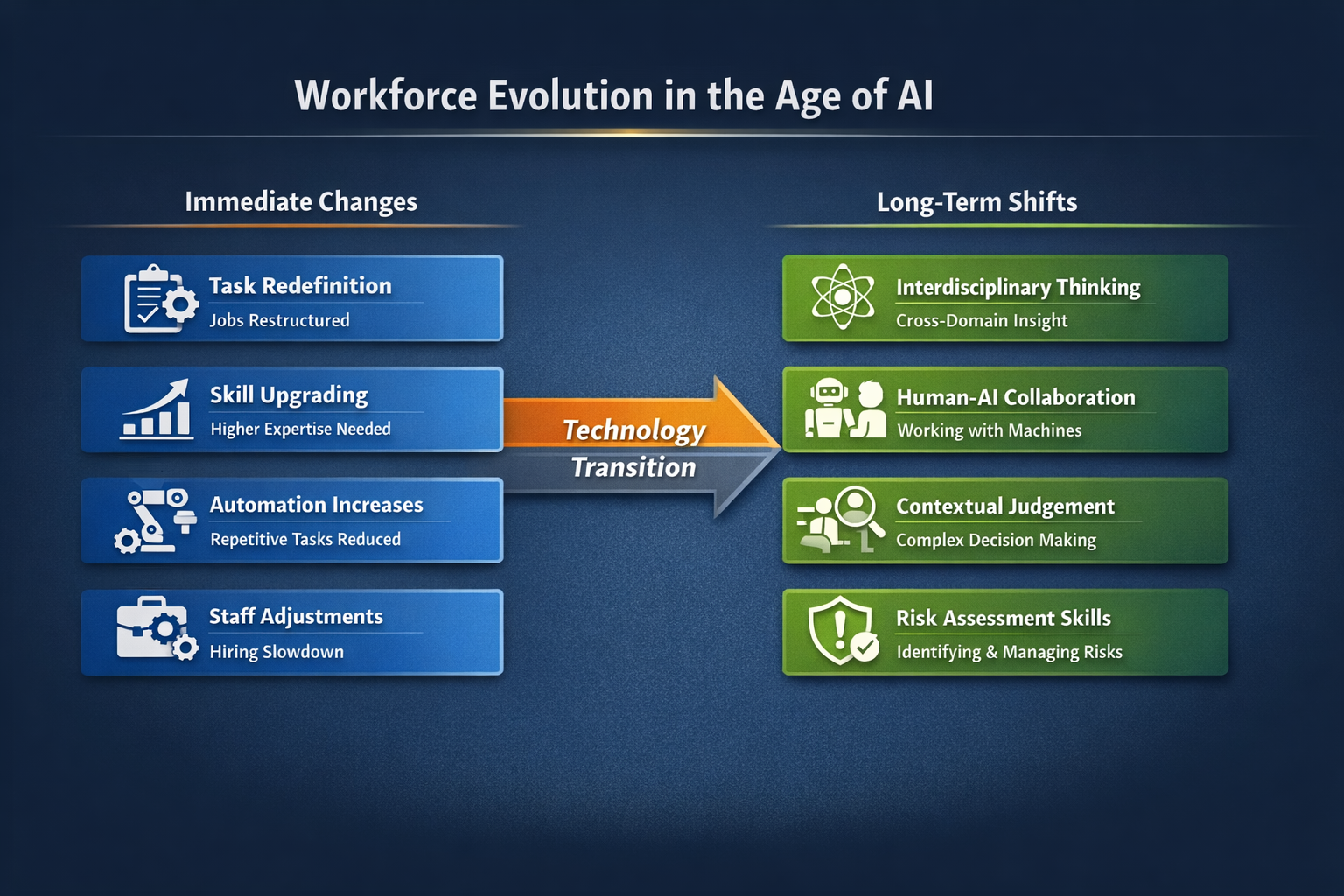

A substituição tecnológica segue, normalmente, um caminho de “substituição de tarefas”, não eliminando funções inteiras.

Uma função é geralmente composta por várias tarefas, algumas automatizáveis e outras que exigem julgamento e coordenação humana. Os cenários mais prováveis são:

- Mudança do conteúdo funcional

- Reforço das competências exigidas

- Menos tarefas repetitivas

- Mais tarefas integradas de tomada de decisão

No curto prazo, as empresas podem ajustar a força de trabalho reduzindo contratações, consolidando funções e recorrendo à rotatividade natural, em vez de substituições massivas imediatas. A tendência de longo prazo é inequívoca: o valor do trabalho cognitivo padronizado irá diminuir, enquanto o valor das competências de julgamento complexo e integração de sistemas aumentará.

Isto significa que os sistemas de educação e formação devem evoluir para:

- Compreensão interdisciplinar

- Colaboração humano-máquina

- Julgamento situacional

- Identificação de riscos

em vez de simples memorização e cálculo de fórmulas.

V. A IA irá mudar as estruturas de poder social?

Se a potência computacional e os dados se tornarem ativos centrais de produção, quem detém infraestruturas e recursos algorítmicos terá maior poder negocial.

Isto pode resultar em dois cenários:

- Os efeitos de escala intensificam-se ainda mais

- A regulação e a inovação institucional aceleram

A experiência histórica mostra que, quando a concentração tecnológica aumenta, as instituições tendem a ajustar-se em conformidade. Concorrência, reforma fiscal e normas setoriais poderão tornar-se temas centrais do debate futuro.

Em resumo, a expansão tecnológica e a reestruturação institucional costumam evoluir em paralelo.

VI. O núcleo do valor humano na era da IA

À medida que as máquinas ultrapassam largamente os humanos em velocidade e precisão, o valor humano não desaparece—desloca-se para domínios superiores.

Estes podem incluir:

- Orientação de valor e julgamento

- Desenho e supervisão institucional

- Assunção de riscos

- Integração criativa

- Construção de confiança social

A IA pode fornecer resultados computacionais, mas “qual caminho seguir” continua a ser uma decisão institucional e de poder. Isto significa que o papel humano poderá passar de executor a participante na decisão e autorização.

VII. Cenários realistas mais prováveis

Com base nas leis de difusão tecnológica e mecanismos macroeconómicos, os cenários mais prováveis incluem:

- A IA penetra profundamente em vários setores, mas a ritmos desiguais

- As margens de lucro das empresas tecnológicas aumentam periodicamente

- As funções intermédias comprimem-se, enquanto cresce a procura por funções de topo

- O alargamento das desigualdades de rendimento torna-se tema central do debate político

- A volatilidade das avaliações de mercado intensifica-se

- O capital concentra-se em potência computacional, energia e infraestruturas

Estas mudanças assemelham-se mais a uma reconfiguração estrutural do que a um colapso económico. Se surgir uma crise, é mais provável que resulte de bolhas de ativos e alavancagem excessiva do que da própria IA.

VIII. Desafios centrais durante o período de transição

O verdadeiro teste da era da IA está na forma como o período de transição é gerido.

Nesta fase:

- Algumas competências desvalorizam-se rapidamente

- A requalificação é limitada em velocidade

- A desigualdade de rendimentos agrava-se

- As expectativas de mercado são revistas sucessivamente

As políticas e as instituições devem equilibrar eficiência e estabilidade.

Seja qual for a abordagem, um caminho sustentável a longo prazo depende de ganhos reais de produtividade e de uma correspondência com a procura—não de incentivos distorcidos de forma permanente.

Conclusão: a questão não é “destruição”, mas “reconstrução”

“The 2028 Global Intelligence Crisis” apresenta um cenário de elevado impacto que nos leva a ponderar riscos extremos. Do ponto de vista macro e histórico, é mais provável que a IA conduza a uma transformação estrutural de longo prazo do que a uma destruição sistémica de curto prazo.

A verdadeira questão não é: a IA irá destruir a economia?

É: quando a capacidade cognitiva deixar de ser escassa, como irá a humanidade redefinir o valor, a distribuição e as estruturas de poder?

A tecnologia é neutra. O futuro depende das escolhas institucionais, estratégias educativas e alocação de capital. A era da IA não é um ponto final—é o início de uma nova ordem.

Artigos relacionados

Render, io.net e Akash: análise comparativa das redes DePIN de poder de hash

A aplicação da Render em IA: como o hashrate descentralizado potencia a inteligência artificial

Como os Agentes de IA Impulsionarão a Cripto no Mercado Principal

Explorando o Smart Agent Hub: Sonic SVM e seu Framework de Escalonamento HyperGrid

O que são Narrativas Cripto? Principais Narrativas para 2025 (ATUALIZADO)