As 72 horas da crise de identidade da Anthropic

Terça-feira, 24 de fevereiro. Washington, Pentágono.

Dario Amodei, CEO da Anthropic, reuniu-se frente a frente com o secretário da Defesa, Pete Hegseth. Fontes citadas pela NPR e CNN classificaram a reunião como “cordial”, embora o conteúdo tenha sido tudo menos brando.

Hegseth impôs um ultimato: até às 17h01 de sexta-feira, remover todas as restrições ao uso militar do Claude e autorizar o Pentágono a utilizá-lo para “todos os fins legais”, incluindo a seleção autónoma de alvos para armamento e vigilância doméstica em grande escala.

Em caso de incumprimento, o contrato de 200 milhões de dólares seria anulado. A Defense Production Act seria ativada para requisição obrigatória. A Anthropic seria rotulada como “risco para a cadeia de abastecimento”—ficando, na prática, na lista negra ao lado de adversários como a Rússia e a China.

Nesse mesmo dia, a Anthropic publicou a terceira edição da Responsible Scaling Policy (RSP 3.0), eliminando discretamente o seu compromisso mais central desde a fundação: não treinar modelos mais avançados sem garantias de segurança implementadas.

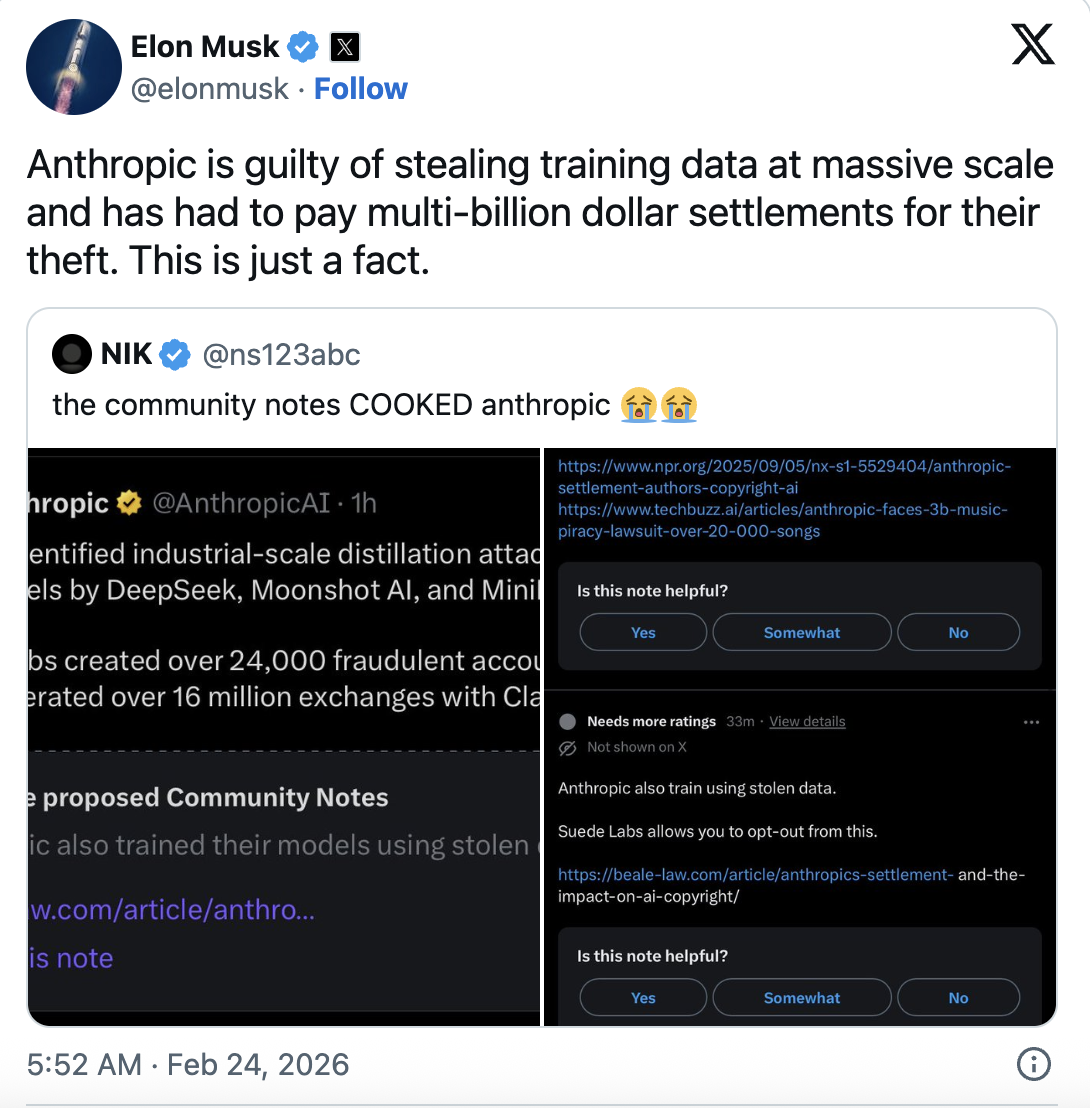

Também nesse dia, Elon Musk escreveu no X: “A Anthropic envolveu-se em roubo em larga escala de dados de treino—isto é um facto.” Ao mesmo tempo, as Community Notes do X referenciaram notícias de que a Anthropic pagou 1,5 mil milhões de dólares para resolver queixas sobre o treino do Claude com livros pirateados.

Em apenas setenta e duas horas, esta empresa de IA—que chegou a afirmar ter “alma”—passou a ser vista como mártir da segurança, ladra de propriedade intelectual e traidora do Pentágono.

Qual é a verdadeira Anthropic?

Talvez todas.

Mandato “Cumpre ou Sai” do Pentágono

A primeira camada da história é direta.

A Anthropic foi a primeira empresa de IA a garantir acesso classificado do Departamento de Defesa dos EUA, com um contrato atribuído no verão passado e limitado a 200 milhões de dólares. Seguiram-se contratos de dimensão semelhante para a OpenAI, Google e xAI.

Segundo a Al Jazeera, o Claude foi utilizado numa operação militar norte-americana em janeiro. O relatório refere que a missão envolveu o rapto do presidente venezuelano Maduro.

Mas a Anthropic traçou duas linhas vermelhas: não apoiar a seleção totalmente autónoma de alvos para armamento e não apoiar vigilância em larga escala de cidadãos norte-americanos. A Anthropic sustenta que a IA não é suficientemente fiável para controlar armamento, e não existem leis que regulem a IA em vigilância massiva.

O Pentágono não aceitou a justificação.

Em outubro passado, o conselheiro de IA da Casa Branca, David Sacks, acusou publicamente a Anthropic no X de “instrumentalizar o medo para capturar a regulação”.

Os concorrentes já cederam. OpenAI, Google e xAI aceitaram permitir o uso militar das suas IA em “todos os cenários legais”. O Grok de Musk foi aprovado para sistemas classificados esta semana.

A Anthropic é a última resistente.

No momento em que este artigo é escrito, a Anthropic afirma no seu anúncio mais recente que não tenciona ceder. Mas o prazo de sexta-feira, 17h01, está a chegar.

Um antigo responsável anónimo pela ligação entre o Departamento de Justiça e o Pentágono disse à CNN: “Como é possível declarar uma empresa como ‘risco para a cadeia de abastecimento’ e, ao mesmo tempo, obrigá-la a trabalhar para o exército?”

É uma boa questão—mas não interessa ao Pentágono. O que lhes importa é que, se a Anthropic não ceder, vão impor a conformidade ou deixar a Anthropic ao abandono em Washington.

“Distillation Attack”: Uma acusação pública sai pela culatra

A 23 de fevereiro, a Anthropic publicou um artigo contundente no blogue, acusando três empresas chinesas de IA—DeepSeek, Moonshot AI e MiniMax—de conduzirem “ataques de destilação em escala industrial” ao Claude.

A Anthropic alegou que estas empresas usaram 24 000 contas falsas para iniciar mais de 16 milhões de interações com o Claude, extraindo sistematicamente as suas principais capacidades em raciocínio de agentes, uso de ferramentas e programação.

A Anthropic apresentou isto como uma ameaça à segurança nacional, afirmando que os modelos destilados “são pouco prováveis de manter salvaguardas de segurança” e podem ser explorados por governos autoritários em ciberataques, desinformação e vigilância massiva.

A narrativa foi bem cronometrada e estruturada.

Foi publicada logo após a administração Trump relaxar os controlos de exportação de chips para a China—precisamente quando a Anthropic precisava de novo argumento para o seu lobby sobre exportação de chips.

Mas Musk respondeu: “A Anthropic envolveu-se em roubo em larga escala de dados de treino e pagou milhares de milhões em acordos. Isto é um facto.”

O cofundador da IO.Net, Tory Green, comentou: “Treinam os vossos modelos com toda a internet e, quando outros aprendem a partir da vossa API pública, chamam-lhe ‘ataque de destilação’?”

A Anthropic chama “ataque” à destilação, mas é prática comum na indústria de IA. A OpenAI usou-a para comprimir o GPT-4, a Google para otimizar o Gemini, e a própria Anthropic já recorreu a ela. A diferença agora: a Anthropic é o alvo.

Como referiu Erik Cambria, professor de IA na Nanyang Technological University, à CNBC: “A fronteira entre uso legítimo e exploração maliciosa é frequentemente difusa.”

Ainda mais irónico, a Anthropic acabou de pagar 1,5 mil milhões de dólares para resolver queixas por treinar o Claude com livros pirateados. Treinaram com toda a internet, depois acusaram outros de aprenderem a partir da sua API pública. Não é só duplo padrão—é triplo padrão.

A Anthropic quis assumir o papel de vítima, mas acabou no banco dos réus.

Desmantelar compromissos de segurança: RSP 3.0

No mesmo dia em que enfrentou o Pentágono e trocou argumentos com Silicon Valley, a Anthropic publicou a terceira versão da Responsible Scaling Policy.

Jared Kaplan, Chief Scientist, declarou aos media: “Não acreditamos que parar o treino de modelos de IA beneficie alguém. Com a IA a evoluir tão rapidamente, assumir compromissos unilaterais enquanto os concorrentes avançam a toda a velocidade não faz sentido.”

Ou seja, se os outros não seguem as regras, nós também não seguiremos.

O essencial da RSP 1.0 e 2.0 era um compromisso firme: se as capacidades do modelo excedessem o âmbito das salvaguardas, o treino seria suspenso. Essa promessa deu à Anthropic reputação única na comunidade de segurança em IA.

Mas a versão 3.0 abandonou esse compromisso.

Foi substituído por um quadro mais “flexível”—distingue medidas de segurança que a Anthropic pode implementar de recomendações para o setor. A cada 3–6 meses, será publicado um relatório de risco, com revisão externa de especialistas.

Parece responsável?

Chris Painter, revisor independente da METR, afirmou após ver uma versão preliminar: “Isto mostra que a Anthropic acredita que precisa de entrar em ‘modo de triagem’ porque a avaliação e mitigação de riscos não conseguem acompanhar o crescimento das capacidades. É mais uma prova de que a sociedade não está preparada para os riscos catastróficos da IA.”

A TIME noticiou que a Anthropic passou quase um ano a debater internamente esta reescrita, com aprovação unânime do CEO Amodei e do conselho de administração. Oficialmente, a política original pretendia promover consenso no setor—mas a indústria não seguiu. A administração Trump adotou uma abordagem de não intervenção na IA, chegando a tentar revogar leis estaduais. A legislação federal sobre IA continua fora de alcance. Em 2023, parecia possível um quadro global de governança, mas três anos depois, essa porta fechou-se.

Um investigador anónimo, veterano em governança de IA, resumiu: “A RSP é o maior ativo de marca da Anthropic. Abandonar a pausa no treino é como uma empresa de alimentos biológicos retirar discretamente ‘biológico’ do rótulo e depois afirmar que os testes agora são mais transparentes.”

Crise de identidade com avaliação de 380 mil milhões

No início de fevereiro, a Anthropic fechou uma ronda de financiamento de 30 mil milhões de dólares, atingindo uma avaliação de 380 mil milhões, com a Amazon como principal investidor. Desde a fundação, atingiu 14 mil milhões em receitas anualizadas, e nos últimos três anos esse valor multiplicou-se mais de dez vezes por ano.

Ao mesmo tempo, o Pentágono ameaça colocar a empresa na lista negra. Musk acusa-a publicamente de roubo de dados. O compromisso central de segurança desapareceu. O responsável máximo pela segurança em IA da Anthropic, Mrinank Sharma, demitiu-se e escreveu no X: “O mundo está em perigo.”

Contradição?

Talvez a contradição seja o ADN da Anthropic.

Fundada por antigos executivos da OpenAI preocupados com o ritmo da segurança na OpenAI, a Anthropic acabou por construir modelos ainda mais poderosos, mais rapidamente, enquanto alertava para o perigo desses mesmos modelos.

O modelo de negócio, em resumo: tememos a IA mais do que ninguém, por isso deve pagar-nos para a desenvolvermos.

Esta narrativa funcionou na perfeição em 2023–2024. A segurança em IA era palavra-chave em Washington, e a Anthropic era o lobbyista em destaque.

Em 2026, o vento mudou.

“Woke AI” tornou-se insulto político, a regulação da IA ao nível dos estados foi travada pela Casa Branca e, embora a SB 53 da Califórnia (apoiada pela Anthropic) tenha sido aprovada, nada avançou a nível federal.

A narrativa de segurança da Anthropic está a passar de “fator diferenciador” para “passivo político”.

A Anthropic executa um exercício de equilíbrio complexo—precisa de ser suficientemente “segura” para proteger a marca, mas “flexível” para não ser rejeitada pelo mercado ou pelo governo. O problema: a tolerância de ambos os lados está a diminuir.

Quanto vale agora a narrativa da segurança?

Em conjunto, os três acontecimentos traçam um quadro inequívoco.

Acusar empresas chinesas de destilar o Claude reforça o lobby para controlar a exportação de chips. Abandonar a pausa de segurança mantém a Anthropic na corrida armamentista. Recusar a exigência do Pentágono para armas autónomas preserva a última camada de credibilidade moral.

Cada passo é lógico, mas cada um contradiz os restantes.

Não se pode afirmar que empresas chinesas “destilarem” o seu modelo ameaça a segurança nacional e, ao mesmo tempo, eliminar o próprio compromisso de evitar que o modelo fique fora de controlo. Se o modelo é assim tão perigoso, deveria ser mais cauteloso—não mais agressivo.

A menos que seja a Anthropic.

No setor da IA, a identidade não é definida pelas declarações—é definida pelo balanço. A narrativa de “segurança” da Anthropic é, no fundo, um prémio de marca.

No início da corrida armamentista de IA, esse prémio era valioso. Investidores pagavam mais por “IA responsável”, governos aprovavam “IA de confiança” e clientes pagavam por “IA mais segura”.

Mas em 2026, esse prémio está a desaparecer.

A Anthropic enfrenta agora não a questão de “devemos ceder”, mas sim “a quem cedemos primeiro”. Se cede ao Pentágono, a marca sofre. Se cede aos concorrentes, o compromisso de segurança é anulado. Se cede aos investidores, ambos os lados têm de ceder.

Às 17h01 de sexta-feira, a Anthropic dará a sua resposta.

Independentemente do desfecho, uma coisa é certa: a Anthropic que prosperava com o “somos diferentes da OpenAI” está a tornar-se igual a todas as outras.

O fim de uma crise de identidade é, muitas vezes, o desaparecimento da própria identidade.

Declaração:

- Este artigo é republicado de [TechFlow]. Os direitos de autor pertencem ao autor original [Ada]. Caso tenha alguma questão sobre esta republicação, contacte a equipa Gate Learn, que atuará conforme os procedimentos aplicáveis.

- Declaração de exoneração de responsabilidade: As opiniões expressas neste artigo são da exclusiva responsabilidade do autor e não constituem aconselhamento de investimento.

- Outras versões linguísticas deste artigo são traduzidas pela equipa Gate Learn. Sem menção a Gate, os artigos traduzidos não podem ser copiados, distribuídos ou plagiados.

Artigos relacionados

Modelo Económico do Token ONDO: De que forma impulsiona o crescimento da plataforma e o envolvimento dos utilizadores?

Tokenomics da Morpho: Utilidade, distribuição e proposta de valor do MORPHO

Morpho vs. Aave: Análise aprofundada das diferenças de mecanismo e estrutura nos protocolos de empréstimos DeFi

Render, io.net e Akash: análise comparativa das redes DePIN de poder de hash

Utilização de Bitcoin (BTC) em El Salvador - Análise do Estado Atual