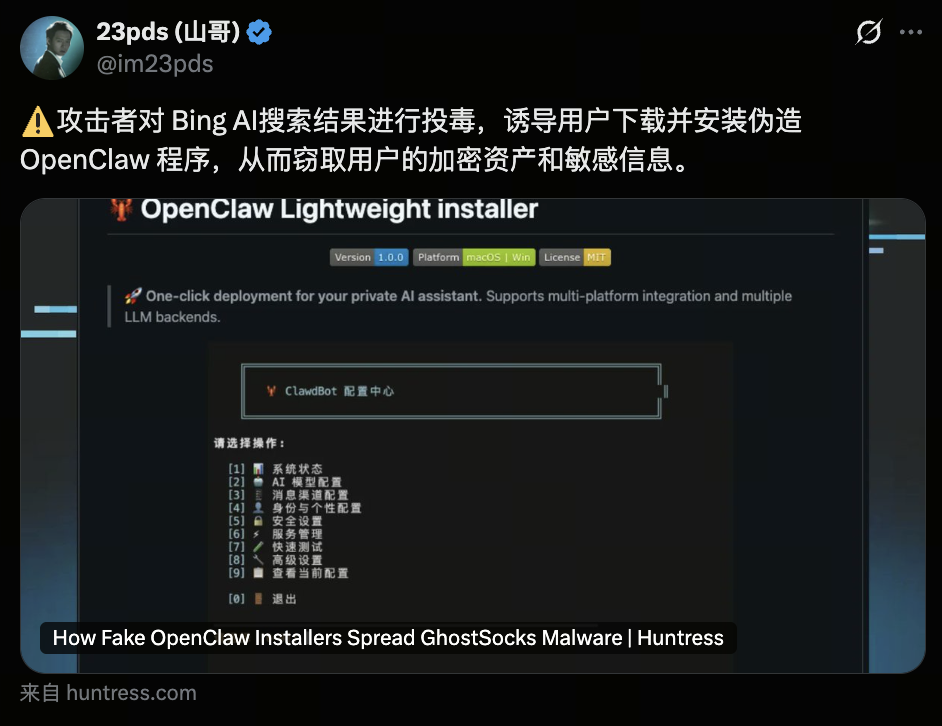

Suspeita-se que os resultados de pesquisa do Bing AI tenham sido comprometidos: hackers desenvolveram instaladores falsos do OpenClaw para furtar ativos cripto, evidenciando os riscos de segurança associados às pesquisas baseadas em IA.

Suspeita de Manipulação nos Resultados de Pesquisa Bing AI

Fonte da imagem: https://x.com/im23pds/status/2031163246783410581

Fonte da imagem: https://x.com/im23pds/status/2031163246783410581

Em março de 2026, o diretor de segurança da SlowMist, empresa especializada em segurança blockchain, alertou publicamente para a possibilidade de manipulação dos resultados de pesquisa Bing AI por métodos de "search poisoning". Os atacantes atraíram utilizadores para descarregar um programa falso OpenClaw, apropriando-se de ativos cripto e informações confidenciais.

"Search poisoning" descreve o processo em que atacantes desenvolvem websites ou repositórios específicos para subir nos rankings dos motores de busca. Quando utilizadores pesquisam determinadas palavras-chave, os sites maliciosos podem aparecer nos primeiros lugares ou ser citados diretamente por resultados de pesquisa baseados em IA.

Neste caso, pesquisas por termos como “OpenClaw Windows” levaram o Bing AI a recomendar um repositório GitHub fraudulento como fonte de download. Após a execução do instalador, vários dispositivos foram infetados com malware de roubo de dados.

Especialistas em segurança confirmaram que o repositório e o instalador maliciosos já foram removidos, mas o incidente provocou debate generalizado sobre a segurança das pesquisas IA e a proteção de ativos cripto.

O Que É OpenClaw? Porque É Um Alvo?

Fonte da imagem: OpenClaw Official Site

Fonte da imagem: OpenClaw Official Site

OpenClaw tornou-se recentemente uma ferramenta open-source de referência para a comunidade de desenvolvimento de agentes IA e automação, usada para construir agentes IA, automatizar tarefas e criar toolchains de desenvolvimento.

Com a rápida evolução dos frameworks de desenvolvimento de agentes IA e automação, a adesão a estas ferramentas está a crescer de forma acelerada.

Este ecossistema de programadores em expansão é especialmente apetecível para atacantes, devido a vários fatores:

- Programadores confiam em repositórios open-source: É prática comum descarregar ferramentas e código do GitHub.

- Toolchains IA exigem permissões elevadas: Muitas soluções IA requerem acesso a ficheiros do sistema, chaves API ou credenciais cloud.

- Grande interseção com utilizadores cripto: Os programadores IA, Web3 e investidores cripto frequentemente coincidem.

Assim, ao distribuir instaladores OpenClaw falsos, os atacantes têm acesso direto a dispositivos com chaves privadas de wallets, contas de trading ou chaves API.

Mecanismo de Ataque: Search Poisoning e Disseminação de Malware

Falsificação de Repositórios GitHub e Exploração da Confiança Comunitária

Investigadores identificaram a criação da organização GitHub “openclaw-installer” por atacantes, que publicaram repositórios aparentemente legítimos.

Para aumentar a credibilidade, copiaram partes do código-fonte genuíno, tornando a estrutura do repositório bastante convincente.

A reputação do GitHub junto da comunidade de desenvolvimento, aliada às recomendações da IA, levou muitos utilizadores a assumir que o repositório era oficial.

O ataque decorreu assim:

- Pesquisa por OpenClaw via Bing AI

- IA recomenda o repositório GitHub malicioso

- Utilizador descarrega o instalador falso

- Código malicioso executa operações de roubo de dados de forma invisível

Este ataque explora a confiança no open-source e as recomendações IA, multiplicando o seu potencial de sucesso.

Payloads Específicos para Windows e macOS

Os investigadores verificaram que os atacantes criaram payloads distintos para cada sistema operativo.

Vetor de ataque Windows:

- Distribuição de instalador falso designado OpenClaw_x64.exe

- Execução do Vidar info-stealer em memória

- Instalação simultânea do trojan GhostSocks para controlo remoto

Vetor de ataque macOS:

- Instruções de instalação fraudulentas

- Manipulação dos utilizadores para correr comandos Bash no Terminal

- Download e instalação do malware Atomic Stealer

Estes programas maliciosos destinam-se sobretudo ao roubo de:

- Palavras-passe de browsers

- Chaves de wallets cripto

- Chaves SSH

- Tokens API

- Dados de login Telegram/Discord

Após a recolha, os atacantes podem transferir rapidamente os ativos cripto das vítimas.

Search Poisoning e SEO Potenciado por IA: A Nova Fronteira dos Ciberataques

Embora o search poisoning exista há muito tempo, o avanço das pesquisas impulsionadas por IA agrava o impacto. A investigação revela que atacantes manipulam conteúdos web, estrutura de repositórios e palavras-chave para promover recursos maliciosos nos resultados de pesquisa.

A pesquisa IA traz riscos acrescidos:

- IA resume e recomenda conteúdos de forma ativa

- Utilizadores tendem a confiar nas recomendações da IA

- Links recomendados podem escapar aos filtros tradicionais dos motores de busca

Analistas de segurança alertam que a simples disponibilização de código malicioso num repositório GitHub aparentemente legítimo pode levar à sua indexação e recomendação por motores de busca.

Assim, a combinação de pesquisa IA e plataformas open-source consolida-se como novo vetor de ataque relevante.

Impacto no Setor Cripto e Ecossistema de Programadores

Este episódio evidenciou três tendências principais:

1. Ferramentas IA tornaram-se vetores de ataque prioritários

À medida que agentes IA e ferramentas de automação ganham notoriedade, cresce o uso de malware disfarçado de ferramenta IA.

2. Confiança no open-source está a ser explorada

Plataformas como GitHub e PyPI, apesar de abertas e transparentes, são vulneráveis ao abuso por agentes maliciosos.

3. Ativos cripto são alvos preferenciais

Malware stealer procura sobretudo:

- MetaMask

- Wallets em browsers

- Ficheiros de wallet locais

- Chaves API

Uma vez comprometidos, estes ativos são raramente recuperáveis.

Guia de Segurança: Como Evitar Ataques Semelhantes

Dada a crescente sofisticação dos ataques, recomenda-se aos utilizadores que adotem as seguintes práticas:

1. Descarregar software apenas de fontes oficiais

Evitar downloads diretos a partir de resultados de pesquisa; recorrer sempre a GitHub ou sites oficiais.

2. Verificar repositórios de código

Avaliar:

- Verificação oficial

- Histórico de commits consistente

- Comunidade ativa de desenvolvimento

3. Confirmar assinaturas dos instaladores

Projetos com maior preocupação pela segurança disponibilizam assinaturas SHA256 ou GPG.

4. Usar dispositivos dedicados para gestão de chaves privadas

Evitar armazenar chaves privadas de alto valor em ambientes de desenvolvimento.

5. Utilizar hardware wallets

Mesmo perante compromissos no computador, hardware wallets garantem proteção adicional robusta.

Desafios de Segurança e Perspetivas na Era das Pesquisas IA

O caso de manipulação nas pesquisas Bing AI demonstra que os sistemas IA continuam a apresentar dificuldades na filtragem de conteúdos confiáveis.

À medida que pesquisas IA, agentes IA e ferramentas de automação se tornam portas de entrada fundamentais na internet, os atacantes refinam os seus métodos, incluindo:

- Manipulação de pesquisas IA

- Distorção de conteúdos gerados por IA

- Inclusão de código malicioso em plugins de agentes IA

No futuro, as plataformas terão de reforçar as suas defesas através de:

- Verificação rigorosa das fontes dos resultados IA

- Implementação de scoring de confiança para repositórios open-source

- Melhoramento da deteção automática de malware

Para os utilizadores, numa era de integração entre ferramentas IA e ativos cripto, a consciência de segurança torna-se a principal barreira para proteger ativos digitais.

Artigos relacionados

Tokenomics do USD.AI: análise aprofundada dos casos de utilização do token CHIP e dos mecanismos de incentivos

Análise das Fontes de ganhos de USD.AI: como os empréstimos de infraestrutura de IA geram retorno

A aplicação da Render em IA: como o hashrate descentralizado potencia a inteligência artificial

Render, io.net e Akash: análise comparativa das redes DePIN de poder de hash

Cardano vs Ethereum: Compreender as diferenças essenciais entre duas plataformas líderes de contratos inteligentes