Anthropic processa o governo de Trump: a etiqueta de "risco na cadeia de abastecimento" é uma retaliação ilegal

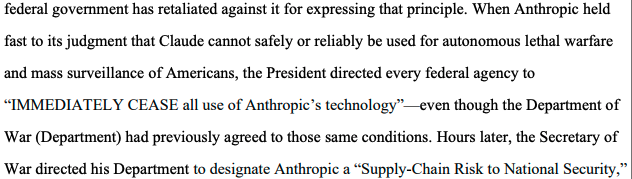

A empresa de software de inteligência artificial Claude, da Anthropic, entrou com uma ação na segunda-feira contra o governo Trump num tribunal federal na Califórnia, alegando que o governo lançou uma “ação de retaliação ilegal” contra a empresa, por ela se recusar a permitir que o exército utilize a sua tecnologia sem restrições — incluindo o uso em armas autônomas letais e vigilância doméstica em larga escala. Esta é a primeira vez na história dos EUA que uma empresa nacional é considerada uma ameaça à cadeia de fornecimento militar.

Etiqueta de risco na cadeia de fornecimento: reconhecimento sem precedentes pelo Pentágono

O ponto de partida desta batalha legal foi uma decisão final do Secretário de Defesa Pete Hegseth em 3 de março de 2026: classificar a Anthropic como uma empresa de risco na cadeia de fornecimento militar. As consequências legais dessa classificação são diretas e severas — qualquer pessoa ou empresa que faça negócios com o exército não poderá mais negociar com a Anthropic, sendo efetivamente excluída do mercado de compras federais.

Vale notar que, até agora, esse tipo de classificação de risco na cadeia de fornecimento era usado apenas para empresas suspeitas de ligação com forças estrangeiras hostis, nunca tendo sido aplicada a empresas americanas domésticas. A Anthropic descreve essa ação como “sem precedentes e ilegal”, alegando que “a Constituição não permite que o governo use seu enorme poder para punir uma empresa por sua liberdade de expressão protegida.”

A ação legal conta com uma extensa lista de réus, incluindo Pete Hegseth (Secretário de Defesa), Scott Bessent (Secretário do Tesouro), Marco Rubio (Secretário de Estado) e outros 17 órgãos e funcionários do governo, abrangendo vários setores centrais do governo federal dos EUA.

A linha vermelha da Anthropic: armas letais e vigilância em massa

(Fonte: CourtListener)

(Fonte: CourtListener)

Segundo alegações da Anthropic na ação, Hegseth exigiu que a empresa “abandonasse completamente suas restrições de uso” — o que a Anthropic recusou, pois essas restrições fazem parte do contrato com o governo, com o objetivo de impedir que o Claude seja utilizado para duas finalidades específicas:

Sistemas de armas autônomas letais: sistemas de decisão de ataque automatizados que não requerem confirmação final humana

Vigilância em massa de cidadãos americanos: uso de IA para coleta e análise em larga escala de dados pessoais de cidadãos

Na ação, a Anthropic afirma claramente: “A Anthropic nunca testou o Claude para esses usos. Atualmente, a Anthropic não acredita que, ao usar o Claude para apoiar guerras autônomas letais, ele possa operar de forma confiável ou segura.”

Essa posição está alinhada com os princípios de segurança de IA defendidos pela empresa há anos, mas entra em conflito fundamental com a política do governo Trump de ampliar o uso de IA militar. É importante notar que, desde 2024, o governo dos EUA e o Pentágono vêm utilizando a tecnologia da Anthropic, sendo o Claude a primeira IA implantada em ambientes confidenciais. A classificação de risco também veio acompanhada de uma ordem direta de Trump para que funcionários federais parassem de usar o Claude.

Engenheiros do OpenAI e Google apoiam coletivamente: resposta do setor de IA

Após o início da batalha legal, a reação da indústria de IA foi rápida e ampla. Na segunda-feira, mais de 30 engenheiros e cientistas do OpenAI e do Google, incluindo o cientista-chefe do Google Jeff Dean, apresentaram um amicus brief — documento de apoio legal — em defesa da Anthropic.

Esses profissionais alertaram no documento: “Permitir que ações punitivas contra uma das principais empresas de IA dos EUA continue, sem dúvida, prejudicará a competitividade industrial e científica dos EUA em IA e outros setores.” Essa preocupação aponta para um medo mais amplo: se o governo usar a classificação de risco na cadeia de fornecimento para reprimir empresas de IA nacionais, isso pode enfraquecer a vantagem competitiva dos EUA na corrida global de IA contra a China.

Perguntas frequentes

Qual o impacto específico da etiqueta de risco na cadeia de fornecimento na Anthropic?

Segundo a lei americana, ser classificada como uma empresa de risco na cadeia de fornecimento significa que qualquer pessoa ou entidade que faça negócios com o exército não pode negociar com a empresa listada. Isso equivale a excluir a Anthropic de todo o ecossistema de compras federais, afetando não apenas contratos militares diretos, mas também todos os fornecedores e parceiros que tenham negócios com o governo.

Por que a Anthropic recusa abrir o uso para armas letais?

A posição da Anthropic é que o Claude nunca foi testado ou avaliado para uso em armas letais autônomas, e a empresa não consegue garantir sua confiabilidade ou segurança nessas aplicações. Além disso, seus princípios de segurança de IA sempre foram contrários à implantação de sistemas de decisão autônoma de alto risco sem testes adequados, especialmente em contextos militares que envolvem vidas humanas.

O que significa o apoio de engenheiros do Google e OpenAI à Anthropic?

A assinatura de mais de 30 engenheiros e cientistas de empresas concorrentes demonstra a preocupação do setor de IA com a possibilidade de o governo usar a classificação de risco na cadeia de fornecimento para interferir na liberdade de empresas de IA. O apoio reforça a ideia de que, se o governo puder usar esse tipo de ferramenta para reprimir empresas que não se alinham às suas políticas, qualquer companhia que se recuse a abrir suas tecnologias poderá enfrentar o mesmo destino.