A inteligência artificial provocará um colapso econômico global em 2028? Uma análise detalhada do relatório “Crise Global de Inteligência de 2028” e das reais perspectivas sobre previsões catastróficas envolvendo IA

O que realmente aborda o relatório "Crise Global de Inteligência de 2028"?

O mercado voltou recentemente sua atenção para um relatório coassinado pelo fundador da Citrini Research, James van Geelen, e Alap Shah — "Crise Global de Inteligência de 2028". Apresentado sob uma “perspectiva futura” de junho de 2028, o relatório revisita os últimos anos e descreve um cenário em que a IA rapidamente substitui um grande número de empregos de colarinho branco. Isso resulta em colapso da demanda do consumidor, queda nos lucros corporativos, desvalorização dos ativos e, por fim, uma crise econômica sistêmica global.

Os autores destacam que se trata de uma “análise de cenários”, não de uma previsão. Ainda assim, a narrativa dramática do relatório, combinada ao rápido avanço da IA, impulsionou a disseminação da tese do “apocalipse da IA” — alimentando preocupações de investidores sobre ações de tecnologia e perspectivas de emprego.

Para alguns economistas, o relatório é um experimento mental de “teste de estresse”, com premissas extremas sobre velocidade de substituição e atraso de políticas, superestimando a chance de colapso sistêmico. Investidores o veem como um alerta sobre o potencial disruptivo da produtividade da IA. O relatório realmente provocou volatilidade nas ações de tecnologia, mas muitos traders atribuem isso ao sentimento, não aos fundamentos. No geral, embora o mainstream rejeite o cenário do “apocalipse da IA”, reconhece que, se a IA superar a capacidade de adaptação da sociedade, choques estruturais são prováveis.

Isso leva a uma questão central: esse cenário pode realmente acontecer em 2028?

Por que a narrativa do "apocalipse da IA" provoca pânico no mercado?

A tese do “apocalipse da IA” ganha força por tocar em três ansiedades atuais:

- A IA está substituindo funções de conhecimento de alta renda

- Empresas estão implementando automação em larga escala

- Os ganhos de produtividade podem reduzir a demanda por trabalho

Diferente das ondas anteriores de automação industrial, esta fase da IA atinge principalmente funções cognitivas — como análise, redação, programação, atendimento ao cliente e pesquisa financeira. Ela ameaça diretamente a segurança do emprego da classe média, não apenas dos operários.

Quando as expectativas de emprego e renda são abaladas, o mercado de capitais reage antecipadamente.

Mas há frequentemente um descompasso — e diferença de intensidade — entre sentimento e realidade.

Maturidade da IA: 2028 pode realmente trazer uma disrupção econômica global?

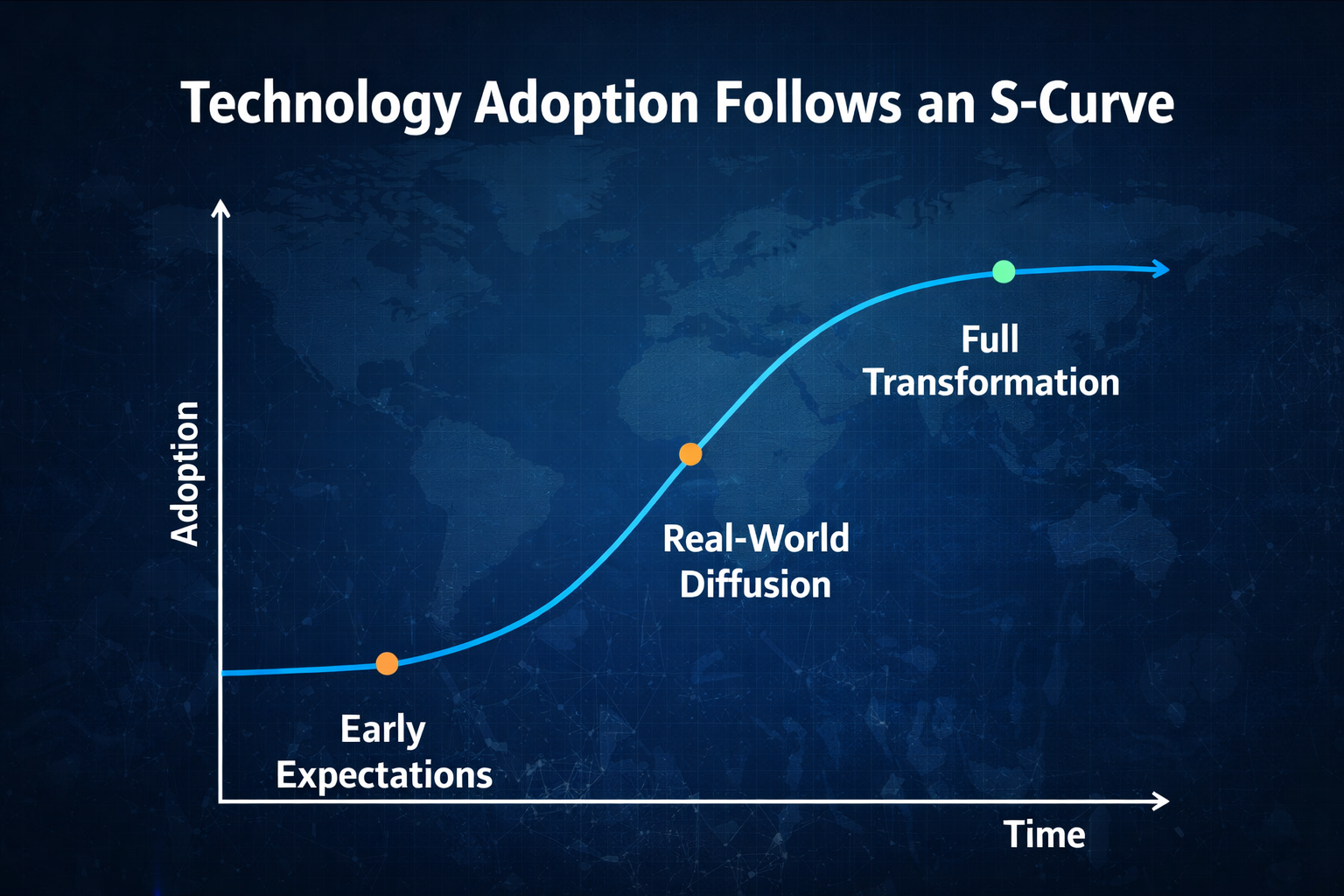

A avaliação do risco de colapso sistêmico começa pelo ritmo de difusão tecnológica.

Historicamente, a adoção de tecnologia segue uma curva S:

- Expectativas elevadas na fase inicial

- Implementação e ajustes na fase intermediária

- Implantação em larga escala na fase final

Mesmo com o avanço das capacidades da IA, as empresas ainda precisam:

- Reestruturar sistemas de TI

- Governar dados

- Conduzir revisões de conformidade

- Redesenhar processos organizacionais

Tudo isso leva tempo. 2028 está próximo. Sob a ótica macroeconômica, é improvável que empresas globais consigam substituir toda a força de trabalho até lá. O cenário mais provável é de “alta eficiência localizada e substituição gradual”.

A tecnologia pode avançar rapidamente, mas a transformação estrutural na economia é um processo lento.

Uma onda de desemprego de colarinho branco vai acontecer?

A cadeia central do relatório é:

Substituição por IA → desemprego em massa de colarinho branco → colapso do consumo → crise de crédito → turbulência no sistema financeiro

Na prática, os ajustes corporativos costumam ser graduais:

- Congelamento de contratações

- Rotatividade natural

- Consolidação de departamentos

- Demissões pontuais

Raramente ocorre uma substituição total e imediata de todos os postos de trabalho.

Além disso, novas tecnologias normalmente criam novas funções:

- Gestão e otimização de IA

- Governança de dados

- Segurança de algoritmos

- Design de colaboração homem-máquina

O risco real é a “compressão de habilidades intermediárias”, não o desemprego em massa.

Portanto, até 2028, é mais provável vermos uma polarização na estrutura de empregos — não um colapso completo.

A IA pode desencadear uma crise financeira sistêmica?

Crises financeiras sistêmicas geralmente exigem dois fatores:

- Alto nível de alavancagem

- Reação em cadeia de falhas nos balanços

A crise de 2008 foi um colapso interno do sistema de crédito; a pandemia de 2020, um choque externo. O impacto da IA tende mais a ser um “evento de reconfiguração da estrutura de lucros” do que uma deterioração direta dos ativos bancários.

Além disso, o sistema macroeconômico atual conta com:

- Estabilizadores automáticos (seguro-desemprego)

- Ferramentas ágeis dos Bancos Centrais para cortes de juros

- Capacidade de estímulo fiscal

Isso significa que, mesmo que a pressão sobre o emprego aumente, os formuladores de políticas podem agir rapidamente. As chances de a IA provocar o colapso instantâneo do sistema global de crédito são baixas.

Qual o cenário mais provável para 2028?

Considerando os padrões de adoção tecnológica e transmissão macroeconômica, o cenário mais provável para 2028 não é de “colapso econômico sistêmico global”, mas sim de uma transformação estrutural gradual e profunda.

1.As margens de lucro do setor de tecnologia podem subir temporariamente. A adoção ampla de IA reduzirá drasticamente o custo marginal — especialmente em desenvolvimento de software, atendimento ao cliente, análise de dados e criação de conteúdo. Empresas líderes, com vantagens em dados, computação e modelos, reforçarão ainda mais os efeitos de escala e rede, concentrando lucros no topo. Esse “dividendo de eficiência” pode impulsionar temporariamente a rentabilidade do setor de tecnologia.

2.Algumas funções de colarinho branco vão encolher, mas não desaparecer. A reestruturação funcional é mais provável do que a substituição total. Trabalhos repetitivos, processuais e padronizados serão os primeiros afetados, enquanto funções que exigem decisões complexas, habilidades interpessoais e criatividade manterão seu valor. O mercado de trabalho terá uma clara estratificação de habilidades — quem dominar a colaboração com IA verá sua renda crescer, enquanto os demais enfrentarão pressão.

3.A desigualdade de renda tende a aumentar como risco real. O dividendo de produtividade da IA pode beneficiar primeiro o capital, as plataformas de tecnologia e profissionais altamente qualificados, enquanto trabalhadores intermediários perdem poder de barganha. Essa distribuição desigual pode provocar mudanças no consumo, na psicologia social ou até pressionar políticas de redistribuição.

4.A volatilidade do mercado vai aumentar significativamente. Quando as expectativas de produtividade são rapidamente reprecificadas, os mercados de capitais passam por ciclos dramáticos de avaliação. Ações de empresas ligadas à IA podem disparar com altas expectativas, mas, se os lucros não acompanharem, a volatilidade tende a explodir.

5.O capital tende a se concentrar ainda mais em infraestrutura de IA. Computação, chips, data centers, energia e plataformas em nuvem serão os principais beneficiados no longo prazo. Em relação à camada de aplicações, os recursos fundamentais são mais insubstituíveis e têm maior poder de precificação — direcionando os investimentos para “computação e energia”.

O resultado mais provável da IA é um “choque estrutural”, não uma “destruição sistêmica”. O sistema econômico não vai colapsar, mas a alocação de recursos mudará de forma fundamental.

Os riscos estarão centrados em:

- Bolhas de ativos

- Superavaliação

- Alavancagem

Se houver uma crise, o mais provável é o estouro da bolha narrativa da IA — não a destruição da economia pela IA.

Como investidores devem abordar riscos e oportunidades em IA?

Do ponto de vista do investimento, três categorias de risco importam.

Ao investir em IA, a questão não é se você “acredita em IA” — e sim onde estão os riscos. Eles se dividem em três tipos:

1. Risco tecnológico: Melhorias nos modelos podem desacelerar, custos de computação podem subir ou regulações mais rígidas podem limitar a adoção. Se o progresso ficar abaixo das expectativas do mercado, as altas avaliações estarão vulneráveis a correção.

2. Risco narrativo: Os mercados costumam antecipar uma década de ganhos de produtividade. Se os lucros não surgirem tão rápido quanto esperado, as avaliações podem se comprimir rapidamente. A maioria das revoluções tecnológicas passa por ciclos de “narrativa superaquecida — validação de lucros — retorno à média de avaliação”.

3. Risco estrutural: Se a IA comprimir funções intermediárias no curto prazo e a renda migrar para o capital, a demanda do consumidor pode enfraquecer — impactando o crescimento em alguns setores.

No longo prazo, a IA tende a elevar a produtividade, mas a volatilidade de curto prazo é inevitável. Estratégias racionais incluem:

Diversificar para evitar risco de concentração em um único setor

Focar na qualidade do fluxo de caixa e escolher empresas com lucratividade comprovada

Evitar alta alavancagem para limitar perdas em períodos voláteis

Monitorar mudanças regulatórias e fiscais, pois elas podem alterar tendências do setor

O verdadeiro risco não está na tecnologia em si — está em como o mercado a valoriza.

Conclusão: a IA causará um colapso econômico global em 2028?

Considerando o ritmo de adoção tecnológica, ciclos de transformação corporativa, capacidade macro de políticas e estabilidade do sistema financeiro, a probabilidade de um colapso sistêmico global é baixa. No entanto, o risco de choques estruturais no emprego e de maior volatilidade de mercado é significativo. A “Crise Global de Inteligência de 2028” deve ser vista como um teste de estresse macro — um chamado para focar no descompasso entre a velocidade de substituição da IA e a capacidade de adaptação da sociedade.

A IA não é uma máquina do fim do mundo — é um amplificador. Amplifica a eficiência, mas também amplia os desequilíbrios. O que realmente determinará 2028 não será apenas a capacidade tecnológica, mas a resposta das políticas, a adaptabilidade social e a racionalidade dos mercados de capitais.

Racionalidade importa mais do que pânico.

Artigos Relacionados

Morpho vs Aave: Análise comparativa dos mecanismos e diferenças estruturais nos protocolos de empréstimo DeFi

Tokenomics da Morpho: utilidade do MORPHO, distribuição e proposta de valor

O que é o EIP-1559? Como funcionam o burning de ETH e o mecanismo de taxas?

O que é a Ethereum Virtual Machine (EVM) e como ela executa smart contracts?

Tokenomics UNITAS: mecanismos de incentivo, distribuição de oferta e valor do ecossistema