2月24日(火)、ワシントン・ペンタゴン。

AnthropicのCEOであるダリオ・アモデイ氏は、国防長官ピート・ヘグセス氏と向かい合っていた。NPRやCNNが引用した情報筋は、会談を「礼儀正しい」と表現したが、実際のやり取りは決して穏やかではなかった。

ヘグセス氏は最後通告を突き付けた。金曜日の17時1分までにClaudeの軍事利用制限をすべて撤廃し、ペンタゴンが「すべての合法的な目的」でClaudeを利用できるようにすること――自律型兵器の標的選定や大規模な国内監視も含む。

従わない場合、2億ドルの契約は破棄され、国防生産法による強制調達が発動される。Anthropicは「サプライチェーンリスク」として指定され、事実上ロシアや中国のような敵対勢力と同様にブラックリスト入りとなる。

同日、AnthropicはResponsible Scaling Policy(RSP 3.0)の第3版を発表し、創業以来の最重要誓約――安全対策が整うまでより強力なモデルの訓練は行わないという方針――を静かに撤廃した。

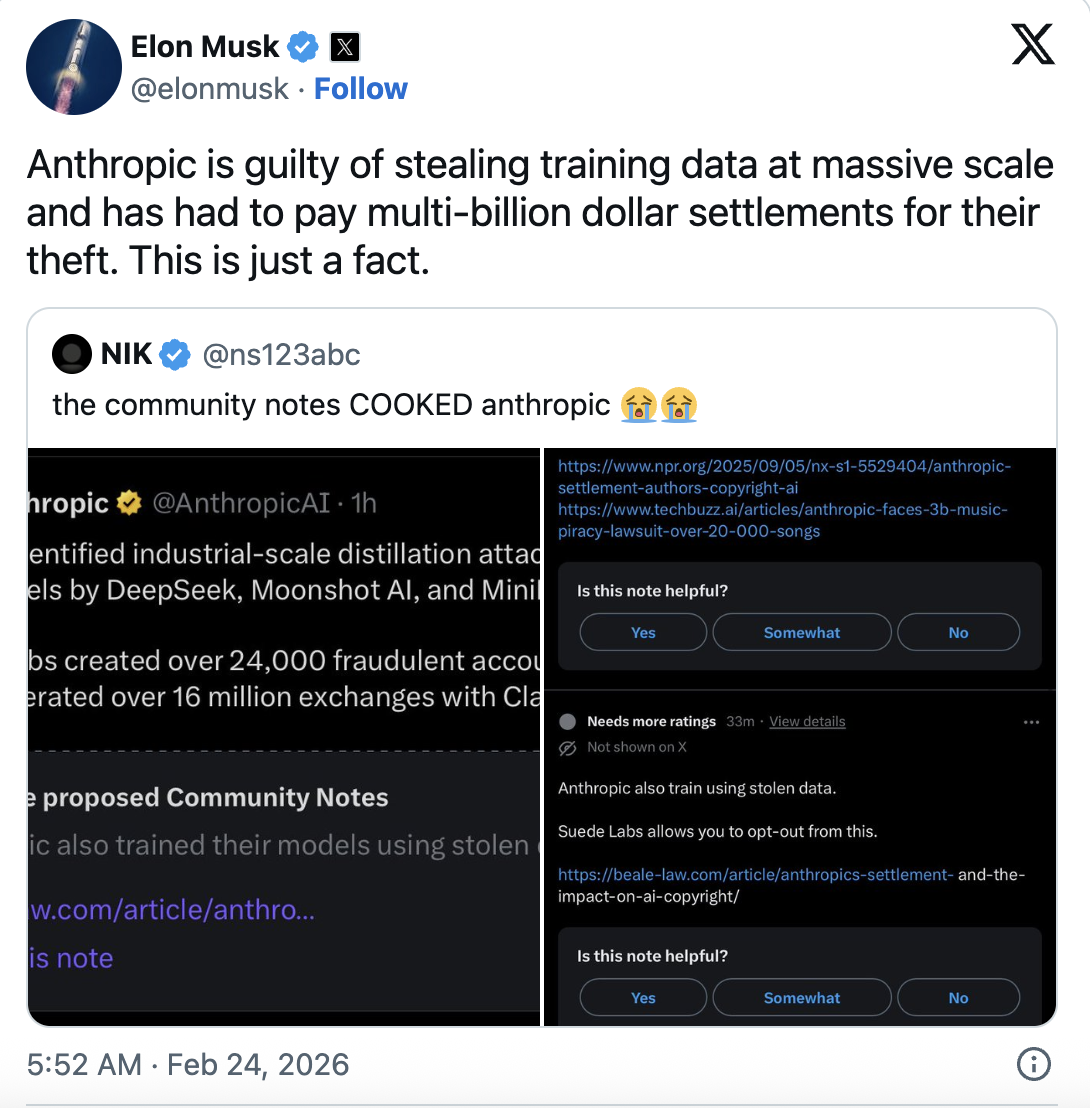

同じ日、イーロン・マスク氏はXで「Anthropicは大規模な学習データの窃盗を行った――これは事実だ」と投稿した。同時に、XのCommunity Notesでは、AnthropicがClaudeの学習に海賊版書籍を利用したことを巡り、15億ドルを支払って和解したとの報道が参照されていた。

72時間以内に、このAI企業はかつて「魂がある」と称した存在から、安全性の殉教者、知的財産の窃盗者、ペンタゴンの裏切り者という三つのレッテルを貼られることとなった。

本当のAnthropicはどれなのか?

おそらく、そのすべてだ。

ペンタゴンの「従うか去るか」命令

物語の第一層は極めて明快だ。

Anthropicは米国防総省から機密アクセスを得た最初のAI企業であり、昨夏に2億ドルを上限とする契約を獲得した。その後、OpenAI、Google、xAIも同規模の契約を得ている。

アルジャジーラによれば、今年1月、Claudeは米軍の作戦で使用された。報道では、ベネズエラのマドゥロ大統領の拉致作戦が含まれていたとされる。

しかしAnthropicは二つのレッドラインを設けた。完全自律型兵器の標的選定は支援しないこと、米国市民に対する大規模監視は支援しないことだ。Anthropicは、AIは兵器制御に十分信頼できるものではなく、大規模監視に関するAI規制法も存在しないと主張している。

ペンタゴンはそれを受け入れなかった。

昨年10月、ホワイトハウスAI顧問のデビッド・サックス氏はXでAnthropicを「規制を牛耳るために恐怖を武器化している」と公然と非難した。

競合他社はすでに譲歩している。OpenAI、Google、xAIはいずれも「すべての合法的なシナリオ」で軍がAIを利用することに同意した。マスク氏のGrokも今週、機密システムへの導入が承認された。

Anthropicだけが最後の抵抗者だ。

執筆時点で、Anthropicは最新の発表で譲歩する意向はないと表明している。しかし金曜日17時1分の期限は目前に迫っている。

司法省とペンタゴンの元リエゾン(匿名)はCNNに「どうやって企業を『サプライチェーンリスク』と指定しつつ、同時に軍事利用を強制できるのか?」と語った。

良い問いだが、ペンタゴンは気にしていない。彼らの関心は、Anthropicが妥協しなければ、従わせるか、ワシントンで干すかのどちらかだ。

「ディスティレーション攻撃」:公開告発の逆効果

2月23日、AnthropicはDeepSeek、Moonshot AI、MiniMaxという中国のAI企業3社を「産業規模のディスティレーション攻撃」をClaudeに仕掛けたと非難する、強い表現のブログ記事を公開した。

Anthropicによれば、これらの企業は24,000の偽アカウントを使い、Claudeと1,600万回以上のやり取りを行い、エージェント推論、ツール利用、プログラミングの中核能力を体系的に抽出したという。

Anthropicはこれを国家安全保障上の脅威と位置付け、抽出されたモデルは「安全策が保持されない可能性が高く」、権威主義的な政府によるサイバー攻撃や偽情報、大規模監視に悪用される恐れがあると主張した。

このストーリーはタイミングも内容も巧妙だった。

トランプ政権が中国への半導体輸出規制を緩和した直後であり、Anthropicが半導体輸出規制のロビー活動に新たな材料を必要としていたタイミングだった。

しかしマスク氏は反論した。「Anthropicは大規模な学習データの窃盗を行い、数十億ドルを支払って和解した。これは事実だ。」

IO.Netの共同創業者トリー・グリーン氏は「自分たちはインターネット全体でモデルを学習させておきながら、他者が公開APIから学習したら『ディスティレーション攻撃』と呼ぶのか?」とコメントした。

Anthropicはディスティレーションを「攻撃」と呼ぶが、これはAI業界の標準的な手法だ。OpenAIはGPT-4の圧縮に、GoogleはGeminiの最適化に、そしてAnthropic自身も利用してきた。今回の違いは、Anthropic自身が標的になったことだけだ。

南洋理工大学のAI教授エリック・カンブリア氏はCNBCに「正当な利用と悪用の境界はしばしば曖昧だ」と語った。

さらに皮肉なことに、AnthropicはClaudeの学習に海賊版書籍を使用したことを巡る請求で15億ドルを支払って和解したばかりだ。インターネット全体で学習させておきながら、他者が公開APIから学習したら非難する――これは単なるダブルスタンダードではなく、トリプルスタンダードだ。

Anthropicは被害者を演じようとしたが、逆に被告となった。

安全性コミットメントの解体:RSP 3.0

ペンタゴンとの対峙、シリコンバレーとの応酬と同じ日に、AnthropicはResponsible Scaling Policy 3.0を発表した。

チーフサイエンティストのジャレッド・カプラン氏は「AIモデルの訓練を停止しても誰の利益にもならない。AIの進化が非常に速い中、競合が全速力で進む中で一方的な誓約をすることは意味がない」とメディアに語った。

つまり、他社がルールを守らないなら、自社も守らないということだ。

RSP 1.0および2.0の核心は「モデルの能力が安全対策の範囲を超えた場合、訓練を停止する」という厳格な誓約だった。この誓約が、AnthropicをAI安全コミュニティで独自の存在にしていた。

しかし3.0ではその約束が撤廃された。

より「柔軟な」枠組みに置き換えられ、Anthropicが実施できる安全策と業界全体への提言を分離。3~6カ月ごとにリスク報告書を発表し、外部専門家によるレビューを受けることとなった。

これで責任ある対応と言えるのか?

非営利団体METRの独立レビュアー、クリス・ペインター氏は初期草稿を見て「Anthropicは『トリアージモード』に入る必要があると考えていることが示されている。リスク評価と緩和が能力向上に追いつかないからだ。社会がAIの壊滅的リスクに備えていない証拠だ」と述べた。

TIME誌は、Anthropicがこの改定を巡り社内でほぼ1年議論し、Amodei CEOと取締役会が全会一致で承認したと報じている。公式には、当初の方針は業界の合意形成を促すものだったが、業界は従わなかった。トランプ政権はAIに対して不介入方針を取り、州法の撤廃すら試みた。連邦レベルでのAI法制化は依然として遠い。2023年には国際的なガバナンス枠組みが実現しそうだったが、3年後にはその道も閉ざされた。

長年AIガバナンスに携わる匿名研究者は端的にこう語る。「RSPはAnthropicにとって最も価値あるブランド資産だ。訓練停止の撤廃は、有機食品企業がこっそり『有機』表示を外し、『検査はより透明になった』と説明するようなものだ。」

時価総額3,800億ドルでのアイデンティティクライシス

2月初旬、Anthropicは時価総額3,800億ドル、アマゾン主導による300億ドルの資金調達を完了した。創業以来、年換算売上は140億ドルに達し、過去3年で毎年10倍以上の成長を遂げている。

同時に、ペンタゴンは同社をブラックリスト入りさせると脅し、マスク氏はデータ窃盗を公然と非難し、コアとなる安全コミットメントは消失。AI安全責任者のムリナンク・シャルマ氏は辞任し、Xで「世界は危険だ」と投稿した。

矛盾なのか?

おそらく矛盾こそがAnthropicのDNAだ。

OpenAIの安全性への取り組みに危機感を抱いた元幹部らが創業したAnthropicは、より強力なモデルをより速く開発しながら、その危険性を世界に訴えてきた。

ビジネスモデルを一言で言えば、「私たちは誰よりもAIを恐れている。だからこそ、その開発を私たちに任せるべきだ」というものだ。

このストーリーは2023~2024年に完璧に機能した。ワシントンではAI安全がバズワードとなり、Anthropicは最も注目されるロビイストとなった。

しかし2026年には風向きが変わった。

「Woke AI」は政治的侮蔑語となり、州レベルのAI規制はホワイトハウスに阻まれ、Anthropicが支援したカリフォルニア州法SB 53は成立したが、連邦レベルでは何も進まなかった。

Anthropicの安全ナラティブは「差別化要素」から「政治的リスク」へと変質しつつある。

Anthropicは複雑なバランスを取っている――ブランドを維持するために「十分安全」でなければならず、市場や政府に拒否されないよう「十分柔軟」でなければならない。しかし両者の許容度は縮小している。

安全ナラティブの価値はいま、どれほどか?

三つの出来事を総合すると、構図は明確だ。

中国企業によるClaudeのディスティレーションを非難し、半導体輸出規制のロビー活動を強化。安全停止の撤廃でAI開発競争に残留。ペンタゴンの自律兵器要求を拒否して最後の道徳的正当性を維持。

どの行動も論理的だが、互いに矛盾している。

自社モデルの「ディスティレーション」が国家安全保障を脅かすと主張しながら、自らモデルの暴走を防ぐ誓約を撤廃することはできない。モデルがそれほど危険なら、より慎重であるべきだ――攻撃的になるのではなく。

Anthropicでなければ、の話だ。

AI業界では、アイデンティティは発言ではなく、バランスシートで決まる。Anthropicの「安全」ナラティブは本質的にブランド・プレミアムだ。

AI開発競争初期、このプレミアムには価値があった。「責任あるAI」には投資家が高値を支払い、「信頼できるAI」には政府が承認を与え、「より安全なAI」には顧客が対価を払った。

しかし2026年には、そのプレミアムは消えつつある。

Anthropicが直面するのは「妥協すべきか」ではなく、「まず誰と妥協するか」だ。ペンタゴンと妥協すればブランドが傷つく。競合と妥協すれば安全誓約が無効化される。投資家と妥協すれば両者が譲歩せざるを得ない。

金曜日17時1分、Anthropicは答えを出す。

結果がどうであれ、確かなことが一つある。かつて「OpenAIとは違う」と誇ったAnthropicは、今や他の企業と同じ姿になりつつある。

アイデンティティクライシスの終焉は、しばしばアイデンティティそのものの消失を意味する。

声明:

- 本記事は[TechFlow]からの転載です。著作権は原著者[Ada]に帰属します。本転載についてご懸念がある場合は、Gate Learnチームまでご連絡ください。関連手続きに従い速やかに対応いたします。

- 免責事項:本記事に記載された見解および意見はすべて著者個人のものであり、投資助言を構成するものではありません。

- 本記事の他言語版はGate Learnチームによる翻訳です。Gateの記載がない限り、翻訳記事の無断転載・配布・盗用を禁じます。

関連記事

ONDOトークン経済モデル:プラットフォームの成長とユーザーエンゲージメントをどのように推進するのか

AI分野におけるRenderの申請理由:分散型ハッシュレートが人工知能の発展を支える仕組み

Render、io.net、Akash:DePINハッシュレートネットワークの比較分析

Plasma(XPL)トークノミクス分析:供給、分配、価値捕捉

Plasma(XPL)と従来型決済システムの比較:ステーブルコインを活用した国際決済および流動性フレームワークの新たな定義