Quelle est la trajectoire de l’humanité à l’ère de l’intelligence artificielle ? Analyse structurelle au-delà de « La crise mondiale de l’intelligence de 2028 »

Le débat autour du rapport « Crise mondiale de l’intelligence 2028 » se focalise souvent sur une question centrale : l’IA provoquera-t-elle un effondrement systémique de l’économie mondiale en 2028 ?

Cette interrogation est par nature dramatique. Cependant, se limiter au dilemme « effondrement ou non » revient à négliger des variables structurelles majeures. L’enjeu réel ne réside pas dans le résultat macroéconomique d’une année donnée, mais dans l’évolution du rôle de l’humanité au sein du système économique, à mesure que l’IA devient l’outil principal de productivité.

I. L’essence de la disruption par l’IA : redistribution de la fonction de production

Sur le plan économique, les révolutions technologiques modifient profondément la pondération des facteurs dans la fonction de production.

- À l’ère industrielle, le capital amplifiait le travail physique.

- À l’ère de l’information, la technologie optimisait l’efficacité du traitement de l’information.

- À l’ère de l’IA, le capital — puissance de calcul, données et modèles — amplifie, voire remplace, le travail cognitif.

La transformation majeure ne concerne pas seulement l’efficacité accrue, mais « qui détient la plus grande part dans la création de valeur ».

Si les tâches cognitives — analyse, modélisation, génération de contenu, codage, prise de décision de processus — sont de plus en plus assurées par l’IA, la part du revenu du travail dans la production totale risque de diminuer, tandis que les rendements du capital augmentent. Cela aura un impact direct sur la structure des revenus, la mobilité sociale et la capacité de consommation. Ainsi, la disruption liée à l’IA s’apparente davantage à un ajustement de redistribution qu’à une simple évolution technologique.

II. Pourquoi la probabilité d’un « effondrement systémique » est-elle limitée ?

Les crises financières systémiques nécessitent généralement une rupture de la chaîne de crédit, de graves déséquilibres entre actifs et passifs, et un effet de levier excessif. Historiquement, les grandes crises résultent de déséquilibres internes au système financier, et non d’outils de productivité.

L’IA constitue une innovation technologique qui améliore la productivité. Elle peut modifier la structure des profits et l’emploi, mais n’altère pas fondamentalement la qualité des actifs bancaires ni le fonctionnement du système de crédit.

Par ailleurs, la diffusion technologique rencontre des obstacles concrets :

- La reconstruction de l’architecture informatique des entreprises requiert du temps

- Les systèmes de gouvernance des données et de conformité constituent des freins

- L’ajustement des processus organisationnels et de la répartition des tâches s’effectue lentement

Même si les modèles d’IA progressent rapidement, leur remplacement à grande échelle dépend de transformations organisationnelles. Cette « friction institutionnelle et organisationnelle » agit comme un amortisseur.

À court terme, il est plus probable d’observer une différenciation sectorielle et une réévaluation des profits qu’une défaillance soudaine du système de crédit mondial.

III. Le risque réel : déséquilibres structurels

Les déséquilibres structurels constituent un risque plus crédible qu’un effondrement total.

Le premier déséquilibre provient de la structure des compétences. Une grande partie de la main-d’œuvre actuelle a été formée dans un contexte où « la cognition humaine était rare ». Si l’analyse standardisée et les tâches génératives sont automatisées, ces compétences devront être revalorisées.

Le second déséquilibre concerne la structure des revenus. Si les gains de productivité liés à l’IA se concentrent chez les détenteurs de puissance de calcul et de plateformes technologiques, alors que le pouvoir de négociation du travail recule, la demande des consommateurs pourrait être fragilisée.

Le troisième déséquilibre résulte de la gestion des attentes. Les marchés de capitaux anticipent souvent la croissance pour la décennie à venir. Lorsque les résultats réels déçoivent, les corrections de valorisation accentuent la volatilité.

Ces risques peuvent se conjuguer pour provoquer des turbulences périodiques. Cependant, turbulence et effondrement sont deux concepts fondamentalement distincts.

IV. Comment les structures d’emploi évolueront-elles ?

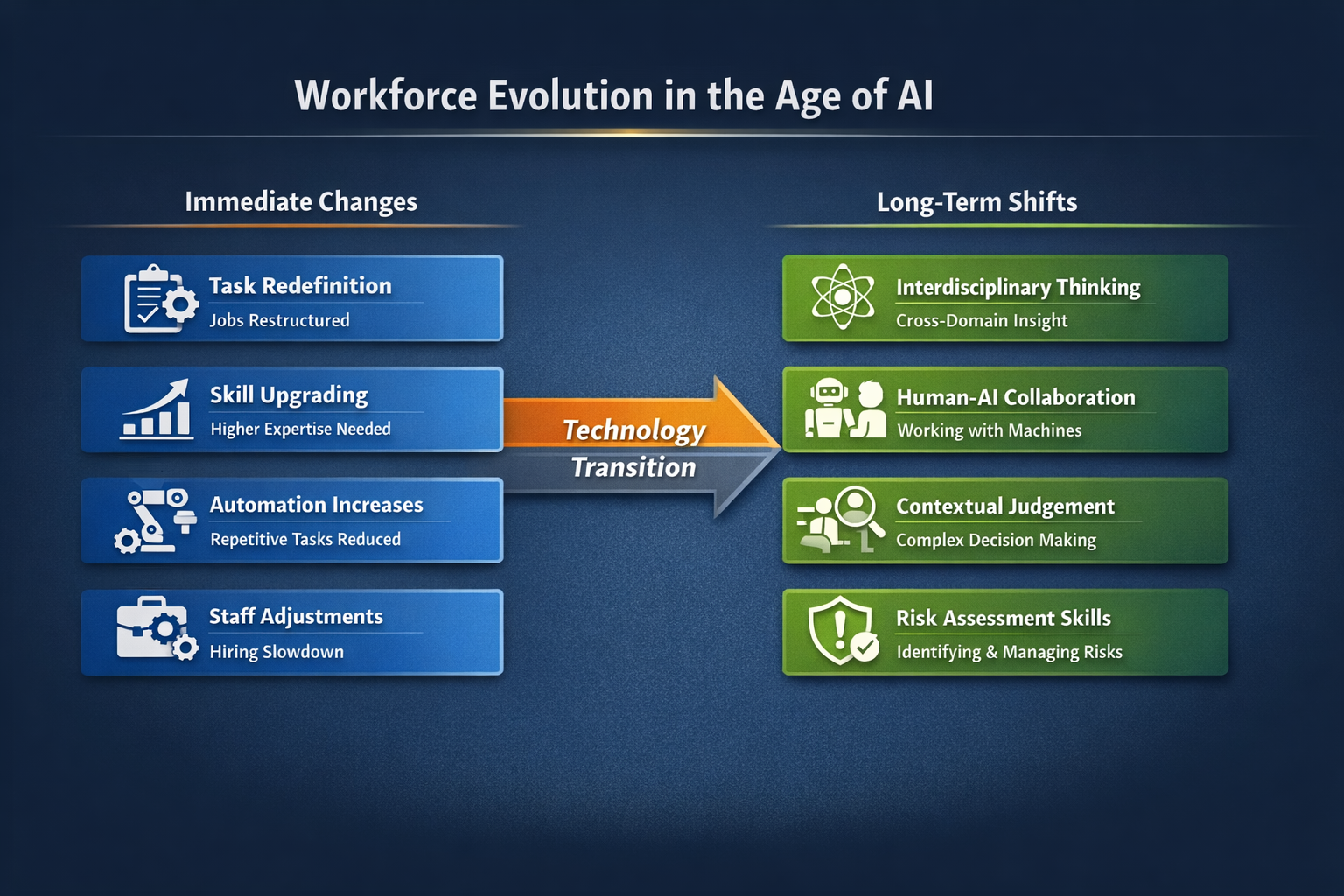

La substitution technologique suit généralement une logique de « remplacement des tâches » plutôt qu’une disparition totale des emplois.

Un emploi regroupe plusieurs tâches, dont certaines peuvent être automatisées, tandis que d’autres nécessitent un jugement et une coordination humains. Les évolutions les plus probables sont :

- Modification du contenu des postes

- Évolution des exigences de compétences

- Moins de tâches répétitives

- Plus de tâches de prise de décision intégrée

À court terme, les entreprises ajusteront leur effectif par une réduction des recrutements, une consolidation des postes et une attrition naturelle, plutôt que par un remplacement massif ponctuel. À long terme, la valeur du travail cognitif standardisé va diminuer, tandis que celle des compétences en jugement complexe et en intégration de systèmes va croître.

Les systèmes éducatifs et de formation devront donc évoluer vers :

- Compréhension interdisciplinaire

- Collaboration homme–machine

- Jugement situationnel

- Identification des risques

plutôt que la simple mémorisation et le calcul de formules.

V. L’IA modifiera-t-elle les structures de pouvoir social ?

Si la puissance de calcul et les données deviennent des actifs de production majeurs, les propriétaires d’infrastructures et de ressources algorithmiques bénéficieront d’un pouvoir de négociation renforcé.

Cela pourrait entraîner deux conséquences :

- Les effets d’échelle s’intensifient

- La régulation et l’innovation institutionnelle s’accélèrent

Les précédents historiques montrent qu’à mesure que la concentration technologique augmente, les institutions s’ajustent. Les questions de concurrence, de réforme fiscale et de normes industrielles pourraient devenir des sujets de débat.

En résumé, l’expansion technologique et la restructuration institutionnelle évoluent généralement de concert.

VI. Le cœur de la valeur humaine à l’ère de l’IA

À mesure que les machines surpassent largement les humains en rapidité et en précision, la valeur humaine ne disparaît pas — elle se déplace vers des domaines plus stratégiques.

Parmi ceux-ci :

- Orientation de la valeur et jugement

- Conception et supervision institutionnelles

- Portage du risque

- Intégration créative

- Construction de la confiance sociale

L’IA fournit des résultats computationnels, mais « le choix du chemin » reste une décision institutionnelle et politique. Le rôle humain pourrait alors évoluer d’exécutant à participant dans la prise de décision et l’autorisation.

VII. Scénarios réalistes les plus probables

Selon les lois de diffusion technologique et les mécanismes macroéconomiques, les scénarios les plus plausibles sont :

- L’IA pénètre profondément plusieurs secteurs, mais à des rythmes inégaux

- Les marges bénéficiaires des entreprises technologiques augmentent périodiquement

- Les postes intermédiaires se raréfient, tandis que la demande pour les postes haut de gamme augmente

- L’élargissement des écarts de revenus devient un sujet de débat politique

- La volatilité des valorisations de marché s’intensifie

- Le capital se concentre sur la puissance de calcul, l’énergie et les infrastructures

Ces évolutions s’apparentent davantage à un remaniement structurel qu’à un effondrement économique. En cas de crise, elle découlerait plus probablement de bulles d’actifs et d’un effet de levier excessif que de l’IA elle-même.

VIII. Enjeux fondamentaux durant la période de transition

Le véritable défi de l’ère de l’IA réside dans la gestion de la période de transition.

Durant cette phase :

- Certaines compétences se déprécient rapidement

- La reconversion progresse lentement

- Les écarts de revenus s’élargissent

- Les attentes du marché sont révisées à plusieurs reprises

Les politiques et institutions doivent trouver un équilibre entre efficacité et stabilité.

Quelle que soit l’approche, une trajectoire durable dépend de gains de productivité réels et d’une adéquation de la demande — et non d’incitations durablement distordues.

Conclusion : le problème n’est pas la « destruction », mais la « reconstruction »

La « Crise mondiale de l’intelligence 2028 » propose un scénario à fort impact qui permet d’envisager des risques extrêmes. D’un point de vue macroéconomique et historique, l’IA devrait conduire à une transformation structurelle de long terme plutôt qu’à une destruction systémique à court terme.

La vraie question n’est pas : l’IA va-t-elle détruire l’économie ?

Mais : lorsque la capacité cognitive n’est plus rare, comment l’humanité redéfinira-t-elle la valeur, la distribution et les structures de pouvoir ?

La technologie est neutre. L’avenir dépend des choix institutionnels, des stratégies éducatives et de l’allocation du capital. L’ère de l’IA n’est pas une fin, mais le début d’un nouvel ordre.

Articles Connexes

Comment trader grâce à des compétences en crypto : de la conception de la stratégie à l’exécution automatisée

Render, io.net et Akash : analyse comparative des réseaux DePIN de taux de hachage

Qu'est-ce que Fartcoin ? Tout ce qu'il faut savoir sur FARTCOIN

L’application de Render dans l’IA : comment le taux de hachage décentralisé dynamise l’intelligence artificielle

Analyse approfondie d’Audiera GameFi : la combinaison du Dance-to-Earn, de l’IA et des jeux de rythme