Las 72 horas de la crisis de identidad de Anthropic

Martes, 24 de febrero. Washington, Pentágono.

El CEO de Anthropic, Dario Amodei, se sentó frente al secretario de Defensa, Pete Hegseth. Fuentes citadas por NPR y CNN describieron la reunión como "cordial", aunque el contenido fue todo menos suave.

Hegseth lanzó un ultimátum: antes de las 17:01 del viernes, Anthropic debía eliminar todas las restricciones de uso militar en Claude y permitir que el Pentágono lo empleara para "todos los fines legales", incluidos el uso en armas autónomas y la vigilancia masiva nacional.

De no hacerlo, el contrato de 200 millones de dólares sería cancelado. Se invocaría la Ley de Producción de Defensa para la requisición obligatoria. Anthropic se consideraría "riesgo para la cadena de suministro", quedando excluida junto a adversarios como Rusia y China.

Ese mismo día, Anthropic publicó la tercera edición de su Responsible Scaling Policy (RSP 3.0), eliminando discretamente su compromiso más fundamental: no entrenar modelos más avanzados sin medidas de seguridad implementadas.

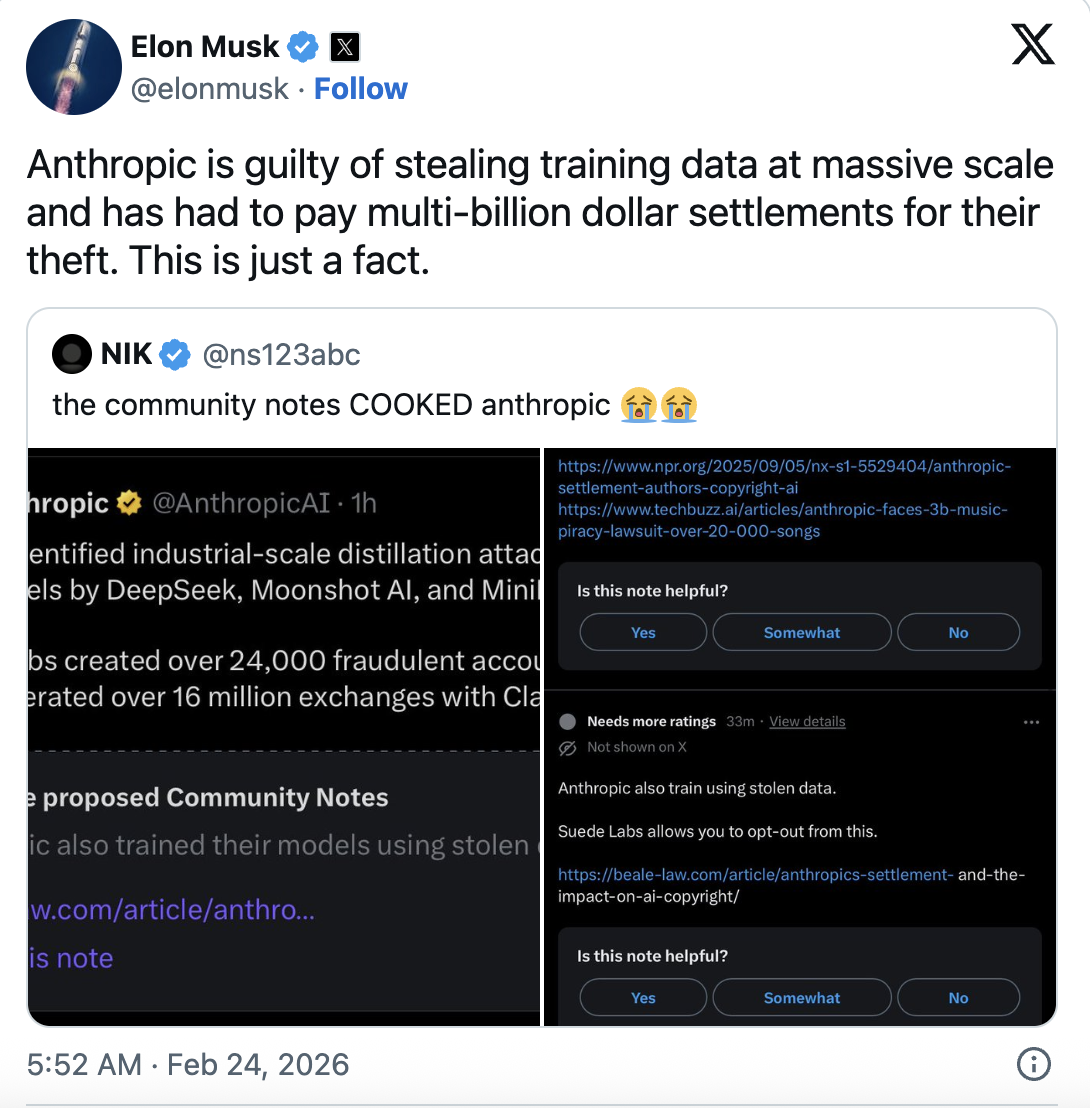

También ese día, Elon Musk publicó en X: "Anthropic participó en el robo masivo de datos de entrenamiento—esto es un hecho". Al mismo tiempo, las Community Notes de X citaron informes de que Anthropic pagó 1 500 millones de dólares para resolver reclamaciones por entrenar Claude con libros pirateados.

En setenta y dos horas, esta empresa de IA—que alguna vez afirmó tener "alma"—fue vista como tres cosas: mártir de la seguridad, ladrona de propiedad intelectual y traidora del Pentágono.

¿Cuál es el verdadero Anthropic?

Quizá todos ellos.

Mandato del Pentágono: "Cumple o sal"

La primera capa de la historia es sencilla.

Anthropic fue la primera empresa de IA en obtener acceso clasificado del Departamento de Defensa de EE. UU., con un contrato adjudicado el verano pasado y un límite de 200 millones de dólares. OpenAI, Google y xAI consiguieron posteriormente contratos de escala similar.

Según Al Jazeera, Claude se utilizó en una operación militar estadounidense en enero. El informe indicaba que la misión implicaba el secuestro del presidente venezolano Maduro.

Pero Anthropic marcó dos líneas rojas: no apoyar la selección de objetivos para armas completamente autónomas y no apoyar la vigilancia masiva de ciudadanos estadounidenses. Anthropic sostiene que la IA no es lo suficientemente fiable para controlar armas, y no existen leyes que regulen la IA en la vigilancia masiva.

El Pentágono no aceptó el argumento.

En octubre pasado, el asesor de IA de la Casa Blanca, David Sacks, acusó públicamente a Anthropic en X de "utilizar el miedo como arma para lograr captura regulatoria".

Los competidores ya cedieron. OpenAI, Google y xAI aceptaron que el ejército use su IA para "todos los escenarios legales". Grok, de Musk, fue aprobado esta semana para sistemas clasificados.

Anthropic es el último en resistirse.

Hasta el momento, Anthropic afirma en su último anuncio que no tiene intención de ceder. Pero el plazo de las 17:01 del viernes se acerca.

Un antiguo enlace anónimo entre el Departamento de Justicia y el Pentágono dijo a CNN: "¿Cómo puedes declarar a una empresa como 'riesgo para la cadena de suministro' y, a la vez, obligarla a trabajar para tu ejército?"

Es una buena pregunta, pero no es la que preocupa al Pentágono. Les interesa que, si Anthropic no se compromete, impondrán el cumplimiento o dejarán a Anthropic fuera en Washington.

"Distillation Attack": una acusación pública que se vuelve en contra

El 23 de febrero, Anthropic publicó un blog con tono contundente acusando a tres empresas chinas de IA—DeepSeek, Moonshot AI y MiniMax—de realizar "ataques de destilación a escala industrial" sobre Claude.

Anthropic alegó que estas empresas usaron 24 000 cuentas falsas para iniciar más de 16 millones de interacciones con Claude, extrayendo sistemáticamente sus capacidades clave en razonamiento de agentes, uso de herramientas y programación.

Anthropic presentó esto como una amenaza a la seguridad nacional, alegando que los modelos destilados "probablemente no mantendrán las barreras de seguridad" y podrían ser usados por gobiernos autoritarios para ciberataques, desinformación y vigilancia masiva.

La narrativa fue oportuna y bien elaborada.

Llegó justo después de que la administración Trump relajara el control de exportación de chips a China, en el momento en que Anthropic necesitaba argumentos para su lobby sobre exportaciones de chips.

Pero Musk respondió: "Anthropic participó en el robo masivo de datos de entrenamiento y pagó miles de millones en acuerdos. Esto es un hecho."

El cofundador de IO.Net, Tory Green, comentó: "Entrenas tus modelos en todo internet, y cuando otros aprenden de tu API pública, lo llamas 'ataque de destilación'?"

Anthropic llama "ataque" a la destilación, pero es una práctica habitual en la industria de IA. OpenAI la utilizó para comprimir GPT-4, Google para optimizar Gemini, y la propia Anthropic la ha empleado. La única diferencia esta vez: Anthropic es el objetivo.

Como dijo Erik Cambria, profesor de IA de la Universidad Tecnológica de Nanyang, a CNBC: "La línea entre uso legítimo y explotación maliciosa suele estar difusa."

Aún más irónico, Anthropic acaba de pagar 1 500 millones de dólares para resolver reclamaciones por entrenar Claude con libros pirateados. Entrenaron en todo internet y luego acusaron a otros de aprender de su API pública. No solo son dobles estándares—son triples estándares.

Anthropic intentó presentarse como víctima, pero terminó siendo el acusado.

Desmantelando compromisos de seguridad: RSP 3.0

El mismo día que enfrentó al Pentágono y se cruzó con Silicon Valley, Anthropic publicó la tercera versión de su Responsible Scaling Policy.

El científico jefe Jared Kaplan declaró a los medios: "No creemos que detener el entrenamiento de modelos de IA beneficie a nadie. Con la IA desarrollándose tan rápido, hacer compromisos unilaterales mientras los competidores avanzan a toda velocidad no tiene sentido."

En otras palabras, si otros no siguen las reglas, nosotros tampoco.

El núcleo de RSP 1.0 y 2.0 era un compromiso firme: si las capacidades del modelo superaban la cobertura de las medidas de seguridad, el entrenamiento se pausaba. Esa promesa le dio a Anthropic una reputación única en la comunidad de seguridad de IA.

Pero la versión 3.0 eliminó ese compromiso.

Ahora hay un marco más "flexible", separando las medidas de seguridad que Anthropic puede implementar de las recomendaciones para toda la industria. Cada 3–6 meses se publicará un informe de riesgos, con revisión externa de expertos.

¿Eso suena responsable?

Chris Painter, revisor independiente de la organización sin ánimo de lucro METR, dijo tras ver un borrador inicial: "Esto muestra que Anthropic cree que necesita entrar en 'modo de triaje', porque la evaluación y mitigación de riesgos no pueden seguir el ritmo del crecimiento de capacidades. Es más evidencia de que la sociedad no está preparada para los riesgos catastróficos de la IA."

TIME informó que Anthropic pasó casi un año debatiendo internamente esta revisión, con el CEO Amodei y el consejo dando aprobación unánime. Oficialmente, la política original buscaba impulsar el consenso en la industria, pero la industria no siguió. La administración Trump adoptó una postura de no intervención respecto a la IA, incluso intentando derogar leyes estatales. La legislación federal sobre IA sigue fuera de alcance. En 2023 parecía posible un marco de gobernanza global, pero tres años después esa puerta está cerrada.

Un investigador anónimo de gobernanza de IA, con larga trayectoria, lo expresó con contundencia: "RSP es el activo de marca más valioso de Anthropic. Eliminar la pausa de entrenamiento es como si una empresa de alimentos orgánicos quitara discretamente 'orgánico' de su etiqueta y luego dijera que ahora sus pruebas son más transparentes."

Crisis de identidad con una valoración de 380 000 millones de dólares

En febrero, Anthropic cerró una ronda de financiación de 30 000 millones de dólares con una valoración de 380 000 millones, con Amazon como inversor principal. Desde su fundación, ha logrado 14 000 millones en ingresos anualizados, y en los últimos tres años esa cifra se ha multiplicado por más de diez cada año.

Al mismo tiempo, el Pentágono amenaza con incluir a la empresa en la lista negra. Musk la acusa públicamente de robo de datos. Su compromiso central de seguridad ha desaparecido. El jefe de seguridad de IA de Anthropic, Mrinank Sharma, renunció y escribió en X: "El mundo está en peligro."

¿Contradicción?

Quizá la contradicción sea el ADN de Anthropic.

Fundada por ex ejecutivos de OpenAI preocupados por el ritmo de seguridad de OpenAI, Anthropic terminó construyendo modelos aún más potentes, más rápido, mientras advertía sobre lo peligrosos que eran esos modelos.

El modelo de negocio, en resumen: tememos la IA más que nadie, así que deberías pagarnos para construirla.

Esta narrativa funcionó a la perfección en 2023–2024. La seguridad de IA era un tema candente en Washington y Anthropic era el lobbyista más destacado.

En 2026, el viento cambió.

"Woke AI" se convirtió en un insulto político, la regulación estatal de IA fue bloqueada por la Casa Blanca, y aunque la SB 53 de California (apoyada por Anthropic) se convirtió en ley, no hubo avances a nivel federal.

La narrativa de seguridad de Anthropic está pasando de "diferenciador" a "responsabilidad política".

Anthropic realiza un complejo ejercicio de equilibrio: necesita ser lo suficientemente "segura" para preservar su marca, pero lo suficientemente "flexible" para evitar el rechazo del mercado o del gobierno. El problema: la tolerancia en ambos lados disminuye.

¿Cuánto vale ahora la narrativa de seguridad?

Considerados en conjunto, los tres eventos muestran un panorama claro.

Acusar a empresas chinas de destilar Claude refuerza el lobby por el control de exportación de chips. Eliminar la pausa de seguridad mantiene a Anthropic en la carrera armamentista. Rechazar la exigencia del Pentágono para armas autónomas preserva su última capa de credibilidad moral.

Cada movimiento es lógico, pero todos se contradicen entre sí.

No se puede afirmar que las empresas chinas "destilando" tu modelo amenazan la seguridad nacional mientras eliminas tu propia promesa de evitar que tu modelo se descontrole. Si el modelo es tan peligroso, deberías ser más cauteloso, no más agresivo.

A menos que seas Anthropic.

En la industria de IA, la identidad no la define lo que dices, sino tu balance. La narrativa de "seguridad" de Anthropic es, en esencia, una prima de marca.

Al principio de la carrera armamentista de IA, esa prima era valiosa. Los inversores pagaban más por "IA responsable", los gobiernos aprobaban "IA confiable" y los clientes pagaban por "IA más segura".

Pero en 2026, esa prima está desapareciendo.

Anthropic enfrenta ahora no la pregunta de "¿deberíamos ceder?", sino el dilema de "¿con quién cedemos primero?". Si cede ante el Pentágono, la marca sufre. Si cede ante los competidores, el compromiso de seguridad se anula. Si cede ante los inversores, ambos lados deben conceder.

A las 17:01 del viernes, Anthropic dará su respuesta.

Sea cual sea el resultado, hay algo seguro: el Anthropic que prosperaba con "somos distintos a OpenAI" está convirtiéndose en uno más.

El final de una crisis de identidad suele ser la desaparición de la identidad misma.

Declaración:

- Este artículo es una reimpresión de [TechFlow]. El copyright pertenece al autor original [Ada]. Si tienes inquietudes sobre esta reimpresión, contacta con el equipo de Gate Learn y lo gestionaremos según los procedimientos pertinentes.

- Descargo de responsabilidad: Las opiniones expresadas en este artículo pertenecen exclusivamente al autor y no constituyen asesoramiento de inversión.

- Otras versiones en diferentes idiomas de este artículo han sido traducidas por el equipo de Gate Learn. Sin mención de Gate, los artículos traducidos no pueden copiarse, distribuirse ni plagiarse.

Artículos relacionados

La aplicación de Render en IA: cómo el hashrate descentralizado impulsa la inteligencia artificial

Tokenómica de RENDER: suministro, incentivos y captura de valor

¿Qué es Tronscan y cómo puedes usarlo en 2025?

¿Qué es SegWit?

¿Qué es HyperGPT? Todo lo que necesitas saber sobre HGPT