اثنتان وسبعون ساعة من أزمة الهوية لشركة Anthropic

الثلاثاء، 24 فبراير. واشنطن، البنتاغون.

جلس داريو أمودي، الرئيس التنفيذي لشركة Anthropic، أمام وزير الدفاع بيت هيغسيث. أفادت مصادر من NPR وCNN أن الاجتماع كان "مهذباً"، رغم أن مضمونه كان بعيداً عن اللطف.

وجه هيغسيث إنذاراً نهائياً: بحلول الساعة 5:01 مساءً يوم الجمعة، يجب رفع جميع القيود على استخدام Claude للأغراض العسكرية، والسماح للبنتاغون باستخدامه في "جميع الأغراض القانونية"، بما في ذلك استهداف الأسلحة الذاتية التشغيل والمراقبة واسعة النطاق داخل الولايات المتحدة.

وإلا، سيتم إلغاء العقد بقيمة $200 مليون. وسيتم تفعيل قانون الإنتاج الدفاعي للاستحواذ الإجباري. وسيتم تصنيف Anthropic كـ"خطر على سلسلة التوريد"—ما يعني عملياً إدراجها في القائمة السوداء بجانب خصوم مثل روسيا والصين.

في اليوم نفسه، أصدرت Anthropic الإصدار الثالث من سياسة التوسع المسؤول (RSP 3.0)، وقامت بهدوء بإلغاء تعهدها الأساسي منذ تأسيسها: عدم تدريب نماذج أقوى إلا إذا توفرت تدابير أمان.

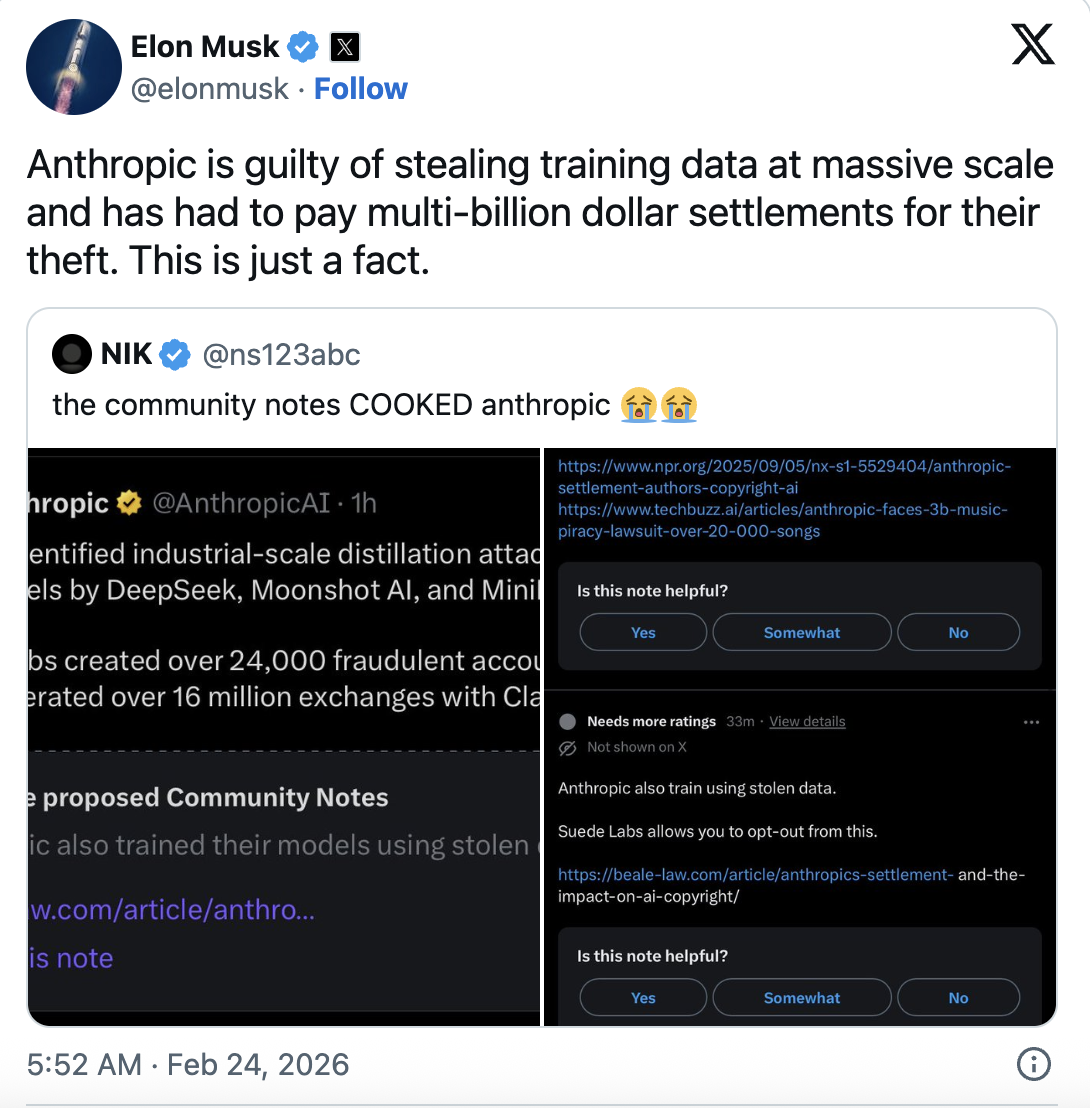

وفي اليوم ذاته، نشر إيلون ماسك منشوراً على X قال فيه: "شركة Anthropic متورطة في سرقة بيانات تدريب واسعة النطاق—وهذا أمر واقع." في الوقت نفسه، أشار قسم الملاحظات المجتمعية في X إلى تقارير تفيد بأن Anthropic دفعت $1.5 مليار لتسوية دعاوى بشأن تدريب Claude باستخدام كتب مقرصنة.

خلال 72 ساعة، تحولت هذه الشركة التي كانت تدّعي امتلاك "روح" إلى ثلاث صور: شهيد السلامة، سارق الملكية الفكرية، وخائن للبنتاغون.

من هي Anthropic الحقيقية؟

ربما جميعها.

تفويض البنتاغون: "امتثل أو غادر"

الجزء الأول من القصة واضح.

كانت Anthropic أول شركة ذكاء اصطناعي تحصل على وصول سري من وزارة الدفاع الأمريكية، بعقد مُنح الصيف الماضي بقيمة $200 مليون كحد أقصى. لاحقاً حصلت OpenAI وGoogle وxAI على عقود مشابهة.

وفقاً للجزيرة، تم استخدام Claude في عملية عسكرية أمريكية في يناير الماضي. وأفاد التقرير بأن المهمة تضمنت اختطاف الرئيس الفنزويلي مادورو.

لكن Anthropic رسمت خطين أحمرين: رفض دعم استهداف الأسلحة الذاتية التشغيل بالكامل، ورفض دعم المراقبة واسعة النطاق للمواطنين الأمريكيين. تؤكد Anthropic أن الذكاء الاصطناعي ليس موثوقاً بما يكفي للتحكم في الأسلحة، ولا توجد قوانين تنظم الذكاء الاصطناعي في المراقبة الجماعية.

البنتاغون لم يقتنع بذلك.

في أكتوبر الماضي، اتهم مستشار الذكاء الاصطناعي في البيت الأبيض، ديفيد ساكس، شركة Anthropic علناً على X بأنها "تستخدم الخوف كسلاح لتحقيق السيطرة التنظيمية".

المنافسون استسلموا بالفعل. وافقت OpenAI وGoogle وxAI جميعاً على السماح للجيش باستخدام الذكاء الاصطناعي في "جميع السيناريوهات القانونية". وتمت الموافقة على Grok من ماسك للاستخدام في الأنظمة السرية هذا الأسبوع.

Anthropic هي آخر من بقي متماسكاً.

حتى لحظة كتابة هذا التقرير، أعلنت Anthropic في بيانها الأخير أنها لا تنوي الاستسلام. لكن الموعد النهائي يوم الجمعة الساعة 5:01 مساءً يقترب.

قال مسؤول سابق مجهول كان حلقة وصل بين وزارة العدل والبنتاغون لـCNN: "كيف يمكنك إعلان شركة كخطر على سلسلة التوريد وفي الوقت نفسه إجبارها على العمل لصالح الجيش؟"

سؤال وجيه—لكن البنتاغون لا يهتم بذلك. ما يهمهم هو أنه إذا لم تتنازل Anthropic، فسيفرضون الامتثال أو يتركونها خارج دائرة واشنطن.

هجوم التقطير: اتهام علني ينقلب ضده

في 23 فبراير، نشرت Anthropic تدوينة حادة تتهم ثلاث شركات ذكاء اصطناعي صينية—DeepSeek وMoonshot AI وMiniMax—بشن "هجمات تقطير صناعية واسعة النطاق" على Claude.

زعمت Anthropic أن هذه الشركات استخدمت 24,000 حساب وهمي لإجراء أكثر من 16 مليون تفاعل مع Claude، لاستخراج قدراته الأساسية في الاستدلال كوكيل، واستخدام الأدوات، والبرمجة بشكل منهجي.

وصفت Anthropic ذلك بأنه تهديد للأمن القومي، مدعية أن النماذج المقطرة "من غير المرجح أن تحتفظ بضوابط الأمان" وقد يتم استخدامها من قبل حكومات سلطوية في الهجمات السيبرانية، ونشر المعلومات المضللة، والمراقبة الجماعية.

السرد كان في توقيته وصياغته جيداً.

جاء مباشرة بعد أن خففت إدارة ترامب القيود على تصدير الرقائق إلى الصين—في الوقت الذي كانت فيه Anthropic بحاجة إلى حجج جديدة في حملتها للضغط بشأن تصدير الرقائق.

لكن ماسك رد قائلاً: "شركة Anthropic متورطة في سرقة بيانات تدريب واسعة النطاق ودفع مليارات في التسويات. هذا أمر واقع."

علق المؤسس المشارك في IO.Net، توري غرين: "أنتم تدربون نماذجكم على الإنترنت بالكامل، وعندما يتعلم الآخرون من واجهة برمجة التطبيقات العامة الخاصة بكم، تصفون ذلك بأنه 'هجوم تقطير'؟"

تصف Anthropic التقطير بأنه "هجوم"، لكنه ممارسة شائعة في صناعة الذكاء الاصطناعي. استخدمته OpenAI لضغط GPT-4، واستخدمته Google لتحسين Gemini، وAnthropic نفسها قامت بذلك. الفرق الوحيد هذه المرة: Anthropic هي الهدف.

كما قال أستاذ الذكاء الاصطناعي في جامعة نانيانغ التكنولوجية، إريك كامبريا، لـCNBC: "الخط الفاصل بين الاستخدام المشروع والاستغلال الضار غالباً ما يكون غير واضح."

والأكثر سخرية، أن Anthropic دفعت للتو $1.5 مليار لتسوية دعاوى بشأن تدريب Claude على كتب مقرصنة. لقد تدربوا على الإنترنت بالكامل، ثم اتهموا الآخرين بالتعلم من واجهة برمجة التطبيقات العامة الخاصة بهم. هذا ليس ازدواجية معايير فحسب—بل ثلاثية معايير.

سعت Anthropic لتصوير نفسها كضحية، لكنها انتهت متهمة.

تفكيك الالتزامات المتعلقة بالسلامة: RSP 3.0

في اليوم نفسه الذي واجهت فيه Anthropic البنتاغون وتبادلت الاتهامات مع وادي السيليكون، أصدرت النسخة الثالثة من سياسة التوسع المسؤول.

قال كبير العلماء، جاريد كابلان، للصحافة: "لا نعتقد أن إيقاف تدريب نماذج الذكاء الاصطناعي يفيد أي طرف. مع التطور السريع للذكاء الاصطناعي، اتخاذ التزامات أحادية الجانب بينما يدفع المنافسون قدماً بسرعة كاملة ليس منطقياً."

بمعنى آخر، إذا لم يلتزم الآخرون بالقواعد، فلن نلتزم نحن أيضاً.

جوهر RSP 1.0 و2.0 كان التزاماً صارماً: إذا تجاوزت قدرات النموذج نطاق تدابير الأمان، يتوقف التدريب. هذا التعهد منح Anthropic سمعة فريدة في مجتمع سلامة الذكاء الاصطناعي.

لكن الإصدار 3.0 أسقط ذلك الوعد.

استُبدل ذلك بإطار أكثر "مرونة"—يفصل بين تدابير الأمان التي يمكن لـAnthropic تنفيذها وتوصيات الصناعة ككل. كل 3–6 أشهر، سيتم نشر تقرير مخاطر مع مراجعة خارجية من خبراء.

هل يبدو ذلك مسؤولاً؟

قال كريس بينتر، المراجع المستقل من منظمة METR غير الربحية، بعد الاطلاع على مسودة مبكرة: "هذا يظهر أن Anthropic تعتقد أنها بحاجة لدخول 'وضع الفرز' لأن تقييم المخاطر والتخفيف لا يستطيعان مواكبة نمو القدرات. إنه دليل إضافي على أن المجتمع غير مستعد لمخاطر الذكاء الاصطناعي الكارثية."

ذكرت TIME أن Anthropic قضت قرابة عام في نقاش داخلي حول هذا التعديل، ووافق عليه الرئيس التنفيذي أمودي ومجلس الإدارة بالإجماع. رسمياً، كانت السياسة الأصلية تهدف إلى دفع الصناعة نحو التوافق—لكن الصناعة لم تتبع ذلك. إدارة ترامب اتبعت نهجاً غير تدخلي مع الذكاء الاصطناعي، وحاولت حتى إلغاء قوانين الولايات. ولا يزال التشريع الفيدرالي للذكاء الاصطناعي بعيد المنال. في 2023، بدا أن إطار الحوكمة العالمية ممكن، لكن بعد ثلاث سنوات، أغلق ذلك الباب.

قال باحث مجهول في حوكمة الذكاء الاصطناعي: "RSP هو أهم أصل علامي لشركة Anthropic. إسقاط التوقف عن التدريب يشبه شركة الأغذية العضوية التي تزيل بهدوء كلمة 'عضوي' من علامتها، ثم تقول لك إن اختباراتها الآن أكثر شفافية."

أزمة الهوية عند تقييم $380 مليار

في أوائل فبراير، أغلقت Anthropic جولة تمويل بقيمة $30 مليار عند تقييم $380 مليار، بقيادة Amazon كمستثمر رئيسي. منذ تأسيسها، حققت $14 مليار إيرادات سنوية، وخلال السنوات الثلاث الماضية، نما هذا الرقم أكثر من عشرة أضعاف سنوياً.

في الوقت نفسه، يهدد البنتاغون بإدراج الشركة في القائمة السوداء. ماسك يتهمها علناً بسرقة البيانات. التزامها الأساسي بالسلامة اختفى. رئيس قسم السلامة في الذكاء الاصطناعي لدى Anthropic، مرينانك شارما، استقال وكتب على X: "العالم في خطر."

تناقض؟

ربما التناقض هو الحمض النووي لشركة Anthropic.

تأسست على يد مسؤولين سابقين في OpenAI قلقين من وتيرة السلامة في OpenAI، ثم بنت Anthropic نماذج أقوى وأسرع، بينما تخبر العالم بمدى خطورة تلك النماذج.

نموذج العمل باختصار: نحن نخشى الذكاء الاصطناعي أكثر من أي أحد، لذا يجب أن تدفع لنا لبنائه.

هذا السرد نجح تماماً في 2023–2024. كانت السلامة في الذكاء الاصطناعي كلمة رنانة في واشنطن، وكانت Anthropic أبرز جماعات الضغط.

بحلول 2026، تغيرت الرياح.

أصبح "الذكاء الاصطناعي المستيقظ" إهانة سياسية، وتم حظر تنظيم الذكاء الاصطناعي على مستوى الولايات من قبل البيت الأبيض، ورغم أن SB 53 في كاليفورنيا (بدعم من Anthropic) أصبح قانوناً، لم يحدث شيء على المستوى الفيدرالي.

سرد السلامة لدى Anthropic يتحول من "ميزة تمييزية" إلى "عبء سياسي".

تؤدي Anthropic رقصة توازن معقدة—تحتاج أن تكون "آمنة" بما يكفي للحفاظ على علامتها، ولكن "مرنة" بما يكفي لتجنب رفض السوق أو الحكومة. المشكلة أن التسامح من كلا الطرفين يتقلص.

كم تبلغ قيمة سرد السلامة اليوم؟

عند النظر إلى الأحداث الثلاثة معاً، تظهر الصورة واضحة.

اتهام الشركات الصينية بتقطير Claude يعزز جهود الضغط لتقييد تصدير الرقائق. إسقاط التوقف عن السلامة يبقي Anthropic في سباق التسلح. رفض طلب البنتاغون بشأن الأسلحة الذاتية التشغيل يحافظ على آخر طبقة من المصداقية الأخلاقية.

كل خطوة منطقية، لكن كل منها تناقض الأخرى.

لا يمكنك الادعاء بأن الشركات الصينية "تقطر" نموذجك وتهدد الأمن القومي بينما تزيل تعهدك بمنع نموذجك من الخروج عن السيطرة. إذا كان النموذج خطيراً لهذا الحد، عليك أن تكون أكثر حذراً—not أكثر عدوانية.

إلا إذا كنت Anthropic.

في صناعة الذكاء الاصطناعي، لا تحدد هويتك عبر تصريحاتك—بل عبر ميزانيتك. سرد "السلامة" لدى Anthropic هو في جوهره علاوة العلامة التجارية.

في بداية سباق التسلح في الذكاء الاصطناعي، كانت هذه العلاوة ذات قيمة. دفع المستثمرون أكثر من أجل "ذكاء اصطناعي مسؤول"، وأجازت الحكومات "ذكاء اصطناعي موثوق"، ودفع العملاء من أجل "ذكاء اصطناعي أكثر أماناً".

لكن بحلول 2026، بدأت تلك العلاوة في التلاشي.

تواجه Anthropic الآن سؤالاً ليس "هل نساوم؟" بل "مع من نساوم أولاً؟". إذا ساومت مع البنتاغون، تتضرر العلامة. إذا ساومت مع المنافسين، يُلغى تعهد السلامة. إذا ساومت مع المستثمرين، يجب أن يتنازل الطرفان.

الساعة 5:01 مساءً يوم الجمعة، ستقدم Anthropic جوابها.

بغض النظر عن النتيجة، هناك أمر واحد مؤكد: Anthropic التي ازدهرت على "نحن مختلفون عن OpenAI" أصبحت الآن مثل الجميع.

نهاية أزمة الهوية غالباً ما تعني اختفاء الهوية نفسها.

بيان:

- تم إعادة نشر هذه المقالة من [TechFlow]. حقوق النشر تعود للمؤلف الأصلي [Ada]. إذا كان لديك أي مخاوف بشأن إعادة النشر، يرجى التواصل مع فريق Gate Learn، وسنتعامل معها بسرعة وفقاً للإجراءات ذات الصلة.

- إخلاء مسؤولية: الآراء والمواقف الواردة في هذه المقالة تعبر عن رأي الكاتب فقط ولا تشكل نصيحة استثمارية.

- تمت ترجمة النسخ بلغات أخرى من هذه المقالة بواسطة فريق Gate Learn. دون الإشارة إلى Gate، لا يجوز نسخ أو توزيع أو سرقة المقالات المترجمة.

المقالات ذات الصلة

ما هو Tronscan وكيف يمكنك استخدامه في عام 2025؟

أزتك مقابل Zcash مقابل Tornado Cash: تحليل مقارن للفروق الأساسية بين ثلاث حلول خصوصية

شرح توكنوميكس Plasma (XPL): العرض، التوزيع، وآلية تحقيق القيمة

كاردانو مقابل إيثيريوم: التعرف على الاختلافات الأساسية بين اثنتين من أبرز منصات العقود الذكية

شرح توكنوميكس ADA: العرض، الحوافز، وحالات الاستخدام